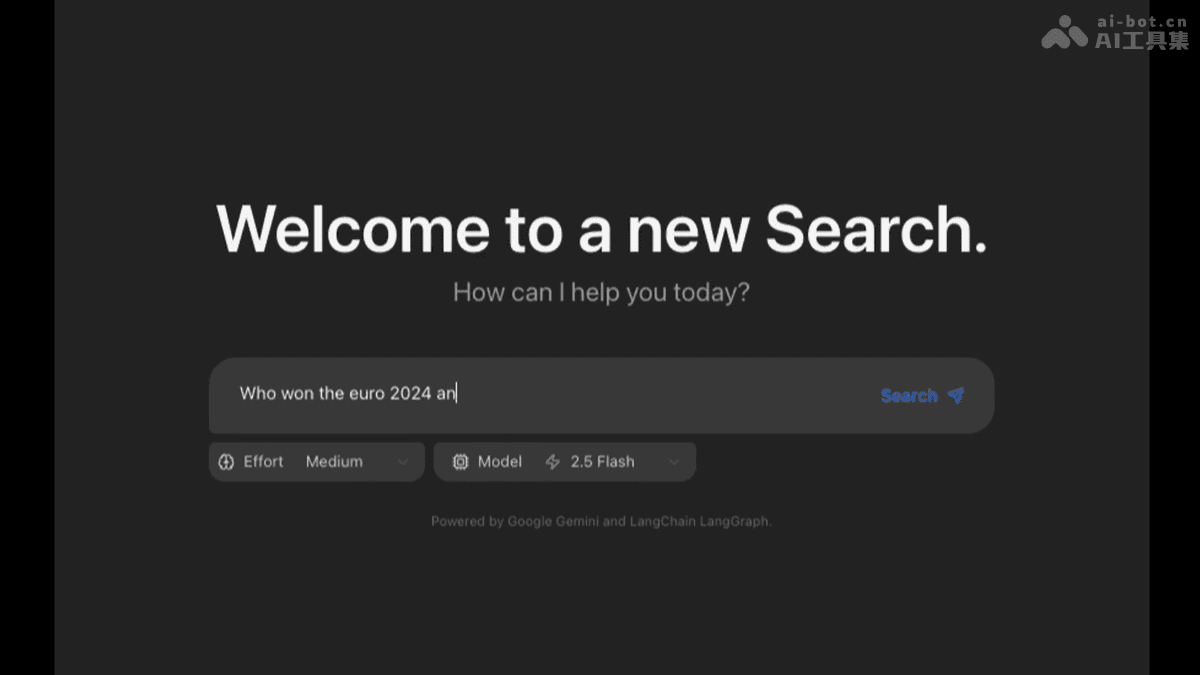

在人工智能领域,全栈AI研究助手的概念正逐渐崭露头角,成为科研人员和开发者的得力工具。谷歌DeepMind开源的Gemini Fullstack LangGraph Quickstart项目,正是这一趋势下的杰出代表。它不仅仅是一个简单的工具,更是一个集成了前端用户界面和后端智能代理的完整解决方案,旨在帮助用户快速搭建基于Google Gemini 2.5和LangGraph的全栈智能研究助手。本文将深入探讨该项目的核心功能、技术原理、应用场景以及其在AI研究领域的重要意义。

Gemini Fullstack LangGraph Quickstart的核心功能剖析

Gemini Fullstack LangGraph Quickstart的核心在于其强大的功能集成,它将多个关键模块紧密结合,为用户提供了一个高效、智能的研究平台。以下将详细介绍其主要功能:

动态搜索查询生成:

传统的搜索引擎往往需要用户手动输入关键词,而Gemini Fullstack LangGraph Quickstart则能够根据用户输入的初始问题或需求,自动生成更精确、更具针对性的搜索查询。这一功能极大地提高了搜索效率,减少了用户在信息检索上的时间和精力投入。

网络研究:

项目集成了Google Search API,能够实时搜索互联网上的海量信息。通过对搜索结果的智能分析和筛选,快速定位到与研究主题相关的网页,为用户提供全面的信息资源。

反思与知识缺口分析:

在获取初步搜索结果后,系统并不会立即给出结论,而是会进行深入的反思和分析。它会评估当前信息是否足够支持得出结论,识别其中存在的知识缺口。这一过程模拟了人类研究人员的思考方式,确保研究的深度和广度。

迭代优化:

当系统检测到知识缺口时,它会根据已有的信息,自动生成新的搜索查询,并再次进行网络搜索和分析。这一迭代过程会不断重复,直至系统认为信息已经充分,可以得出可靠的结论。这种迭代优化的机制,保证了研究的全面性和准确性。

综合答案生成:

在完成信息收集和分析后,系统会将所有相关信息整合起来,生成一个连贯、全面的答案。更重要的是,答案会附上详细的引用,方便用户溯源和验证信息的可靠性。这一功能不仅提供了最终的研究结果,也为用户提供了深入研究的线索。

Gemini Fullstack LangGraph Quickstart的技术原理探究

Gemini Fullstack LangGraph Quickstart的技术实现涉及多个层面,从前端用户界面到后端智能代理,每一个环节都经过精心设计和优化。以下将深入探讨其技术原理:

前端界面:

前端界面是用户与系统交互的桥梁,其设计直接影响用户的使用体验。Gemini Fullstack LangGraph Quickstart采用React和Vite构建用户界面,React以其组件化、高效的特点,成为构建复杂用户界面的首选框架。Vite则以其快速的构建速度和热模块替换功能,极大地提高了开发效率。

为了保证界面的美观和响应式,项目还采用了Tailwind CSS和Shadcn UI。Tailwind CSS是一个实用至上的CSS框架,它提供了大量的预设样式类,可以快速构建出美观、一致的界面。Shadcn UI则是一个组件库,提供了各种常用的UI组件,如按钮、表单、对话框等,可以快速搭建出功能完善的用户界面。

后端智能体:

后端智能体是整个系统的核心,它负责处理用户的请求、进行网络搜索、分析信息、生成答案等核心任务。Gemini Fullstack LangGraph Quickstart的后端智能体基于LangGraph构建,LangGraph是一个强大的图结构框架,可以用于构建复杂的智能代理。

在

backend/src/agent/graph.py文件中,定义了研究智能体的核心逻辑。该智能体通过LangGraph的图结构,将各个功能模块连接起来,形成一个完整的pipeline。这个pipeline包括搜索查询生成、网络搜索、信息分析、知识缺口识别、迭代优化、答案生成等多个环节。每个环节都由一个独立的模块负责,这些模块协同工作,共同完成研究任务。开发与部署:

为了方便开发者使用和部署,Gemini Fullstack LangGraph Quickstart提供了多种开发和部署方式。在本地开发环境中,可以通过

make dev命令同时运行前后端开发服务器,实现快速迭代和调试。在生产环境中,项目支持使用Docker和docker-compose进行部署。Docker可以将应用程序及其依赖项打包到一个容器中,保证应用程序在不同环境中运行的一致性。docker-compose可以定义和管理多个Docker容器,方便部署复杂的应用程序。

此外,项目还依赖于Redis和Postgres数据库。Redis用于缓存搜索结果和中间数据,提高系统性能。Postgres用于存储用户信息、研究历史等持久化数据。

Gemini Fullstack LangGraph Quickstart的应用场景分析

Gemini Fullstack LangGraph Quickstart的应用场景非常广泛,几乎可以应用于任何需要信息收集、分析和整理的领域。以下将介绍其在不同领域的应用:

学术研究:

对于学术研究人员来说,Gemini Fullstack LangGraph Quickstart可以作为一个强大的文献资料整理工具。它可以快速搜索、筛选和整理大量的学术论文、研究报告等资料,帮助研究人员快速了解研究领域的最新进展。此外,它还可以根据研究人员的需求,生成研究报告,提高研究效率。

市场调研:

在市场调研领域,Gemini Fullstack LangGraph Quickstart可以实时收集市场信息,分析竞争对手的动态、消费者需求、行业趋势等。这些信息对于企业制定市场策略、优化产品设计、提高销售额至关重要。

新闻报道:

对于新闻记者来说,Gemini Fullstack LangGraph Quickstart可以快速生成新闻稿件。它可以自动搜索、整理和分析新闻事件的相关信息,帮助记者快速撰写出客观、准确、全面的新闻报道。

教育辅导:

在教育领域,Gemini Fullstack LangGraph Quickstart可以辅助教学,整理学习资料。它可以根据学生的学习需求,自动搜索、筛选和整理相关的学习资料,帮助学生更好地理解和掌握知识。

企业知识管理:

对于企业来说,Gemini Fullstack LangGraph Quickstart可以收集行业动态,辅助战略规划。它可以自动搜索、整理和分析行业信息、竞争对手信息、政策法规等,帮助企业了解行业发展趋势,制定正确的战略规划。

Gemini Fullstack LangGraph Quickstart的未来展望

随着人工智能技术的不断发展,Gemini Fullstack LangGraph Quickstart在未来的发展前景非常广阔。以下将展望其未来的发展方向:

更智能的信息分析:

未来的Gemini Fullstack LangGraph Quickstart将能够更智能地分析信息,不仅仅是简单地搜索和整理信息,而是能够深入理解信息的含义,发现信息之间的关联,从而为用户提供更深入、更有价值的 insights。

更个性化的用户体验:

未来的Gemini Fullstack LangGraph Quickstart将能够根据用户的个性化需求,提供更定制化的服务。例如,根据用户的研究领域、研究兴趣、研究习惯等,自动调整搜索策略、信息分析方法、答案生成方式等,从而提供更符合用户需求的体验。

更强大的知识图谱:

未来的Gemini Fullstack LangGraph Quickstart将构建更强大的知识图谱,将各种信息以图结构的形式组织起来,从而更好地理解信息之间的关系,发现潜在的知识。这将极大地提高信息检索和分析的效率。

更广泛的应用场景:

随着技术的不断发展,Gemini Fullstack LangGraph Quickstart的应用场景将更加广泛。它不仅仅可以应用于学术研究、市场调研、新闻报道等领域,还可以应用于金融分析、医疗诊断、法律咨询等更多领域。

Gemini Fullstack LangGraph Quickstart作为一个开源的全栈AI研究助手,为开发者提供了一个快速构建智能研究工具的平台。通过动态搜索查询生成、网络研究、反思与知识缺口分析、迭代优化以及综合答案生成等功能,它极大地提高了信息收集和分析的效率。其技术原理涵盖了前端界面、后端智能体以及开发部署等多个层面,保证了系统的稳定性和可扩展性。随着人工智能技术的不断发展,Gemini Fullstack LangGraph Quickstart在未来的应用前景将更加广阔,它将成为科研人员、开发者以及各行各业人士的得力助手。