在人工智能领域,视觉注意力机制一直是研究的热点。近日,香港大学与英伟达合作,推出了一种名为广义空间传播网络(GSPN)的新型视觉注意力机制,该机制在高分辨率图像生成方面实现了显著的性能提升,速度提升超过84倍。这一突破性的研究成果,无疑为未来的多模态模型和实时视觉应用开辟了新的可能性。

长期以来,传统的自注意力机制在自然语言处理和计算机视觉领域都取得了显著的成果。然而,当处理高分辨率图像时,这种机制面临着计算量巨大和空间结构损失的双重挑战。传统的自注意力机制的计算复杂度为O(N²),这意味着处理长上下文时会消耗大量的计算资源,效率低下。此外,将二维图像转化为一维序列会导致空间关系的丢失,这对于图像处理任务来说是一个严重的缺陷。

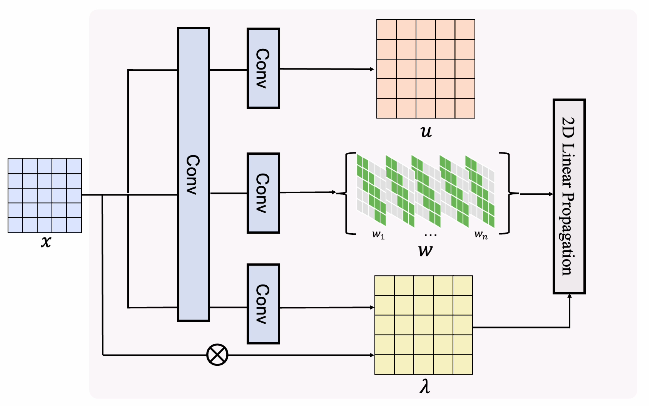

为了克服这些问题,香港大学和英伟达的研究团队提出了GSPN。GSPN采用了一种创新的二维线性传播方法,并结合了“稳定性–上下文条件”理论,将计算复杂度降低到√N级别,同时保留了图像的空间连贯性。这种新的机制不仅大幅提升了计算效率,还在多个视觉任务上刷新了性能纪录,为高分辨率图像处理带来了革命性的突破。

GSPN的核心技术主要包括两个关键部分:二维线性传播和稳定性 - 上下文条件。二维线性传播通过逐行或逐列的线扫描,实现了对二维图像的高效处理。与传统的注意力机制相比,GSPN不仅减少了参数量,还保持了信息的完整传播,避免了空间信息的丢失。此外,研究人员还提出了稳定性 - 上下文条件,确保在长距离传播时系统的稳定性与可靠性,使得GSPN在处理复杂图像时能够保持卓越的性能。

在实验中,GSPN展现出了令人瞩目的性能。在图像分类任务中,GSPN在5.3GFLOPs的计算量下,实现了82.2%的Top-1准确率,超越了多种现有的模型。这一结果充分证明了GSPN在图像分类方面的优越性。更令人印象深刻的是,在图像生成方面,GSPN在处理256×256的任务时,生成速度提升了1.5倍。尤其是在文本到图像生成任务中,GSPN能够在16K×8K分辨率下进行快速生成,推理时间加速超过84倍,这充分展示了其在实际应用中的巨大潜力。

GSPN的成功,得益于其独特的设计理念和结构。通过创新的二维线性传播机制,GSPN在保持空间连贯性的同时,实现了计算效率的显著提升。这种设计不仅解决了传统自注意力机制在高分辨率图像处理中的计算复杂度和空间结构损失问题,还为未来的多模态模型和实时视觉应用开辟了新的可能。GSPN的出现,标志着视觉注意力机制在高分辨率图像处理领域迈出了重要一步。

GSPN的优势与创新

GSPN的成功并非偶然,其背后蕴含着多方面的优势与创新。

- 计算效率的显著提升:GSPN采用二维线性传播方法,将计算复杂度降低到√N级别,这使得处理高分辨率图像成为可能。传统的自注意力机制由于计算复杂度过高,难以应用于高分辨率图像处理,而GSPN的出现彻底改变了这一局面。

- 空间连贯性的保持:GSPN在处理图像时,能够保持图像的空间连贯性,避免了信息的丢失。这对于图像处理任务来说至关重要,因为图像的空间结构蕴含着丰富的信息,对于理解图像内容具有重要意义。

- 稳定性与可靠性:GSPN提出的稳定性 - 上下文条件,确保了系统在长距离传播时的稳定性与可靠性。这使得GSPN在处理复杂图像时,能够保持卓越的性能,不会因为距离过长而导致信息衰减。

- 广泛的应用前景:GSPN在图像分类、图像生成等多个视觉任务中都取得了显著的成果,这表明其具有广泛的应用前景。尤其是在文本到图像生成任务中,GSPN能够在16K×8K分辨率下进行快速生成,这为未来的多模态模型和实时视觉应用开辟了新的可能。

GSPN的技术细节

要深入理解GSPN的优势,需要对其技术细节进行更深入的探讨。

二维线性传播

二维线性传播是GSPN的核心技术之一。传统的自注意力机制需要计算图像中每个像素与其他所有像素之间的关系,这导致计算复杂度呈平方增长。而GSPN采用逐行或逐列的线扫描方式,只需要计算每个像素与其所在行或列的其他像素之间的关系,从而将计算复杂度降低到线性级别。这种方法不仅减少了计算量,还保持了信息的完整传播,避免了空间信息的丢失。

稳定性 - 上下文条件

稳定性 - 上下文条件是GSPN的另一项关键技术。在长距离传播时,信息容易衰减,导致系统不稳定。为了解决这个问题,GSPN提出了稳定性 - 上下文条件,通过引入上下文信息,增强了系统的稳定性。具体来说,GSPN在传播信息时,不仅考虑了当前像素的信息,还考虑了其周围像素的信息,从而使得信息传播更加稳定可靠。

GSPN的应用案例

GSPN的卓越性能,使其在多个领域都具有广泛的应用前景。

图像分类

在图像分类任务中,GSPN能够有效地提取图像的特征,并将其用于图像分类。实验结果表明,GSPN在5.3GFLOPs的计算量下,实现了82.2%的Top-1准确率,超越了多种现有的模型。这充分证明了GSPN在图像分类方面的优越性。

图像生成

在图像生成方面,GSPN能够根据给定的条件生成高质量的图像。例如,在文本到图像生成任务中,GSPN能够根据给定的文本描述,生成与之对应的图像。实验结果表明,GSPN在处理256×256的任务时,生成速度提升了1.5倍。尤其是在文本到图像生成任务中,GSPN能够在16K×8K分辨率下进行快速生成,推理时间加速超过84倍。这充分展示了其在实际应用中的巨大潜力。

多模态模型

GSPN的出现,为多模态模型的发展带来了新的机遇。多模态模型是指能够同时处理多种类型数据的模型,例如文本、图像、音频等。GSPN能够有效地处理图像数据,并将其与其他类型的数据进行融合,从而实现更强大的功能。例如,可以将GSPN与自然语言处理模型结合,构建一个能够根据文本描述生成图像的多模态模型。

实时视觉应用

GSPN的高效性,使其在实时视觉应用中具有广泛的应用前景。实时视觉应用是指需要实时处理图像数据的应用,例如自动驾驶、视频监控等。GSPN能够快速处理图像数据,并提取出关键信息,从而实现实时视觉应用的功能。

GSPN的局限性与未来发展方向

尽管GSPN取得了显著的成果,但仍然存在一些局限性。

- 对硬件的要求较高:GSPN虽然降低了计算复杂度,但仍然需要一定的计算资源。在处理高分辨率图像时,需要高性能的硬件设备才能保证其运行效率。

- 对数据的依赖性较强:GSPN的性能受到数据质量的影响。如果训练数据质量不高,GSPN的性能可能会下降。

未来,GSPN的研究可以从以下几个方面展开:

- 进一步降低计算复杂度:虽然GSPN已经将计算复杂度降低到√N级别,但仍然有进一步降低的空间。可以尝试采用更高效的算法,进一步减少计算量。

- 提高对噪声数据的鲁棒性:在实际应用中,数据往往存在噪声。可以尝试采用一些技术,提高GSPN对噪声数据的鲁棒性,使其在噪声环境下也能保持良好的性能。

- 探索更多的应用场景:GSPN在图像分类、图像生成等领域已经取得了显著的成果,但仍然有许多潜在的应用场景。可以尝试将GSPN应用于更多的领域,例如医学图像分析、遥感图像处理等。

结论

总而言之,香港大学与英伟达合作推出的GSPN,是一种具有创新性的视觉注意力机制。它通过采用二维线性传播方法和稳定性 - 上下文条件,有效降低了计算复杂度,并保持了图像的空间连贯性。GSPN在图像分类、图像生成等多个视觉任务中都取得了显著的成果,为未来的多模态模型和实时视觉应用开辟了新的可能。虽然GSPN仍然存在一些局限性,但随着研究的深入,相信它将在未来发挥更大的作用,推动人工智能领域的发展。