AI技术革新浪潮下的行业新动态

在科技日新月异的今天,人工智能(AI)正以前所未有的速度渗透到各行各业,重塑着我们的工作和生活方式。本文将深入探讨近期AI领域的几项重大进展,从微软必应的视频创作工具到小米的商标转让,再到谷歌的离线AI应用,逐一剖析这些技术创新背后的驱动力及其潜在影响。

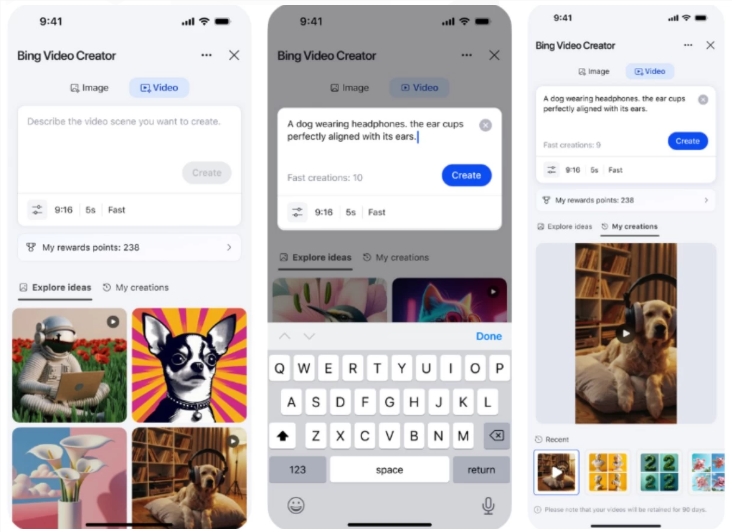

微软必应的视频创作工具:AI赋能内容创作

微软必应近期推出了全新的视频创作工具,这一举措无疑将降低视频内容的生产门槛。用户只需输入简单的文本提示,即可利用OpenAI Sora模型免费生成短视频。虽然目前该工具仅支持移动设备,且生成速度相对较慢,但其背后的意义不容忽视。这标志着AI在内容创作领域迈出了重要一步,预示着未来内容生产将更加高效、便捷。

然而,我们也应看到,目前该工具的局限性依然存在。仅支持移动设备限制了部分用户的使用体验,而生成速度较慢则可能影响用户的创作效率。此外,免费生成10段视频后需要付费的机制,也可能成为用户进一步使用的障碍。尽管如此,我们有理由相信,随着技术的不断进步,这些问题都将得到有效解决。

小米转让“Kimi”商标:战略调整还是另有深意?

小米将多枚“Kimi”商标转让给专注于AI助手的月之暗面,这一举动引发了业界的广泛关注。这可能是小米优化资源配置、专注于核心业务的战略调整,也可能暗示着小米在AI助手领域的布局有所变化。对于月之暗面而言,获得“Kimi”商标无疑将有助于其智能助手业务的拓展,提升品牌知名度和市场竞争力。

此次商标转让的背后,反映出AI市场竞争的日益激烈。各家企业都在积极寻求自身定位,通过战略合作、资源整合等方式,提升自身在AI领域的竞争力。未来,类似的合作与调整可能会更加频繁,AI市场的格局也将随之发生变化。

ElevenLabs的语音交互平台:更懂你的AI语音助手

ElevenLabs推出了Conversational AI 2.0,这是一个全新的语音交互平台,旨在打造比真人更懂你的AI语音助手。该平台在对话流畅性、多语言支持和企业级应用能力上实现了重大突破,为客服、营销和内容创作等领域带来了全新的可能性。通过引入先进的轮流对话模型,Conversational AI 2.0能够精准捕捉用户对话节奏,避免中断,提升对话流畅性。同时,该平台还支持32+语言无缝切换,内置自动语言检测功能,助力全球化企业客户服务。此外,Conversational AI 2.0还集成了RAG技术,能够从企业知识库提取信息,确保回答的专业性和准确性。

谷歌Gemini Live功能:开启AI识别新体验

谷歌的Gemini Live功能已正式登陆iOS平台,为用户带来了全新的AI识别体验。该功能支持AI识别场景和屏幕内容,且目前免费使用。通过摄像头和屏幕共享,Gemini Live能够为用户提供便捷的信息获取体验。例如,用户可以使用Gemini Live识别身边的植物,获取植物的详细信息;也可以通过屏幕共享,与朋友一起探讨某个问题,并获得AI的实时解答。然而,目前Gemini Live仅限美国地区用户使用,这无疑限制了其在全球范围内的推广。

Character.AI的AvatarFX工具:个性化动画视频创作的新选择

Character.AI推出了AvatarFX工具,允许用户创建自定义动画视频。用户可以通过简单的操作,制作出具有个性化风格的动画角色,并将其应用到各种场景中。此外,Character.AI还新增了“场景”和“流”功能,让用户能够更方便地分享自己的角色创作。然而,Character.AI也面临着滥用问题,平台存在一定的安全隐患。用户在使用AvatarFX工具时,需要注意保护个人信息,避免受到不必要的骚扰。

OpenAI重写Codex CLI:拥抱Rust语言

OpenAI宣布将其AI编程工具Codex CLI从Node.js迁移到Rust语言重写,这一举措旨在提升性能、增强安全性,并实现零依赖安装。Rust语言以其高性能、高安全性和并发性而闻名,被誉为“下一代C++”。通过使用Rust语言重写Codex CLI,OpenAI能够更好地满足AI编程领域的需求。此外,Rust语言还支持沙箱环境运行,增强了跨平台兼容性。

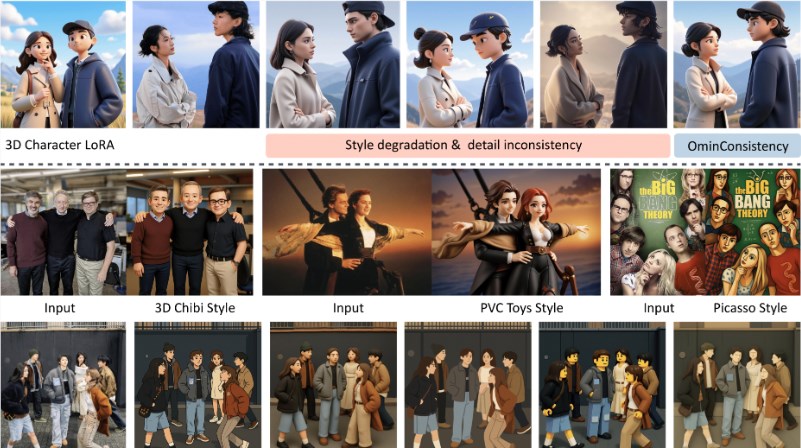

新加坡国立大学的OmniConsistency项目:低成本实现图像风格化一致性

新加坡国立大学团队发布了OmniConsistency项目,该项目通过独特的学习框架和模块化架构,在极低成本下实现了图像风格化与一致性的完美结合。OmniConsistency利用配对图像数据学习风格迁移一致性,仅需2600对高质量图像和500小时GPU算力即可达到惊艳效果。此外,OmniConsistency还支持模块化架构,兼容现有风格化LoRA模块,能够轻松整合进各类项目。这一项目的发布,为开发者提供了一个强大的工具,有望推动AI艺术创作的发展。

Hume AI的EVI3模型:更懂情绪的语音AI

Hume AI发布了第三代语音交互模型EVI3,该模型具备卓越的情感理解能力和个性化交互体验。EVI3能够精准识别用户语音中的情绪,并生成特定风格的声音和个性,实现情感智能与语音交互的完美融合。此外,EVI3还具备超低延迟与智能响应,推理延迟低至300毫秒,情感表达和自然度超越GPT-4o。EVI3的应用场景非常广泛,包括客户服务、内容创作等。未来,Hume AI还将扩展EVI3的多语言支持,以覆盖全球市场。

苹果的AI战略:内部强大却拒绝发布?

有消息称,苹果将在WWDC上开放基础模型,但性能有限,且其更强大的内部AI模型未有公开计划。据称,苹果内部拥有媲美ChatGPT的1500亿参数AI模型,但仅用于内部测试,未有公开计划。领导层分歧导致多项AI项目延期,WWDC更多是营销包装秀。这一消息引发了业界对于苹果AI战略的猜测。苹果究竟在AI领域有何打算?我们拭目以待。

谷歌的AI Edge Gallery应用:实现离线智能手机AI处理

谷歌推出了AI Edge Gallery应用,允许用户在手机上离线运行复杂的AI模型,增强隐私保护。AI Edge Gallery支持Hugging Face模型下载,提供多轮对话、视觉问答等AI功能,所有处理在本地完成。这种本地处理方式能够有效解决隐私问题,尤其适合医疗和金融等敏感行业。然而,AI Edge Gallery的安装和使用体验仍有提升空间。

Cerebras推理API:每日百万免费Token助力AI推理

Cerebras Systems宣布其推理API全面开放,取消等待名单限制,并提供每日百万免费Token,显著提升AI推理效率,尤其在实时语音、视频处理等领域表现卓越。Cerebras的推理API不仅降低了开发者的成本,还提供了强大的性能支持。据称,Cerebras的推理速度可达GPU的20倍,尤其适用于复杂推理模型及代码生成任务。此外,Cerebras的推理API还支持主流开源模型,能够无缝嵌入Hugging Face和Meta平台,简化开发者流程。

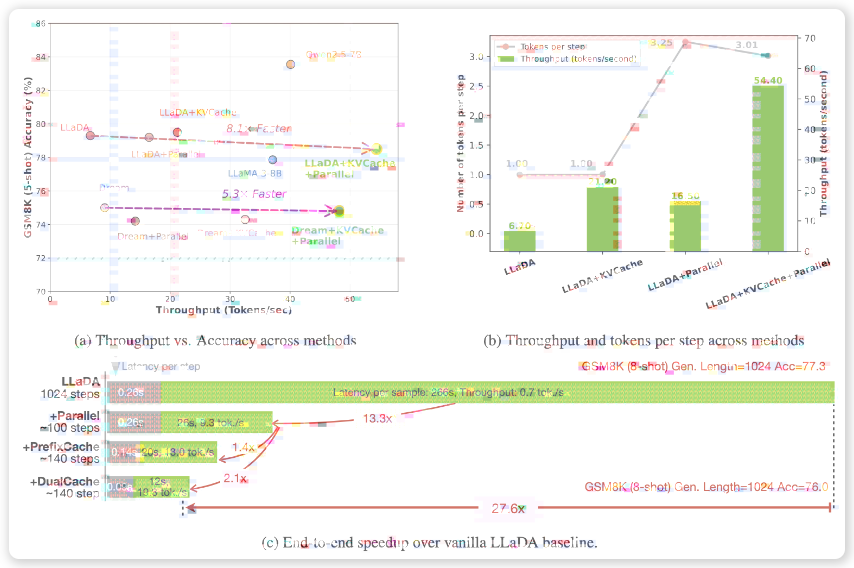

英伟达与MIT合作推出Fast-dLLM框架:AI推理速度提升27.6倍

英伟达联合MIT与香港大学发布了Fast-dLLM框架,通过创新机制大幅提升扩散模型推理速度,同时保持生成质量,为AI应用提供强大支持。Fast-dLLM框架通过块状近似KV缓存机制,实现了最高27.6倍的推理速度提升。此外,Fast-dLLM框架还采用了置信度感知并行解码策略,确保生成质量,减少依赖冲突。多项基准测试显示,Fast-dLLM框架在速度与准确率之间实现了良好的平衡,有望推动扩散模型的广泛应用。

结语

综上所述,AI技术正在以前所未有的速度发展,并深刻影响着各行各业。从内容创作到语音交互,从图像风格化到AI推理,各种创新应用层出不穷。我们有理由相信,在不久的将来,AI将为我们带来更加美好的生活。