在人工智能领域,模型创新层出不穷。最近,MiniMax团队开源了其最新的推理模型——MiniMax-M1,这款模型一经发布,便引起了业界的广泛关注。它不仅在技术架构上有所突破,更在实际应用中展现出卓越的性能。本文将深入探讨MiniMax-M1的技术原理、性能表现、应用场景以及定价策略,以便读者全面了解这款备受瞩目的AI模型。

MiniMax-M1:技术架构的创新融合

MiniMax-M1模型的核心在于其混合专家架构(MoE)与闪电注意力机制(lightning attention)的巧妙结合。这种结合不仅提升了模型的计算效率,还增强了其处理复杂任务的能力。模型总参数量高达4560亿,但每次token激活仅使用459亿参数,这种设计使得MiniMax-M1在保持高性能的同时,降低了计算成本。

混合专家架构(MoE):并行处理的强大引擎

MoE架构是MiniMax-M1的一大亮点。它将模型分解为多个专家模块,每个模块专注于处理特定的子任务或数据子集。这种架构的优势在于,它可以根据输入数据的特征,动态地将数据分配给不同的专家模块进行处理,从而实现高效的计算资源利用和并行处理能力。MoE架构使得MiniMax-M1在处理大规模数据和复杂任务时,能够保持卓越的性能。

闪电注意力机制(Lightning Attention):效率提升的关键

注意力机制是深度学习模型中的重要组成部分,它可以帮助模型更好地关注输入序列中的关键信息。MiniMax-M1采用的闪电注意力机制,通过优化计算流程和减少冗余计算,显著提高了注意力模块的效率。此外,闪电注意力机制还采用了稀疏注意力模式,仅关注输入序列中的关键部分,进一步降低了计算复杂度。这使得MiniMax-M1能够高效地处理长序列数据,支持高达100万token的上下文。

大规模强化学习(RL)训练:性能优化的保障

为了进一步提升模型的性能,MiniMax团队采用了大规模强化学习(RL)进行训练。通过基于奖励信号优化模型的输出,使其在复杂任务中表现更好。MiniMax团队还提出了一种新的RL算法CISPO,该算法基于裁剪重要性采样权重而不是token更新,从而提高了训练效率和模型性能。此外,混合注意力设计自然增强了RL的效率,解决了混合架构在扩展RL时的独特挑战。

MiniMax-M1的主要功能特性

MiniMax-M1作为一款强大的推理模型,具备多项引人注目的功能,使其在各种应用场景中都能发挥重要作用。

- 长上下文处理:MiniMax-M1支持高达100万token的输入和8万token的输出,这使得它能够轻松处理长文档和复杂推理任务。无论是分析长篇报告,还是生成详细的学术论文,MiniMax-M1都能胜任。

- 高效推理:MiniMax-M1提供40K和80K两种推理预算版本,用户可以根据实际需求选择合适的版本。这种设计不仅优化了计算资源,还降低了推理成本,使得MiniMax-M1在经济性和效率之间取得了平衡。

- 多领域任务优化:MiniMax-M1在数学推理、软件工程、长上下文理解和工具使用等多个领域都表现出色。这意味着它可以广泛应用于各种应用场景,满足不同用户的需求。

- 功能调用:MiniMax-M1支持结构化功能调用,能够识别和输出外部函数调用参数,从而方便与外部工具进行交互。这一功能使得MiniMax-M1可以作为智能助手的核心,与其他工具协同工作,完成更复杂的任务。

MiniMax-M1的卓越性能表现

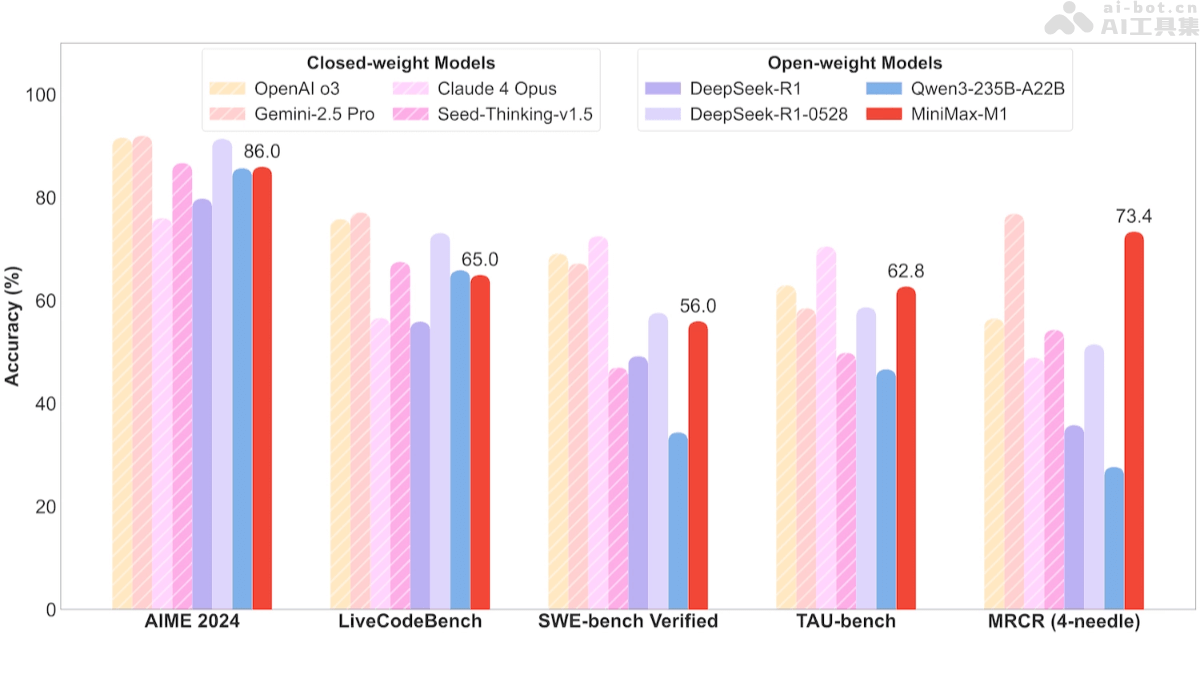

MiniMax-M1在多个基准测试中都取得了令人瞩目的成绩,证明了其强大的性能和广泛的适用性。

- 软件工程任务:在SWE-bench验证基准上,MiniMax-M1-40k和MiniMax-M1-80k分别取得了55.6%和56.0%的成绩。虽然略逊于DeepSeek-R1-0528的57.6%,但显著超越了其他开源权重模型。这表明MiniMax-M1在代码生成、优化和调试等方面具有很强的实力。

- 长上下文理解任务:依托百万级上下文窗口,MiniMax-M1在长上下文理解任务中表现卓越,全面超越所有开源权重模型,甚至超越OpenAI o3和Claude 4 Opus,全球排名第二,仅以微弱差距落后于Gemini 2.5 Pro。这充分证明了MiniMax-M1在处理长文本和理解复杂语境方面的优势。

- 工具使用场景:在代理工具使用场景(TAU-bench)中,MiniMax-M1-40k领跑所有开源权重模型,甚至战胜了Gemini-2.5 Pro。这表明MiniMax-M1在智能助手和自动化解决方案方面具有巨大的潜力。

MiniMax-M1的应用场景展望

MiniMax-M1凭借其卓越的性能和多项功能,可以在多个领域发挥重要作用。

- 复杂软件工程:MiniMax-M1可以支持代码生成、优化、调试和文档生成,从而帮助开发者快速实现功能模块,提升开发效率。例如,开发者可以使用MiniMax-M1自动生成代码框架,减少重复性工作,从而将更多精力投入到核心业务逻辑的开发中。

- 长文本处理:MiniMax-M1能够生成长篇报告、学术论文、小说等,同时支持长文本分析和多文档总结,满足多样化需求。例如,研究人员可以使用MiniMax-M1分析大量的学术文献,快速提取关键信息,从而加速研究进程。

- 数学与逻辑推理:MiniMax-M1可以解决复杂数学问题,如竞赛数学题目和数学建模,处理逻辑推理任务,提供清晰的解题思路。例如,学生可以使用MiniMax-M1辅助学习数学,理解解题思路,提高解题能力。

- 工具使用与交互:MiniMax-M1可以作为智能助手调用外部工具,完成多步骤任务,提供自动化解决方案,提升工作效率。例如,企业可以使用MiniMax-M1构建智能客服系统,自动处理用户咨询,提高客户满意度。

MiniMax-M1的定价策略

对于开发者和企业用户而言,了解MiniMax-M1的定价策略至关重要。MiniMax-M1的定价主要分为API调用推理成本定价和APP/Web端使用定价两种。

- API调用推理成本定价:

- 0-32k 输入长度:

- 输入成本:0.8元/百万 token。

- 输出成本:8元/百万 token。

- 32k-128k 输入长度:

- 输入成本:1.2元/百万 token。

- 输出成本:16元/百万 token。

- 128k-1M 输入长度:

- 输入成本:2.4元/百万 token。

- 输出成本:24元/百万 token。

- 0-32k 输入长度:

- APP和Web端:在 MiniMax APP 和 Web 上保持不限量免费使用。

这种定价策略使得用户可以根据实际需求选择合适的方案,降低使用成本。对于个人用户而言,可以通过APP和Web端免费体验MiniMax-M1的强大功能。对于企业用户而言,可以根据API调用量选择合适的付费方案,从而满足不同的业务需求。

MiniMax-M1:开源社区的积极贡献

MiniMax团队选择开源MiniMax-M1,无疑是对AI社区的积极贡献。通过开源,MiniMax-M1可以吸引更多的开发者参与其中,共同推动模型的发展和完善。此外,开源还有助于提高模型的透明度和可信度,促进AI技术的普及和应用。

以下是MiniMax-M1的项目地址:

- GitHub仓库:https://github.com/MiniMax-AI/MiniMax-M1

- HuggingFace模型库:https://huggingface.co/collections/MiniMaxAI/minimax-m1

- 技术论文:https://github.com/MiniMax-AI/MiniMax-M1/blob/main/MiniMax_M1_tech_report

总结

MiniMax-M1作为MiniMax团队的最新力作,凭借其创新的技术架构、卓越的性能表现和广泛的应用前景,必将在AI领域掀起一股新的浪潮。无论是对于开发者、研究人员还是企业用户而言,MiniMax-M1都值得深入了解和应用。随着AI技术的不断发展,我们有理由相信,MiniMax-M1将在未来的AI领域发挥更加重要的作用。