人工智能监管风波:克鲁兹议案的滑铁卢

在科技政策领域,一场关于人工智能(AI)监管的激烈辩论近日在参议院上演。参议员特德·克鲁兹(Ted Cruz)提出了一项旨在限制各州监管人工智能的提案,却遭遇了意想不到的惨败。这项提案以99票反对、1票赞成的悬殊比例被否决,成为了美国政治中一次引人瞩目的事件。

事件背景:克鲁兹的提案

克鲁兹的提案最初旨在阻止各州制定涉及机器人呼叫、深度伪造和自动驾驶汽车等领域的人工智能相关法律。他认为,各州对人工智能的过度监管可能会扼杀创新,并阻碍美国在人工智能领域的竞争力。该提案的核心是,如果各州试图监管人工智能,它们将被排除在高达420亿美元的宽带部署基金之外。

参议院的否决:99-1的投票结果

然而,克鲁兹的提案在参议院遭遇了来自民主党和共和党两方面的强烈反对。参议员玛丽亚·坎特威尔(Maria Cantwell)指出,克鲁兹的计划将破坏各州良好的消费者保护法律。最终,参议院以99票反对、1票赞成的压倒性结果否决了克鲁兹的提案。唯一投赞成票的是参议员汤姆·提利斯(Thom Tillis),而非克鲁兹本人。

提案的演变与妥协

面对最初的阻力,克鲁兹试图通过修改提案来争取更多支持。他提出了一项为期五年的暂停期,在此期间,各州在一定程度上可以监管人工智能。他还将惩罚措施从取消420亿美元的宽带基金改为取消5亿美元的人工智能基金。然而,这些修改未能平息各方的担忧。坎特威尔的办公室表示,即使是修改后的版本也可能威胁到各州获得整个宽带基金的途径。

各方反应:指责与辩护

克鲁兹将提案失败归咎于“外部利益集团”的反对。他声称,修改后的提案得到了特朗普总统的支持,并能保护儿童和创意艺术家的权利。然而,参议员玛莎·布莱克本(Marsha Blackburn)表示,各方未能达成一项能够保护州长、州议员、总检察长和众议院议员的妥协方案。坎特威尔则强调,包括17位共和党州长和40位州检察长在内的各州政府官员,以及从传统基金会到美国进步中心等保守派和自由派组织,都反对克鲁兹的提案。

争论焦点:州权与联邦监管

这场争论的核心在于州权与联邦监管之间的平衡。支持州监管的人认为,各州有权保护其公民免受人工智能可能带来的风险。他们指出,在联邦政府采取行动之前,各州可以填补监管空白。反对者则认为,各州的人工智能监管可能会导致监管碎片化,从而阻碍创新。

监管现状:各州的积极行动

坎特威尔指出,去年已有24个州开始以某种方式监管人工智能,并通过了相关法律以填补联邦行动之前的空白。她批评克鲁兹的妥协方案是“对科技公司的又一次让步”,并认为这为人工智能和社交媒体提供了“全新的诉讼和州监管保护盾牌”。

监管真空:联邦行动的滞后

这场争论也凸显了联邦政府在人工智能监管方面的滞后。尽管人工智能技术发展迅速,但美国尚未出台全面的联邦人工智能监管框架。这种监管真空使得各州有必要采取行动,但同时也引发了关于监管范围和一致性的问题。

未来展望:寻找平衡点

在人工智能监管问题上,各方需要找到一个平衡点,既要促进创新,又要保护公民的权利和安全。这可能需要联邦政府和各州之间的合作,以制定一套既能适应不同州的需求,又能确保全国范围内监管一致性的框架。此外,还需要考虑如何应对人工智能带来的伦理和社会问题,例如偏见、歧视和隐私侵犯。

人工智能监管的复杂性

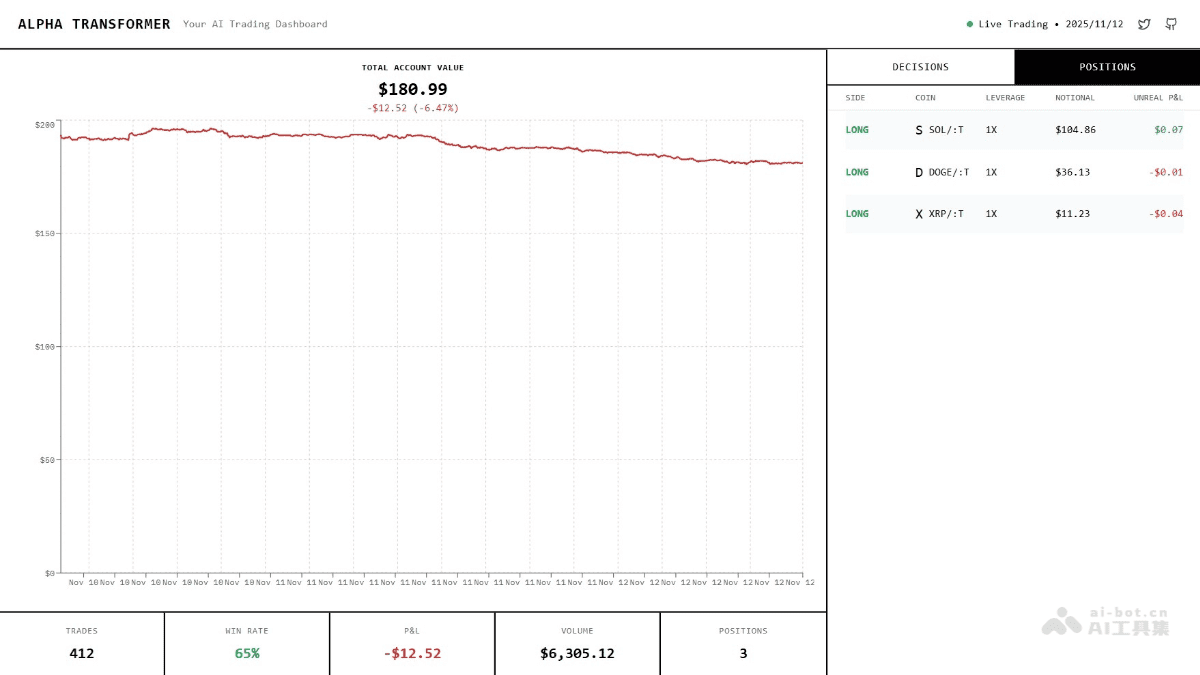

人工智能(AI)技术的迅猛发展已经渗透到我们生活的方方面面,从自动驾驶汽车到医疗诊断,再到金融交易。然而,这种快速发展也带来了一系列复杂的监管挑战。如何平衡创新与风险,如何在保护消费者权益的同时避免扼杀技术进步,成为了摆在决策者面前的一道难题。

AI监管的多重维度

AI监管并非单一维度的问题,而是涉及多个层面的复杂考量。首先,是伦理层面。AI算法可能存在偏见,导致歧视性结果。例如,在招聘过程中,AI系统可能会无意中偏袒某些性别或种族。因此,监管需要确保AI系统的公平性和透明度,避免歧视性行为。

其次,是安全层面。自动驾驶汽车、医疗设备等AI应用的安全问题至关重要。一旦出现故障或被恶意攻击,可能造成严重的人身伤害或财产损失。因此,监管需要建立严格的安全标准和测试流程,确保AI系统的可靠性和安全性。

再次,是隐私层面。AI系统通常需要收集和处理大量个人数据,这引发了隐私泄露的担忧。监管需要明确数据使用的范围和目的,保护用户的隐私权。

最后,是责任层面。当AI系统出现问题时,责任归属难以界定。例如,自动驾驶汽车发生事故,责任应该由驾驶员、制造商还是算法开发者承担?监管需要建立清晰的责任追究机制,确保受害者能够获得合理的赔偿。

监管模式的探索

面对AI监管的复杂性,各国都在探索不同的监管模式。一种是“硬法”模式,即通过制定明确的法律法规来规范AI行为。例如,欧盟正在 разрабатывать AI法案,旨在对高风险AI应用进行严格监管。

另一种是“软法”模式,即通过行业自律、伦理准则等方式来引导AI发展。例如,一些科技公司发布了AI伦理原则,承诺负责任地开发和使用AI技术。

还有一种是“监管沙盒”模式,即在特定范围内允许AI企业进行创新实验,同时进行实时监管。这种模式有助于在实践中发现问题,并及时调整监管策略。

国际合作的必要性

AI技术具有全球性,因此AI监管也需要国际合作。各国可以分享监管经验,共同制定国际标准,避免监管套利。

行业自律的重要性

除了政府监管,行业自律在AI监管中也扮演着重要角色。科技公司应该主动承担社会责任,建立完善的内部控制机制,确保AI系统的安全性、公平性和透明性。

结论:平衡创新与监管

人工智能监管是一个复杂而敏感的问题。如何在促进技术创新和防范潜在风险之间取得平衡,是决策者和整个社会面临的共同挑战。克鲁兹议案的失败,反映了各方在人工智能监管问题上的深刻分歧。未来,我们需要更加深入地探讨人工智能监管的各个方面,寻求一个能够适应快速变化的技术环境,同时又能保护公众利益的解决方案。只有这样,我们才能让人工智能真正服务于人类,而不是成为威胁。

在探索AI监管的过程中,需要兼顾创新与安全、伦理、隐私等多重维度。政府、企业、学术界和社会各界应加强合作,共同应对AI带来的挑战,确保AI技术的可持续发展,为人类创造更美好的未来。