在人工智能(AI)领域,版权问题日益凸显,尤其是在生成式AI模型能够复制甚至“记住”大量训练数据的情况下。最近的一项研究,聚焦于Meta公司开发的Llama 3.1模型,揭示了其在复现《哈利·波特与魔法石》内容方面的惊人能力,引发了业界对于AI版权侵权问题的广泛关注。

这项由斯坦福大学、康奈尔大学和西弗吉尼亚大学的计算机科学家和法学学者联合发布的研究,深入探讨了多个开源AI模型(包括Meta的Llama系列、微软和EleutherAI的模型)在复现Books3数据集中的文本内容的能力。Books3是一个广泛用于训练大型语言模型(LLM)的图书集合,其中包含了大量受版权保护的作品。

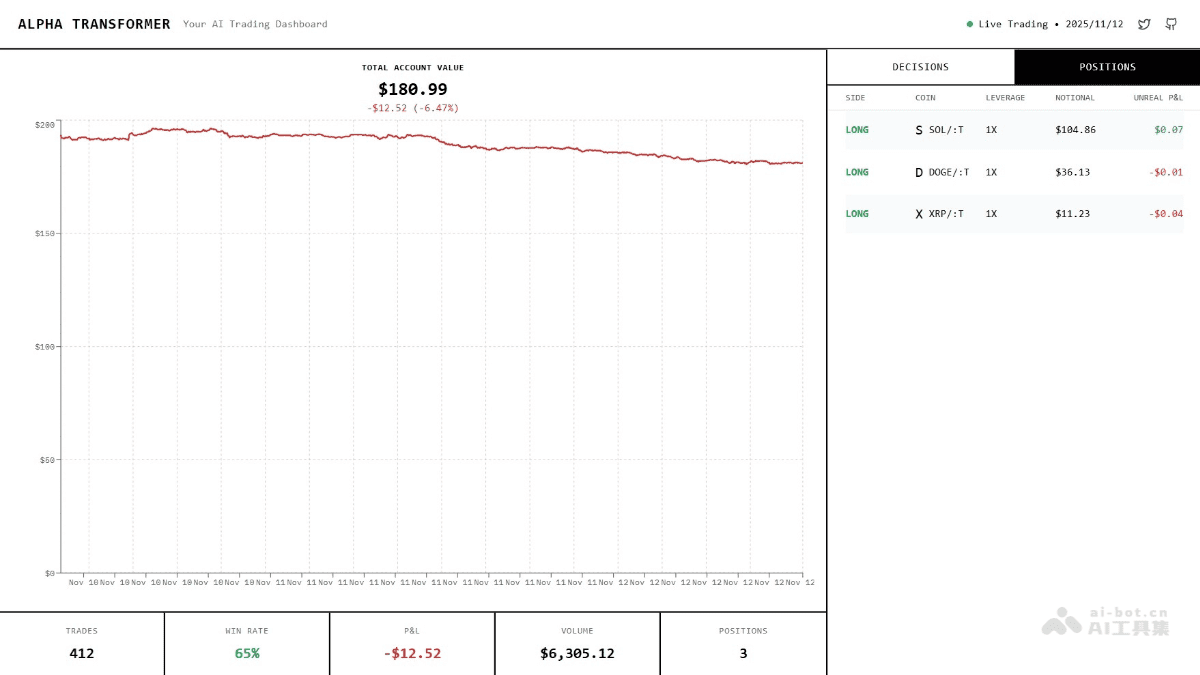

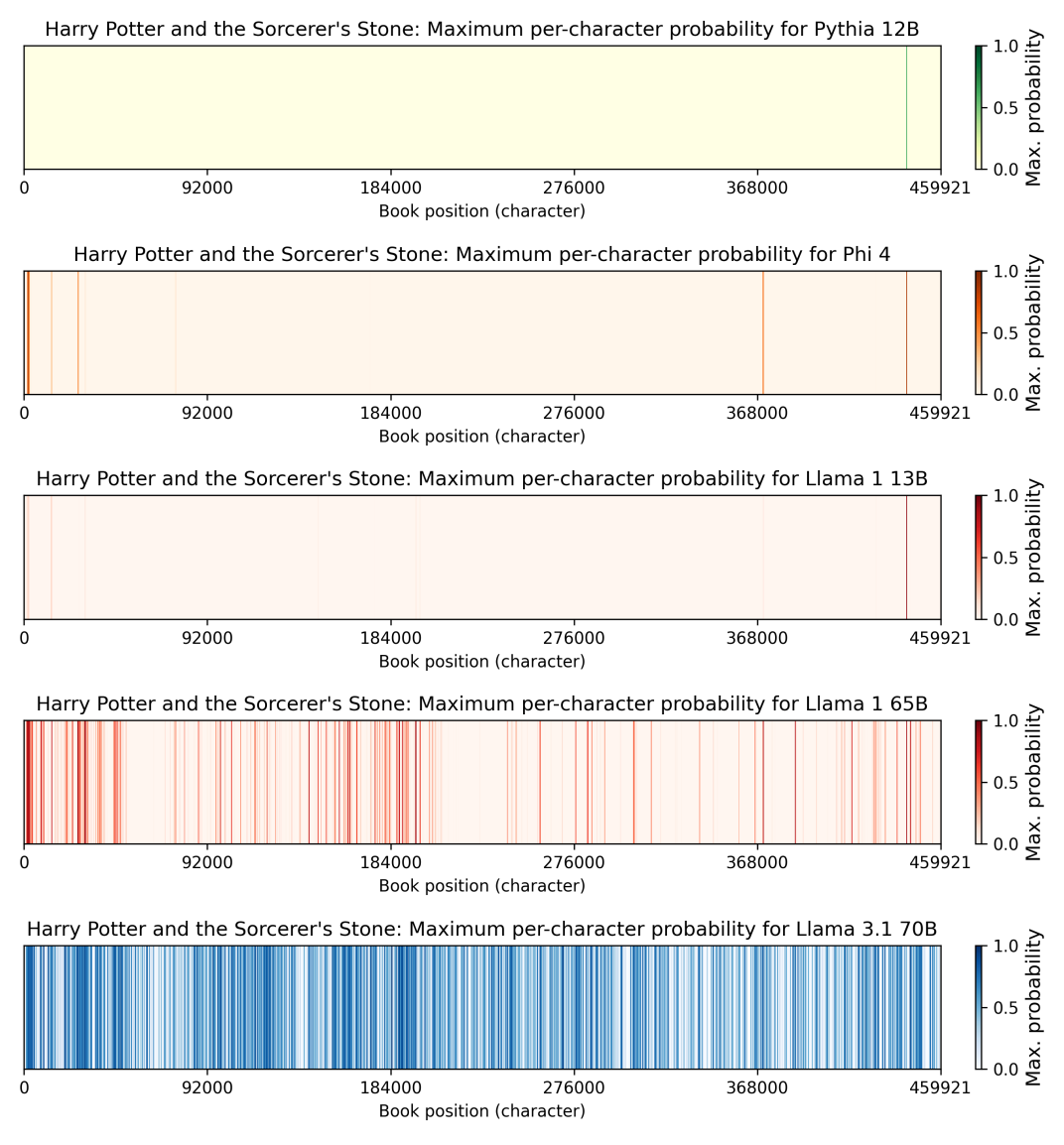

研究结果显示,Meta的Llama 3.1 70B模型在复现《哈利·波特与魔法石》的50个token片段方面表现突出,该模型能够以至少50%的概率复现这本书42%的内容。相比之下,Llama 1 65B模型仅能复现4.4%的内容。这一显著差异表明,尽管存在潜在的法律风险,Meta在训练Llama 3时并未采取足够的措施来防止模型记忆训练数据,甚至可能在无意中加剧了这一问题。

研究人员通过一种巧妙的方法来评估模型的记忆能力。他们没有直接生成大量文本并统计特定片段的出现频率,而是利用模型生成每个token的概率分布的特性,通过计算连续token序列的概率乘积来估计模型复现特定文本片段的可能性。这种方法大大降低了研究成本,使得分析更多书籍和精确估计极低概率成为可能。

例如,要估计模型用“peanut butter and jelly”响应“My favorite sandwich is”的可能性,研究人员会执行以下步骤:

- 向模型提示“My favorite sandwich is”,并查找“peanut”的概率(假设为20%)。

- 向模型提示“My favorite sandwich is peanut”,并查找“butter”的概率(假设为90%)。

- 向模型提示“My favorite sandwich is peanut butter”,并查找“and”的概率(假设为80%)。

- 向模型提示“My favorite sandwich is peanut butter and”,并查找“jelly”的概率(假设为70%)。

然后,将概率相乘:0.2 * 0.9 * 0.8 * 0.7 = 0.1008,预测模型大约10%的时间会生成“peanut butter and jelly”。

研究人员将36本书籍分割成重叠的100个token段落。使用前50个token作为提示,他们计算了接下来的50个token与原始段落相同的概率。如果模型以高于50%的概率逐字复现段落,则该段落被认为是“记忆”的。

值得注意的是,该研究采用的“记忆”定义非常严格。为了使50个token序列的概率大于50%,段落中平均每个token的概率需要至少达到98.5%。此外,研究人员仅统计完全匹配的情况,未考虑模型生成48或49个正确token的情况。如果将这些情况纳入考虑,记忆量可能会更高。

研究结果揭示了AI模型训练中潜在的版权风险。如果模型能够记住并复现受版权保护的作品,那么这是否构成对版权的侵犯?这一问题引发了法律界的广泛讨论。

目前,关于AI模型训练是否侵犯版权存在三种主要观点:

- 训练过程本身的侵权:认为使用受版权保护的作品进行训练,由于涉及到对作品的数字复制,因此构成侵权。

- 模型作为衍生作品的侵权:认为训练过程将训练数据中的信息复制到模型中,使得模型成为受版权法保护的衍生作品。

- 模型生成内容的侵权:认为当模型生成受版权保护作品的(部分)内容时,构成侵权。

AI行业普遍认为,在训练过程中使用受版权保护的作品属于合理使用,并援引2015年Google Books的判决作为支持。然而,Llama 3.1 70B模型对《哈利·波特》的大量记忆可能会影响法院对合理使用问题的看法。

合理使用分析的一个关键因素是使用是否具有“变革性”,即公司是否创造了新的东西,或者仅仅是从他人的作品中获利。语言模型能够复述大量流行作品(如《哈利·波特》、《1984》和《霍比特人》)的事实,可能会导致法官对这些合理使用论点持更加怀疑的态度。

此外,Google在图书案中的一个关键论点是,其系统旨在永远不会返回超过任何书籍的简短摘录。如果Meta诉讼中的法官想区分Meta的论点与Google在图书案中提出的论点,他可以指出Llama可以生成远远超过几行《哈利·波特》的内容。

这项新的研究“使被告在这些案件中一直在讲述的故事复杂化”,共同作者Mark Lemley告诉我。“也就是说,‘我们只是学习单词模式。这些都不会显示在模型中。’”

但《哈利·波特》的结果给Meta带来了更大的危险,根据第二种理论,Llama本身就是罗琳作品的衍生副本。

“很明显,你实际上可以从模型中提取《哈利·波特》和各种其他书籍的很大一部分,”Lemley说。“这向我表明,可能对于其中一些书籍,法律会称之为模型本身中书籍的一部分的副本。”

Google图书的先例可能无法保护Meta免受第二种法律理论的侵害,因为Google从未将其图书数据库提供给用户下载——如果Google这样做,几乎肯定会败诉。

原则上,Meta仍然可以说服法官,根据灵活的法官制定的合理使用原则,允许复制42%的《哈利·波特》。但这将是一场艰苦的战斗。

“你必须做的合理使用分析不仅仅是‘训练集是否合理使用’,而是‘模型中的包含是否合理使用?’”Lemley说。“这使被告的故事复杂化。”

康奈尔大学教授Grimmelmann也表示,这项研究可能会使开源模型比封闭模型面临更大的法律风险。康奈尔大学和斯坦福大学的研究人员只能进行他们的工作,因为作者可以访问底层模型——因此可以访问token概率值,从而可以有效地计算token序列的概率。

包括OpenAI、Anthropic和Google在内的大多数领先实验室越来越多地限制对此类所谓的logits的访问,从而使研究这些模型更加困难。

此外,如果一家公司将其模型权重保存在自己的服务器上,则可以使用过滤器来尝试防止侵权输出到达外部世界。因此,即使底层OpenAI、Anthropic和Google模型以与Llama 3.1 70B相同的方式记住了受版权保护的作品,公司外部的任何人可能都难以证明这一点。

此外,这种过滤使拥有封闭模型权重的公司更容易援引Google图书的先例。简而言之,版权法可能会对公司发布开源模型产生强大的抑制作用。

“这有点反常,”Mark Lemley告诉我。“我不喜欢这个结果。”

另一方面,法官可能会得出结论,惩罚公司发布开源模型是不利的。

“在某种程度上,开放和共享权重是一种公共服务,”Grimmelmann告诉我。“我真的可以看到法官对Meta和其他提供开源模型的人不太怀疑。”

这项研究还强调了AI模型训练数据来源的重要性。如果模型在包含大量受版权保护作品的数据集上进行训练,那么模型记忆这些作品的可能性就会大大增加。因此,AI公司需要更加谨慎地选择训练数据,并采取有效的措施来防止模型记忆和复现受版权保护的内容。

总的来说,这项关于Llama 3.1模型的研究为AI版权侵权问题提供了新的视角。它表明,AI模型在训练过程中可能会无意中记忆和复现受版权保护的作品,这可能会引发法律风险。随着AI技术的不断发展,我们需要更加深入地探讨AI版权问题,并制定合理的法律法规来平衡创新和版权保护之间的关系。