在人工智能领域,谷歌的Gemini模型系列一直备受瞩目。近日,谷歌宣布对其Gemini AI模型家族进行重大更新,标志着其AI技术进入了一个新的稳定发展阶段。其中,Gemini 2.5 Pro经过数月的调整和优化,现已脱离预览版,正式向开发者开放,这意味着开发者可以基于这一强大的模型构建各种应用。与此同时,谷歌还展示了其即将推出的高效模型Gemini 2.5 Flash-Lite,进一步丰富了Gemini家族的产品线。

谷歌在2025年的人工智能发展道路上,Gemini 2.5的亮相无疑是一个重要的里程碑。相较于之前的版本,Gemini 2.5在性能上有了显著提升,使得谷歌在与OpenAI及其流行的GPT模型的竞争中更具优势。然而,在全面开放使用之前,谷歌进行了大量的预览和测试版本发布工作,以确保模型的稳定性和可靠性,从而满足长期开发的需求。

值得注意的是,Gemini 2.5 Flash模型已在I/O大会上发布,而Gemini 2.5 Pro的正式发布则稍晚一些。现在,Flash模型已全面可用,版本号为04-17。Gemini 2.5 Pro也已从预览版过渡到正式版,并采用了最新的06-05版本。此版本旨在解决之前在Google I/O版本中出现的一些问题,并且从结果来看,效果显著。

谷歌现在拥有一系列Gemini模型,可以满足各种不同的任务需求。这种多样性使得开发者可以根据具体的应用场景选择最合适的模型,从而优化性能和成本。

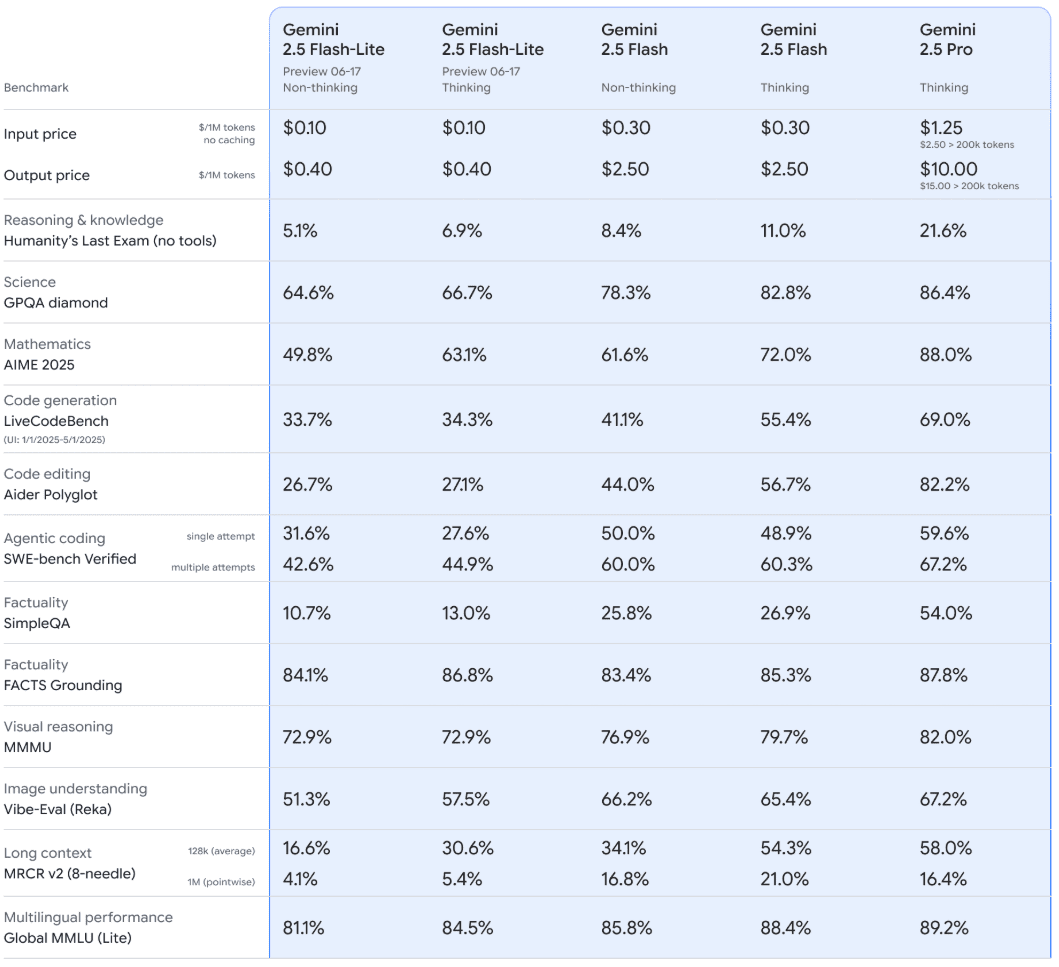

所有Gemini 2.5模型都具备可调节的思维预算功能,这对于希望更好地控制成本的开发者来说是一个福音。为了满足对价格更为敏感的开发者的需求,谷歌还推出了Gemini 2.5 Flash-Lite,这是一款之前处于实验阶段的模型。目前,该模型已进入预览阶段,为运行高容量AI工作负载提供了一种经济高效的解决方案。与2.5 Flash相比,Flash-Lite在文本、图像和视频输入方面的成本降低了三分之一,而在输出令牌方面的成本更是降低了六分之一以上。不过,这款Gemini的变体不太可能面向普通用户推出,因为它在能力上不如2.5 Flash,只有在按令牌付费的情况下才具有经济意义。

此外,Google Flash和Flash-Lite也开始应用于搜索领域。谷歌的发言人表示,这些模型的定制版本目前已应用于AI概览和AI模式中。谷歌通常会根据查询的具体情况选择最合适的模型。因此,复杂的AI模式搜索可能会使用2.5 Pro,而简单的搜索则可能依赖Flash甚至Flash-Lite来完成。

Flash-Lite的预览版现已在Google AI Studio和Vertex AI中面向开发者提供,同时提供的还有Gemini 2.5 Flash和Gemini 2.5 Pro的稳定版本。最终的2.5 Pro和2.5 Flash模型已经应用在APP中,因此您不会在APP中看到任何重大变化。Pro版本将像Flash上个月所做的那样删除预览标签,但功能不会有任何不同。免费用户仍然可以在APP中有限地访问2.5 Pro,而付费Pro用户每天可以获得更高的提示次数限制,每天100个提示。AI Ultra订阅者可以最高级别访问Gemini 2.5 Pro。

Gemini 2.5 Pro的架构与设计

Gemini 2.5 Pro的设计目标是提供一个既强大又灵活的AI模型,能够处理各种复杂的任务。其核心架构基于Transformer模型,但谷歌在此基础上进行了多项创新,以提高模型的性能和效率。首先,Gemini 2.5 Pro采用了更深的网络结构,使其能够捕捉到数据中更细微的模式和关系。其次,该模型引入了稀疏激活技术,这意味着在处理每个输入时,只有一部分神经元会被激活,从而减少了计算量和内存需求。此外,Gemini 2.5 Pro还支持多模态输入,可以同时处理文本、图像和音频等不同类型的数据。

为了进一步提高模型的性能,谷歌还采用了混合精度训练技术。这种技术允许模型在训练过程中使用不同的数据精度,从而在保证精度的前提下,加快训练速度并减少内存消耗。此外,Gemini 2.5 Pro还引入了自适应学习率调整机制,可以根据训练的进展情况动态调整学习率,从而提高模型的收敛速度和最终性能。

Gemini 2.5 Flash-Lite的优化策略

Gemini 2.5 Flash-Lite的设计目标是在保证一定性能的前提下,尽可能地降低计算成本和延迟。为了实现这一目标,谷歌采用了多种优化策略。首先,Flash-Lite采用了模型压缩技术,通过减少模型的参数数量和计算量,使其能够在资源受限的设备上运行。其次,该模型使用了知识蒸馏技术,将大型模型的知识迁移到小型模型中,从而在保证性能的同时,降低了模型的复杂度。

此外,Gemini 2.5 Flash-Lite还针对特定任务进行了优化。例如,在自然语言处理任务中,该模型采用了剪枝技术,去除了模型中不重要的连接,从而减少了计算量和内存需求。在图像处理任务中,该模型使用了量化技术,将模型的参数从浮点数转换为整数,从而加快了计算速度并降低了内存消耗。

Gemini 2.5在不同领域的应用案例

Gemini 2.5模型系列在各个领域都有广泛的应用前景。以下是一些具体的应用案例:

- 自然语言处理:Gemini 2.5 Pro可以用于文本生成、机器翻译、问答系统等任务。例如,它可以生成高质量的文章、翻译不同语言的文本、回答用户提出的问题等。Gemini 2.5 Flash-Lite则可以用于实时语音识别、文本分类等任务。例如,它可以将用户的语音实时转换为文本、将文本自动分类到不同的类别中。

- 图像处理:Gemini 2.5 Pro可以用于图像识别、图像生成、图像编辑等任务。例如,它可以识别图像中的物体、生成逼真的图像、编辑图像中的内容等。Gemini 2.5 Flash-Lite则可以用于人脸识别、图像搜索等任务。例如,它可以识别人脸、根据图像搜索相似的图像。

- 语音处理:Gemini 2.5 Pro可以用于语音识别、语音合成、语音翻译等任务。例如,它可以将语音转换为文本、将文本转换为语音、将一种语言的语音翻译成另一种语言的语音。Gemini 2.5 Flash-Lite则可以用于语音助手、智能家居等任务。例如,它可以作为语音助手与用户进行交互、控制智能家居设备。

- 搜索领域:Gemini 2.5 Flash和Flash-Lite的定制版本已应用于AI概览和AI模式中。这使得谷歌可以根据查询的具体情况选择最合适的模型,从而提高搜索效率和准确性。复杂的AI模式搜索可能会使用2.5 Pro,而简单的搜索则可能依赖Flash甚至Flash-Lite来完成。

Gemini 2.5对开发者的影响

Gemini 2.5的发布对开发者来说是一个重要的机遇。首先,Gemini 2.5 Pro的全面开放使得开发者可以基于这一强大的模型构建各种应用,从而加速人工智能技术在各个领域的应用。其次,Gemini 2.5 Flash-Lite的推出为开发者提供了一种经济高效的解决方案,使得他们可以在资源受限的设备上运行复杂的AI模型。

此外,Gemini 2.5还提供了丰富的API和工具,使得开发者可以轻松地集成和使用这些模型。例如,Google AI Studio和Vertex AI为开发者提供了云端开发环境,使得他们可以在云端训练和部署模型。同时,Gemini 2.5还支持多种编程语言和框架,使得开发者可以使用自己熟悉的工具进行开发。

未来展望

随着人工智能技术的不断发展,Gemini模型系列也将不断进化。未来,我们可以期待Gemini模型在性能、效率和功能上取得更大的突破。例如,我们可以期待Gemini模型能够处理更复杂的任务、支持更多的模态输入、提供更个性化的服务。

此外,随着计算成本的不断降低,Gemini模型也将更加普及。未来,我们可以期待Gemini模型在更多的设备上运行,为更多的人提供服务。例如,我们可以期待Gemini模型在智能手机、智能家居设备、智能汽车等设备上运行,为用户提供更智能、更便捷的体验。

谷歌Gemini 2.5系列模型的发布,无疑为人工智能领域注入了新的活力。其在架构设计、优化策略以及应用案例上的创新,都预示着AI技术在未来的发展潜力。对于开发者而言,这是一个不容错过的机遇,他们可以借助Gemini 2.5的力量,开创出更多令人惊叹的应用。