在人工智能领域,音频处理技术正迎来一场革命。StepFun 团队推出的 Step-Audio-AQAA 模型,代表了这一变革的前沿。它不仅简化了传统的音频处理流程,更在语音交互的自然性和准确性上实现了质的飞跃。本文将深入探讨 Step-Audio-AQAA 的技术原理、功能特性及其潜在的应用场景,带您领略端到端音频语言模型的强大魅力。

Step-Audio-AQAA:端到端音频语言模型的新星

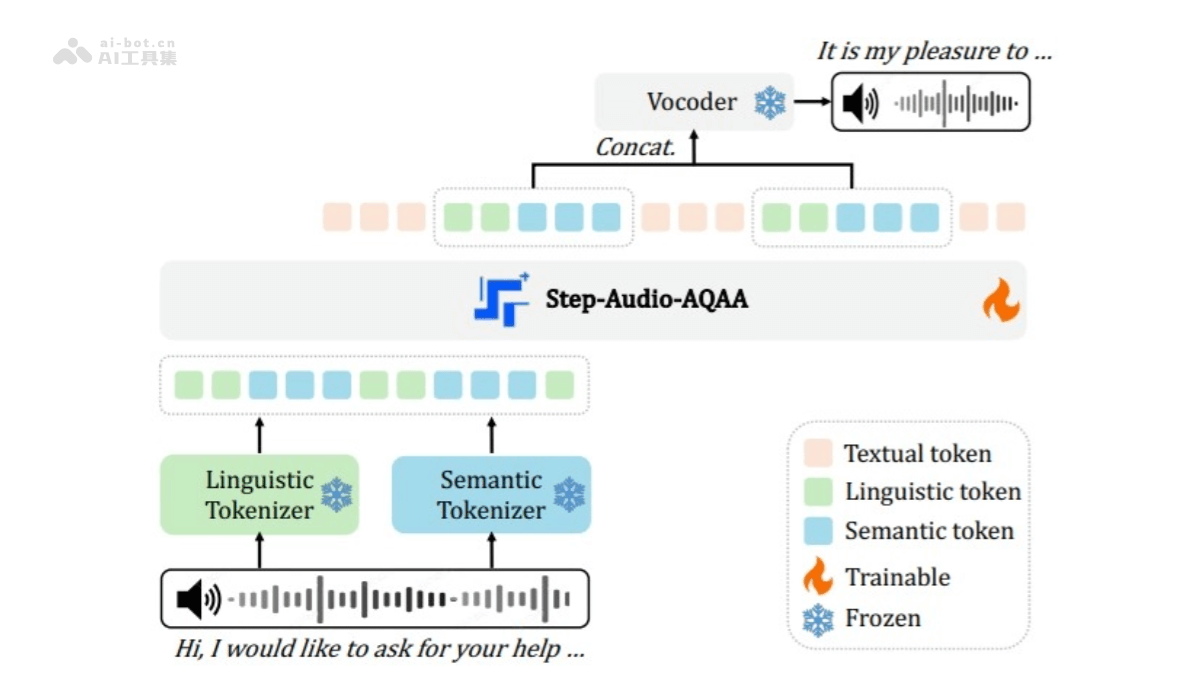

传统的音频处理系统通常依赖于自动语音识别(ASR)和文本到语音(TTS)等模块,这些模块的级联使用容易引入误差,影响最终的语音交互效果。Step-Audio-AQAA 则另辟蹊径,它采用端到端的设计理念,直接处理音频输入,并生成自然、准确的语音回答,无需依赖 ASR 和 TTS 模块,从根本上解决了级联误差的问题。这一创新性的设计,使得 Step-Audio-AQAA 在语音情感控制、角色扮演和逻辑推理等复杂任务中表现出色,为用户带来更加流畅、自然的语音交互体验。

Step-Audio-AQAA 的训练过程是一个精细而复杂的过程,它主要包括以下几个关键步骤:

- 多模态预训练:利用大量的文本、语音和图像数据对模型进行预训练,使其具备初步的语言理解和表达能力。

- 监督微调(SFT):使用标注好的音频-回答数据对模型进行微调,使其能够生成准确的语音回答。

- 直接偏好优化(DPO):通过优化模型的偏好,使其生成的语音回答更加符合人类的偏好,例如更加自然、流畅、情感丰富等。

- 模型合并:将多个训练好的模型进行合并,以提高模型的泛化能力和鲁棒性。

通过这些步骤,Step-Audio-AQAA 能够胜任各种复杂的语音交互任务,并在 StepEval-Audio-360 基准测试中取得了优异的成绩,超越了现有的 LALM 模型。

Step-Audio-AQAA 的核心功能

Step-Audio-AQAA 的强大功能是其在音频语言模型领域脱颖而出的关键。它不仅能够直接处理音频输入,还能实现无缝的语音交互,为用户带来前所未有的便捷和高效。以下是 Step-Audio-AQAA 的一些主要功能:

- 直接处理音频输入:Step-Audio-AQAA 能够直接从原始音频输入生成语音回答,无需依赖传统的自动语音识别(ASR)和文本到语音(TTS)模块。这意味着系统架构的简化和潜在错误的减少。

- 无缝语音交互:用户可以通过语音提问,模型直接以语音回答,实现真正的语音到语音交互。这种交互方式更加自然和流畅,提升了用户体验。

- 情感语调调整:Step-Audio-AQAA 可以在句子级别调整语音的情感语调,例如表达高兴、悲伤或严肃等情绪。这使得语音回答更加生动和富有感染力。

- 语速控制:用户可以根据需要调整语音回答的速度,使其更符合特定场景的需求。例如,在快节奏的游戏场景中,可以使用较快的语速;而在需要仔细聆听的教育场景中,可以使用较慢的语速。

- 音色和音调控制:Step-Audio-AQAA 能够根据用户指令调整语音的音色和音调,以适应不同的角色或场景。例如,在角色扮演游戏中,可以使用不同的音色来扮演不同的角色;在语音助手应用中,可以使用不同的音调来区分不同的功能。

- 多语言交互:Step-Audio-AQAA 支持中文、英语、日语等多种语言,满足不同用户的语言需求。这意味着它可以为全球用户提供服务,打破了语言障碍。

- 方言支持:Step-Audio-AQAA 涵盖中文的四川话、粤语等方言,提升了模型在特定地区的适用性。这使得它可以更好地服务于中国各地的用户,提供更贴近本地化的语音交互体验。

- 语音情感控制:Step-Audio-AQAA 能够根据上下文和用户指令,生成带有特定情感的语音回答。例如,在用户表达悲伤情绪时,模型可以生成带有安慰语气的语音回答;在用户表达高兴情绪时,模型可以生成带有庆祝语气的语音回答。

- 角色扮演:Step-Audio-AQAA 支持在对话中扮演特定角色,例如客服、教师、朋友等,并生成符合角色特征的语音回答。这使得它可以应用于各种角色扮演场景,例如游戏、教育、娱乐等。

- 逻辑推理和知识问答:Step-Audio-AQAA 能够处理复杂的逻辑推理任务和知识问答,并生成准确的语音回答。这意味着它可以应用于智能客服、智能助手等领域,为用户提供更加智能化的服务。

- 高质量语音输出:Step-Audio-AQAA 通过神经声码器生成高保真、自然流畅的语音波形,提升用户体验。这意味着用户可以听到清晰、自然的语音回答,而不会感到任何不适。

- 语音连贯性:Step-Audio-AQAA 在长句或段落生成中保持语音的连贯性和一致性,避免语音断续或突变。这使得语音回答更加流畅和自然,提升了用户体验。

- 文本与语音交错输出:Step-Audio-AQAA 支持文本和语音的交错输出,用户可以根据需要选择语音或文本回答。这为用户提供了更加灵活的交互方式,满足了不同用户的需求。

- 多模态输入理解:Step-Audio-AQAA 能够理解包含语音和文本的混合输入,并生成相应的语音回答。这意味着用户可以使用语音和文本的组合来与模型进行交互,更加方便和高效。

Step-Audio-AQAA 的技术原理探秘

Step-Audio-AQAA 的卓越性能得益于其独特的技术架构和精巧的设计。它主要由以下几个核心模块组成:

- 双码本音频分词器:该模块负责将输入的音频信号转换为结构化的标记序列。它包含两个分词器:语言分词器和语义分词器。语言分词器提取语音的音素和语言属性,以 16.7 Hz 的频率采样,码本大小为 1024。语义分词器捕捉语音的声学特征,如情感和语调,以 25 Hz 的频率采样,码本大小为 4096。通过这种方式,Step-Audio-AQAA 能够更好地捕捉语音中的复杂信息。

这种双码本的设计是 Step-Audio-AQAA 的一大亮点。传统的音频分词器通常只关注语音的音素和语言属性,而忽略了语音中的情感和语调等信息。Step-Audio-AQAA 通过引入语义分词器,能够同时捕捉语音的语言信息和情感信息,从而更好地理解语音的含义。

- 骨干 LLM:该模块是 Step-Audio-AQAA 的核心,它使用预训练的 1300 亿参数多模态 LLM(Step-Omni)。该 LLM 经过大规模的文本、语音和图像数据预训练,具备强大的语言理解和生成能力。Step-Audio-AQAA 将双码本音频标记嵌入到统一的向量空间中,并通过多个 Transformer 块进行深度语义理解和特征提取。

Transformer 块是近年来在自然语言处理领域取得巨大成功的神经网络架构。它通过自注意力机制,能够捕捉输入序列中不同位置之间的依赖关系,从而更好地理解语言的含义。Step-Audio-AQAA 使用多个 Transformer 块,能够对音频标记进行深度语义理解和特征提取,从而生成更加准确和自然的语音回答。

- 神经声码器:该模块负责将生成的音频标记合成为自然、高质量的语音波形。Step-Audio-AQAA 采用 U-Net 架构,结合 ResNet-1D 层和 Transformer 块,能够高效地将离散的音频标记转换为连续的语音波形。

神经声码器是近年来在语音合成领域取得重要进展的技术。传统的语音合成方法通常依赖于人工设计的声学特征,而神经声码器则能够直接从数据中学习声学特征,从而生成更加自然和高质量的语音波形。Step-Audio-AQAA 使用 U-Net 架构的神经声码器,能够高效地将音频标记转换为语音波形,并保证语音的自然度和质量。

Step-Audio-AQAA 的应用前景

Step-Audio-AQAA 的强大功能和灵活的可定制性使其在众多领域具有广阔的应用前景。以下是一些典型的应用场景:

- 情感陪伴机器人:Step-Audio-AQAA 可以根据用户的情绪自动调节回应语气,提供情感支持和陪伴。例如,当用户感到孤独或失落时,机器人可以生成带有安慰语气的语音回答,并提供一些建议或鼓励。

- 多语言智能客服:Step-Audio-AQAA 可以直接处理方言语音查询,并支持多种语言(如中文、英语、日语等)。这意味着它可以为全球用户提供智能客服服务,解决用户的各种问题。

- 游戏 NPC 交互:Step-Audio-AQAA 可以实时生成带情绪变化的语音反馈,在单轮对话中实现情感、语速的动态切换,从而增强游戏的沉浸感和趣味性。

- 智能语音助手:Step-Audio-AQAA 支持语音查询和语音回答,可以提供实时信息查询、日程提醒等服务。这意味着用户可以通过语音与智能设备进行交互,更加方便和高效。

- 教育与娱乐:Step-Audio-AQAA 可以用于教育场景中的语音教学、故事创作、诗歌朗诵等。它还可以根据用户需求灵活切换语音或文本回答,提供更加个性化的学习体验。

总而言之,Step-Audio-AQAA 作为一款端到端的大型音频语言模型,以其独特的技术优势和强大的功能,为音频处理领域带来了新的可能性。随着人工智能技术的不断发展,我们有理由相信,Step-Audio-AQAA 将在未来的语音交互领域发挥更加重要的作用。