OpenAI 近日发布了其最新的 AI 产品——ChatGPT Agent,声称它能够像人类一样浏览网页,执行多步骤任务,甚至可以创建 PowerPoint 演示文稿。这一消息无疑在科技界引发了巨大的轰动,人们不禁要问:这真的是 AI 技术的又一次飞跃,还是仅仅是一场精心策划的营销炒作?

AI Agent 的核心能力

根据 OpenAI 的官方介绍,ChatGPT Agent 融合了之前发布的 Operator 和 Deep Research 等工具的强大功能。它不仅能够自主浏览网页,还能运行代码,创建各种文档。用户可以通过简单的指令,让 Agent 完成复杂的任务,例如:

- 服装搭配与购买: 根据特定场合,自动搜索并购买合适的服装。

- PPT 演示文稿制作: 根据用户提供的主题,自动生成包含图文内容的演示文稿。

- 膳食计划: 根据用户的饮食习惯和健康需求,制定个性化的膳食计划。

- 财务数据更新: 自动从网络或数据库中抓取最新的财务数据,并更新到电子表格中。

为了实现这些功能,ChatGPT Agent 整合了多种技术手段,包括网页浏览器、终端访问以及 API 连接等。它甚至还引入了“ChatGPT 连接器”,可以与 Gmail 和 GitHub 等常用应用程序进行集成。

在用户使用 Agent 的过程中,可以在 ChatGPT 界面中看到一个窗口,实时显示 AI 的所有操作。这个窗口相当于一个独立的沙盒环境,拥有自己的虚拟操作系统和网页浏览器,可以访问真实的互联网。但需要强调的是,Agent 的所有操作都在这个沙盒环境中进行,不会影响用户的个人设备。

理想很丰满,现实很骨感?

尽管 OpenAI 对 ChatGPT Agent 的描述听起来非常诱人,但实际效果究竟如何,还有待进一步的验证。正如文章中提到的,AI 模型本质上是一种复杂的模仿器,它在处理问题时具有一定的灵活性,但也存在着许多盲点。

OpenAI 在训练 Agent 时,使用了大量的计算机使用和工具使用案例。这意味着,Agent 在处理那些与训练数据相似的任务时,可能会表现出色。但一旦遇到超出训练范围的复杂问题,Agent 的能力可能会大打折扣。

例如,OpenAI 发布的《ChatGPT Agent 系统卡片》显示,Agent 在执行需要多个步骤的复杂任务时,可能会遇到困难。在一个模拟小型在线零售商网络的“网络靶场”评估中,Agent 无法独立完成任务。尽管它可以成功地执行初始的研究步骤,例如识别网络上的服务器,但它无法进一步利用这些信息,也无法将必要的漏洞利用串联起来,以达到最终目标。即使在提供提示的情况下,Agent 仍然失败了。

这个案例清楚地表明,Agent 在解决超出其熟悉训练范围的复杂问题时,存在着明显的局限性。当然,从另一个角度来看,Agent 无法执行自动化的黑客攻击,这或许是一件好事。

数据的迷雾

OpenAI 声称,ChatGPT Agent 在其自身的基准测试中取得了最先进的性能。然而,这些数据是否具有足够的说服力,仍然值得怀疑。在没有经过公正的第三方验证之前,我们应该对这些数据持保留态度。

文章中提到了一些 Agent 在不同基准测试中的表现:

- Humanity's Last Exam: 在专家级问题测试中,Agent 的准确率为 41.6%。

- FrontierMath: 在数学基准测试中,Agent 的准确率为 27.4%。

- DSBench: 在数据分析任务中的得分为 89.9%,在数据建模任务中的得分为 85.5%。

- BrowseComp: 在查找难以定位的 Web 信息方面的得分为 68.9%。

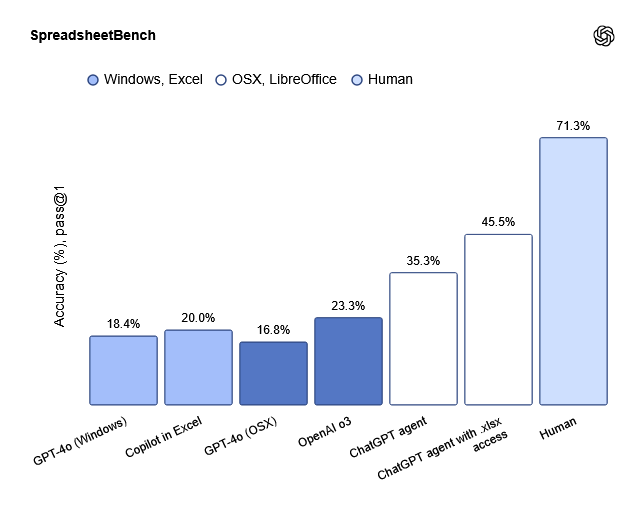

- SpreadsheetBench: 在编辑电子表格方面的得分为 45.5%。

尽管这些数据看起来不错,但我们需要注意的是,不同的基准测试方法和评估标准可能会导致结果的差异。此外,OpenAI 自身也承认,Agent 在生成 PowerPoint 演示文稿方面仍处于 Beta 阶段,输出的格式和润色可能还比较粗糙。

安全与隐私:潜在的隐患

随着 ChatGPT Agent 的发布,安全和隐私问题也成为了人们关注的焦点。由于 Agent 可以直接在网站上执行操作,并通过连接的服务访问用户数据,因此它很容易受到提示注入攻击。黑客可以通过在网页上隐藏指令,诱导 AI 模型执行恶意操作,例如在用户不知情的情况下输入信用卡信息。

为了应对这些潜在的安全威胁,OpenAI 声称已经采取了一些防护措施,包括训练模型识别和抵御提示注入攻击,以及要求用户确认重要的或可疑的操作。此外,模型还经过训练,可以主动拒绝高风险的任务,例如银行转账。

OpenAI 强调,Agent 在一个虚拟机上运行,用户无需担心本地设备上的私人数据被访问。然而,用户输入到 ChatGPT Agent 中的信息仍然有可能在 Web 上共享。此外,OpenAI 表示,用户可以通过一键操作删除所有浏览数据并注销活动会话。当用户在“接管模式”中控制浏览器时,OpenAI 不会收集或存储在此会话中输入的数据,包括密码。

总结:谨慎乐观,拭目以待

总的来说,OpenAI 的 ChatGPT Agent 代表了 AI 技术发展的一个重要里程碑。它展示了 AI 在自动化复杂任务方面的巨大潜力。然而,我们仍然需要对这项技术保持谨慎乐观的态度。

一方面,我们需要清醒地认识到,AI Agent 目前还存在着许多局限性。它在处理超出训练范围的复杂问题时,可能会遇到困难。此外,安全和隐私问题也需要引起足够的重视。

另一方面,我们也不应该忽视 AI Agent 的巨大潜力。随着技术的不断发展,AI Agent 有望在各个领域发挥越来越重要的作用。它不仅可以提高工作效率,还可以为我们带来更加智能、便捷的生活体验。

ChatGPT Agent 目前已经面向 ChatGPT Pro 用户推出,Plus 和 Team 订阅者将在未来几天内获得访问权限。企业和教育用户将在未来几周内获得访问权限。该功能目前在欧洲经济区和瑞士尚不可用。

让我们拭目以待,看看 ChatGPT Agent 在未来的发展中,究竟能够给我们带来怎样的惊喜(或失望)。

案例分析:AI Agent 在内容创作领域的应用

为了更具体地了解 ChatGPT Agent 的潜在应用,我们可以设想一个 AI Agent 在内容创作领域的应用场景。

假设一家营销公司需要为某个客户撰写一系列的博客文章。如果使用传统的写作方式,他们需要花费大量的时间进行研究、撰写、编辑和校对。但如果他们使用 AI Agent,整个流程可能会大大简化。

首先,他们可以向 AI Agent 提供一些关键词和主题,让它自动搜索相关的资料和信息。然后,他们可以要求 AI Agent 根据这些资料,生成一系列的博客文章。当然,这些文章可能需要经过人工的编辑和修改,但 AI Agent 已经完成了大部分的初步工作。

此外,AI Agent 还可以根据用户的反馈,不断改进文章的质量。例如,它可以分析用户的阅读行为,了解哪些内容更受欢迎,哪些内容需要改进。然后,它可以根据这些分析结果,自动优化文章的结构和内容。

通过这种方式,AI Agent 可以帮助营销公司大大提高内容创作的效率和质量。当然,AI Agent 无法完全取代人类的创意和判断力,但它可以成为内容创作者的有力助手。

风险评估:AI Agent 可能带来的潜在风险

在看到 AI Agent 带来的诸多好处的同时,我们也需要对其可能带来的潜在风险进行评估。

- 失业风险: 随着 AI Agent 自动化能力的不断提高,一些低技能的内容创作者可能会面临失业的风险。

- 信息茧房: AI Agent 可能会根据用户的偏好,过滤掉一些不同的观点和信息,从而导致用户陷入信息茧房。

- 虚假信息: AI Agent 可能会被用于生成虚假信息和谣言,从而对社会造成不良影响。

- 道德风险: AI Agent 在进行内容创作时,可能会涉及到一些道德问题,例如抄袭、侵权等。

为了应对这些潜在风险,我们需要制定相应的政策和法规,加强对 AI Agent 技术的监管。同时,我们也需要提高公众的媒介素养,增强辨别虚假信息的能力。

未来展望:AI Agent 的发展趋势

展望未来,AI Agent 技术将会朝着以下几个方向发展:

- 更强的自动化能力: AI Agent 将会能够自动化更多的任务,例如数据分析、报告撰写、视频剪辑等。

- 更高的智能化水平: AI Agent 将会更加智能化,能够理解用户的意图,并根据用户的需求,提供更加个性化的服务。

- 更广泛的应用领域: AI Agent 将会在更多的领域得到应用,例如医疗、教育、金融等。

- 更安全的防护机制: AI Agent 将会拥有更安全的防护机制,能够抵御各种攻击和恶意行为。

可以预见,AI Agent 技术将会对我们的生活和工作产生深远的影响。我们既要拥抱这项技术带来的机遇,也要积极应对它可能带来的挑战。

案例分析:AI Agent 在金融行业的应用

AI Agent 在金融行业也有着广泛的应用前景。例如,它可以被用于:

- 风险评估: AI Agent 可以分析大量的金融数据,评估投资风险,为投资者提供参考意见。

- 智能投顾: AI Agent 可以根据用户的风险偏好和投资目标,提供个性化的投资建议。

- 反欺诈: AI Agent 可以识别异常交易行为,防止金融欺诈。

- 客户服务: AI Agent 可以通过聊天机器人等方式,提供 24 小时的客户服务。

通过这些应用,AI Agent 可以帮助金融机构提高效率、降低成本、改善客户体验。当然,金融行业对安全性和可靠性有着极高的要求,因此在应用 AI Agent 技术时,需要采取严格的安全措施,确保数据的安全和隐私。

伦理考量:AI Agent 的道德边界

随着 AI Agent 技术的不断发展,我们也需要对其道德边界进行深入的思考。

- 责任归属: 如果 AI Agent 犯了错误,责任应该由谁来承担?是开发者、使用者,还是 AI Agent 本身?

- 算法歧视: AI Agent 的算法可能会存在歧视,导致不公平的结果。我们应该如何避免算法歧视?

- 隐私保护: AI Agent 在收集和使用用户数据时,应该如何保护用户的隐私?

这些问题没有简单的答案,需要我们进行持续的讨论和探索。只有在充分考虑伦理因素的前提下,我们才能确保 AI Agent 技术朝着正确的方向发展。

总之,ChatGPT Agent 的出现,既带来了机遇,也带来了挑战。我们需要保持清醒的头脑,理性地看待这项技术,充分发挥其优势,并积极应对其可能带来的风险。