在人工智能领域,智谱推出的GLM-4.5模型无疑是一款备受瞩目的新秀。它不仅集成了推理、代码和智能体等多项能力,还在开源领域达到了领先水平。本文将深入探讨GLM-4.5的技术特点、性能指标以及应用前景,希望能为读者提供一个全面而深入的了解。

GLM-4.5:新一代旗舰模型的崛起

GLM-4.5是智谱AI打造的一款新一代旗舰模型,它最大的亮点在于原生融合了推理、代码和智能体能力。这种融合使得GLM-4.5在处理复杂任务时能够更加高效和灵活。该模型采用了混合专家(MoE)架构,拥有两个版本:GLM-4.5(3550亿参数,320亿激活)和GLM-4.5-Air(1060亿参数,120亿激活)。

在性能方面,GLM-4.5在多个评测基准中表现卓越,综合性能达到了开源模型的顶尖水平。尤其值得一提的是,它在代码智能体场景中表现优异,能够支持混合推理模式,兼顾复杂任务和即时响应需求。这意味着GLM-4.5既可以用于需要深入思考的复杂任务,也可以用于对响应速度有较高要求的场景。

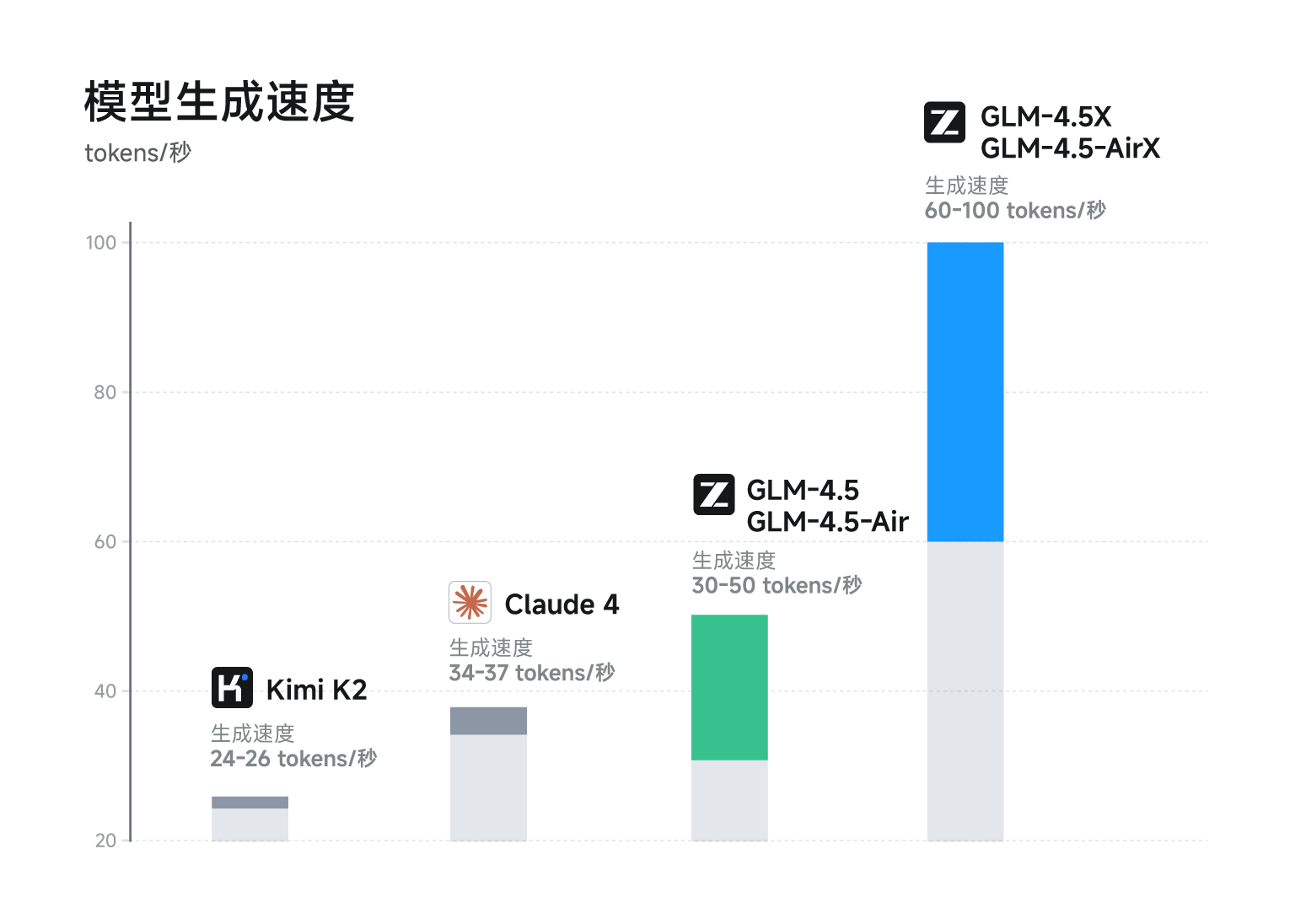

此外,GLM-4.5在参数效率方面也实现了翻倍,API价格仅为Claude的1/10,速度最快可达100tokens/秒。目前,GLM-4.5已上线智谱清言和Z.ai,供用户免费体验。

GLM-4.5的主要特点

GLM-4.5之所以能够在众多模型中脱颖而出,得益于其独特的技术特点:

多能力融合:GLM-4.5首次在单个模型中实现了推理、代码生成和智能体能力的原生融合。这种融合使得模型能够更好地理解和处理复杂任务,从而满足复杂智能体应用的需求。

强大的推理能力:在多个推理评测基准中,GLM-4.5表现优异,能够支持复杂推理任务。其推理性能达到了开源模型的顶尖水平,这意味着GLM-4.5在处理需要逻辑推理的问题时具有很强的优势。

出色的代码生成能力:GLM-4.5在代码生成和编程任务中表现出色,支持多种编程语言,能够生成高质量的代码片段,胜任全栈开发任务。这对于开发者来说无疑是一个福音,可以大大提高开发效率。

智能体应用:GLM-4.5支持工具调用、网页浏览等功能,能够接入代码智能体框架,如 Claude Code 和 Roo Code,适用于智能体任务。这意味着GLM-4.5可以应用于各种智能体场景,例如智能客服、智能助手等。

灵活的混合推理模式:GLM-4.5提供“思考模式”和“非思考模式”两种推理模式。思考模式适用于复杂推理和工具使用,模型会进行更深入的思考和推理,以生成更准确的结果;非思考模式适用于即时响应场景,模型会快速生成结果,满足低延迟的需求。这种混合推理模式兼顾了效率和性能,使得GLM-4.5能够适应不同的应用场景。

GLM-4.5的技术亮点

GLM-4.5的技术亮点主要体现在以下几个方面:

- 混合专家(MoE)架构:GLM-4.5采用了混合专家(Mixture of Experts, MoE)架构,这是一种高效的模型扩展方法。MoE架构通过将模型参数划分为多个专家模块(Experts),在每个前向传播过程中动态选择部分专家进行激活,实现参数的稀疏激活。这种架构在保持模型强大表达能力的同时,显著降低了计算成本和内存占用。

- GLM-4.5:总参数量为 3550 亿,激活参数为 320 亿。

- GLM-4.5-Air:总参数量为 1060 亿,激活参数为 120 亿。

多模态能力:GLM-4.5支持多模态输入和输出,能够处理文本、图像等多种数据类型。这种多模态能力使得模型能够更好地理解和生成复杂的智能体应用内容,例如在智能体任务中处理网页浏览、工具调用等多模态交互场景。这意味着GLM-4.5可以应用于更广泛的领域,例如图像识别、语音识别等。

混合推理模式:GLM-4.5提供两种推理模式:

- 思考模式(Thinking Mode):适用于复杂推理和工具使用场景,模型会进行更深入的思考和推理,以生成更准确的结果。

- 非思考模式(Non-Thinking Mode):适用于即时响应场景,模型会快速生成结果,满足低延迟的需求。

- 高效的训练流程:GLM-4.5的训练流程包括三个阶段:

- 通用数据预训练:在 15 万亿 token 的通用数据上进行预训练,以学习语言和知识的基础表示。

- 针对性训练:在代码、推理、智能体等领域的 8 万亿 token 数据上进行针对性训练,以增强模型在特定任务上的表现。

- 强化学习优化:通过强化学习进一步优化模型的推理、代码生成和智能体能力,以提升模型在实际应用中的表现。

- 参数效率优化:GLM-4.5在参数效率上实现了显著提升。尽管参数量仅为DeepSeek-R1的1/2和Kimi-K2的1/3,但在多项标准基准测试中表现更为出色。例如,在100B总参数 – 10B激活参数规模的模型系列中,GLM-4.5在Artificial Analysis基准测试中的推理性能媲美甚至超越了其他国际顶级模型。这意味着GLM-4.5在相同资源条件下能够实现更好的性能。

GLM-4.5的技术指标

GLM-4.5在多个技术指标上都表现出色:

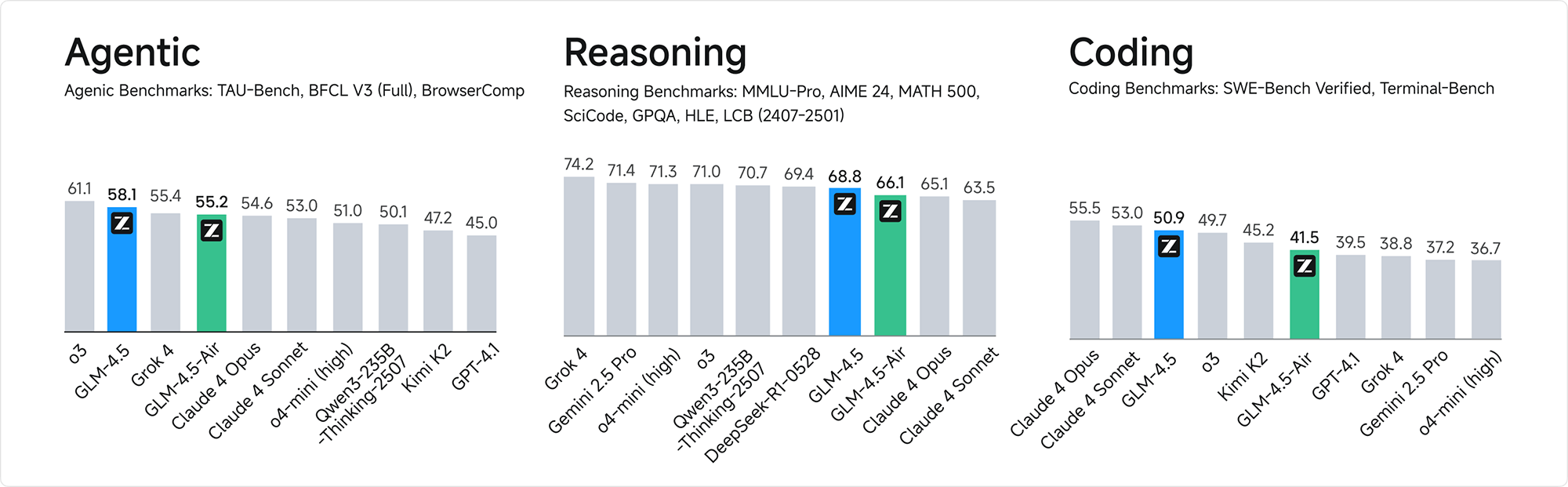

- 综合性能SOTA:在最具代表性的12个评测基准中,包括MMLU Pro、AIME 24、MATH 500、SciCode、GPQA 、HLE、LiveCodeBench、SWE-Bench Verified、Terminal-Bench、TAU-Bench、BFCL v3 和BrowseComp。综合平均分,GLM-4.5取得了全球模型第三、国产模型第一、开源模型第一的成绩。这充分证明了GLM-4.5在综合性能方面的领先地位。

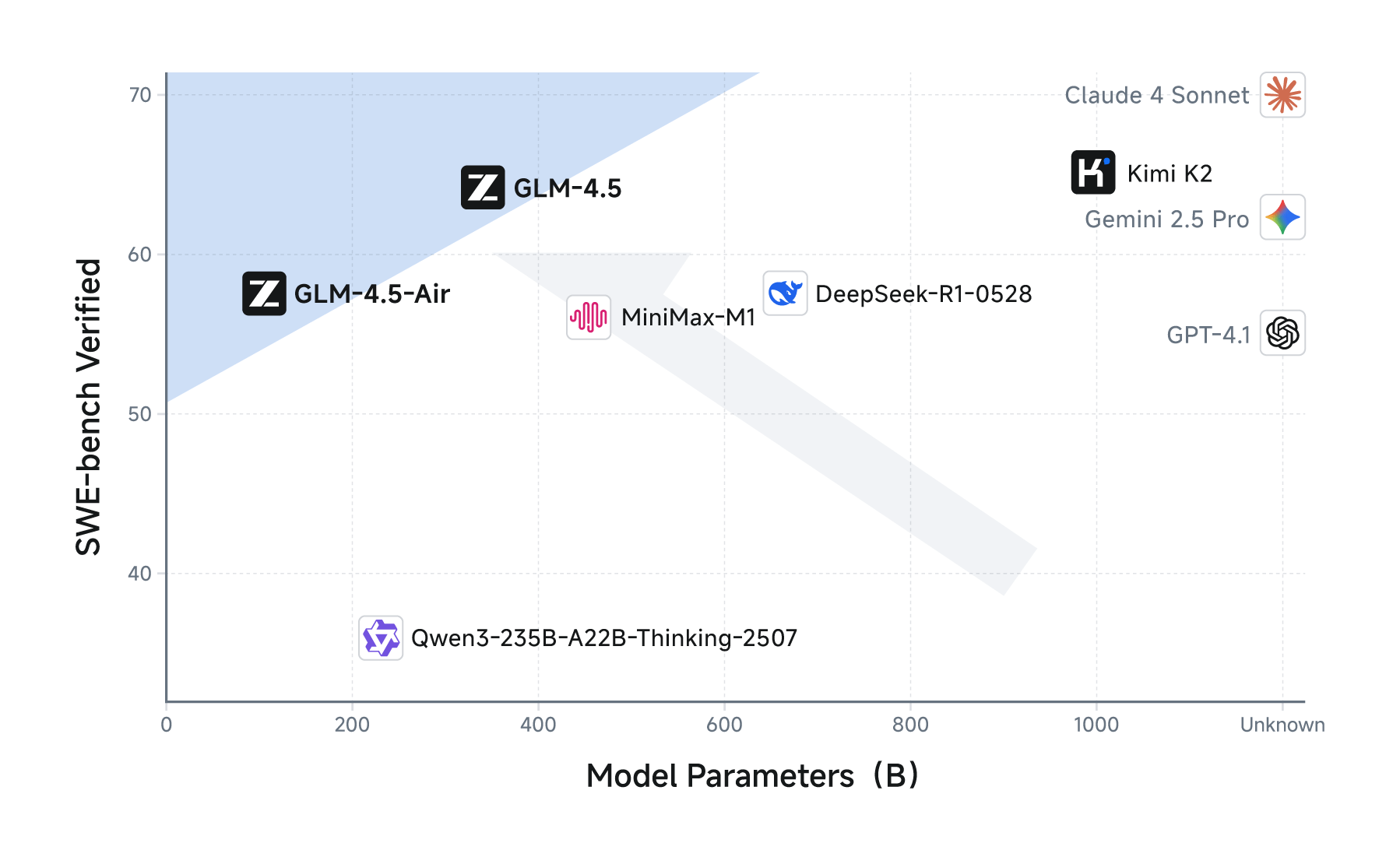

- 更高的参数效率:GLM-4.5的参数量仅为DeepSeek-R1的1/2、Kimi-K2的1/3,但在多项标准基准测试中表现得更为出色,这得益于GLM模型的更高参数效率。在衡量模型代码能力的SWE-bench Verified榜单上,GLM-4.5系列位于性能/参数比帕累托前沿,这表明在相同规模下,GLM-4.5系列实现了最佳性能。

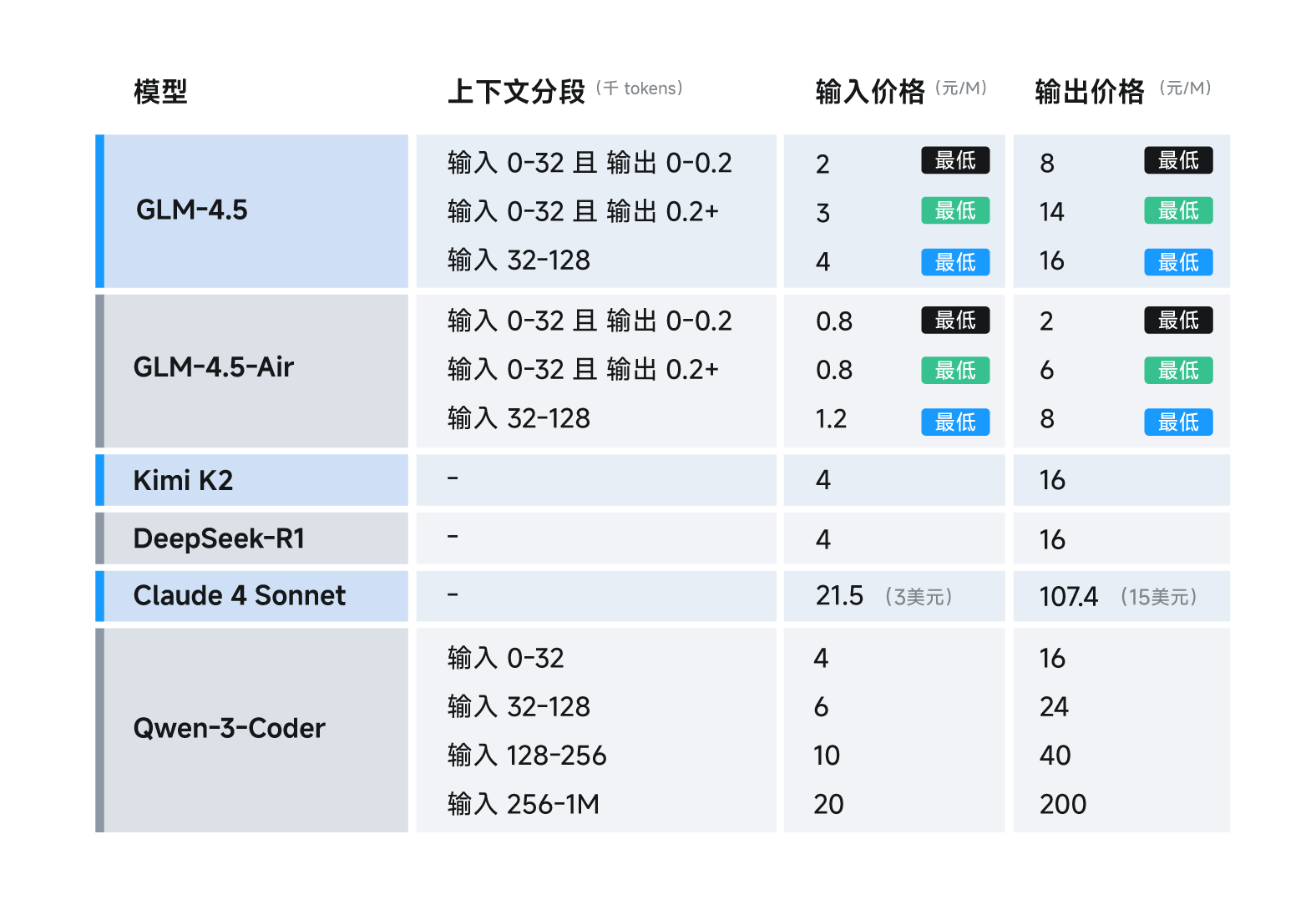

- 低成本、高速度:在性能优化之外,GLM-4.5系列也在成本和效率上实现突破,由此带来远低于主流模型定价:API调用价格低至输入0.8元/百万tokens,输出2元/百万tokens。同时,高速版本实测生成速度最高可至100tokens/秒,支持低延迟、高并发的实际部署需求,兼顾成本效益与交互体验。这使得GLM-4.5在实际应用中具有很强的竞争力。

如何使用GLM-4.5

用户可以通过以下方式使用GLM-4.5:

- 体验平台

- 智谱清言 (chatglm.cn):可以直接访问智谱清言平台,免费体验GLM-4.5的满血版功能。用户可以进行对话生成、代码生成、推理任务等多种操作,感受模型的强大能力。

- Z.ai:用户也可以通过 Z.ai 平台体验 GLM-4.5 的功能。

- API 调用

- BigModel.cn:智谱 AI 提供了 API 接口,用户可以通过 BigModel平台进行 API 调用。API 接口支持多种功能,包括文本生成、代码生成、推理任务等。

GLM-4.5的模型定价

GLM-4.5的API调用价格非常具有竞争力:输入0.8元/百万tokens、输出2元/百万tokens,生成速度最高可达100tokens/秒,支持低延迟和高并发部署。这种定价策略使得GLM-4.5在成本效益方面具有明显优势。

GLM-4.5的应用场景

GLM-4.5的应用场景非常广泛:

全栈开发任务:GLM-4.5能胜任复杂的全栈开发任务,支持编写较为复杂的应用、游戏、交互网页等。这对于开发者来说是一个强大的助手,可以大大提高开发效率。

代码生成:GLM-4.5在代码生成方面表现出色,能生成高质量的代码片段,支持多种编程语言。可以帮助开发者快速生成代码框架、修复代码错误、优化代码结构等。

编程辅助:模型可以作为编程辅助工具,提供代码补全、代码生成建议、代码注释等功能,提高开发效率。这对于初学者来说尤其有用,可以帮助他们更快地掌握编程技能。

内容生成:模型可以生成各种类型的内容,如文章、新闻报道、创意文案等,适用于内容创作、文案撰写等场景。这对于内容创作者来说是一个强大的工具,可以帮助他们更快地生成高质量的内容。

学术研究:GLM-4.5可以用于学术研究,帮助研究人员探索自然语言处理、人工智能等领域的前沿问题。这对于推动人工智能领域的发展具有重要意义。

总结与展望

GLM-4.5作为智谱AI推出的新一代旗舰模型,凭借其多能力融合、强大的推理能力、出色的代码生成能力以及灵活的混合推理模式,在人工智能领域取得了显著的成绩。它不仅在多个评测基准中表现卓越,还在参数效率、成本效益和应用场景方面具有明显优势。随着人工智能技术的不断发展,相信GLM-4.5将在更多领域发挥重要作用,为人类带来更多便利和价值。