近年来,人工智能领域,特别是大语言模型(LLMs)的发展令人瞩目。随着“链式思考”(Chain-of-Thought, CoT)等新范式的出现,LLMs在处理复杂问题时展现出通过多步骤逻辑推导获得答案的潜力,这曾被视为其迈向真正“推理”能力的关键一步。然而,一系列前沿研究正逐渐揭示,这种看似强大的推理能力可能只是一种精心构建的“模拟”,其核心是对训练数据中既有模式的复现,而非深层次的抽象逻辑理解。这不仅引发了对LLMs实际智能水平的深刻反思,也对其在关键应用领域中的可靠性提出了严峻挑战。

链式思考的兴起与内在局限

“链式思考”是一种让LLMs在生成最终答案之前,先输出一系列中间推理步骤的技术。这种方法旨在模仿人类解决问题的过程,将复杂任务分解为更小、更易管理的子问题,从而提高模型在数学、常识推理等任务上的表现。最初,CoT的出现让研究者和业界对LLMs的通用人工智能潜力抱有极高期望,认为它预示着模型能进行更深层次的逻辑推断和问题解决。然而,随后的研究,如苹果公司和其它团队的工作,开始质疑这些模型是否真正理解其推理过程,或者仅仅是在模拟一种“看起来像推理”的行为模式。

这些质疑并非空穴来风。当问题中包含不相关的冗余信息,或者与训练数据中的常见模板存在细微偏差时,CoT模型往往会产生不连贯或逻辑不健全的答案。这表明,其“推理”路径的稳健性远低于预期,一旦脱离熟悉的数据分布,其性能便会急剧下降。这种现象强调了一个核心问题:LLMs的强大表现,是否建立在对训练数据表层模式的过度依赖之上?

亚利桑那州立大学的实证揭示:脆弱的幻象

为了系统性地探究LLMs的泛化推理能力,亚利桑那州立大学的研究团队近期发表了一篇预印本论文,对现有研究进行了总结,并进一步设计了受控实验。他们指出,LLMs并非“有原则的推理者”,而更像是“推理式文本的复杂模拟器”。为了在客观、可量化的环境中测试模型的泛化能力,研究者们开发了一个名为DataAlchemy的LLM训练环境。

DataAlchemy允许研究者训练小型模型,使其学习两种极其简单的文本转换规则:ROT加密(一种替换密码)和循环移位。随后,模型会接收额外的训练,以了解这些函数如何以不同顺序和组合进行操作。通过这种精细控制的训练,研究者能够精确衡量CoT推理在面对“域外”(out of domain)逻辑问题时的表现,即那些不完全匹配训练数据中特定逻辑模式的问题。

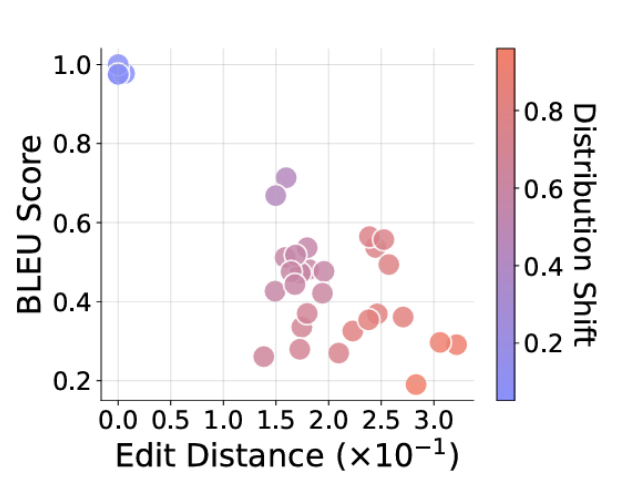

实验结果令人警醒。研究显示,CoT模型所带来的看似巨大的性能飞跃,“在很大程度上是一种脆弱的幻象”,即使在“中等程度的分布偏移”下,其性能也会“变得脆弱并容易失败”。这有力地支持了“CoT推理在任务转换下反映的是训练中学到的模式的复制,而非对文本的真正理解”这一论断。换言之,模型更擅长记忆和重现训练数据中已有的逻辑序列,而非灵活地构建新的、适应未知情境的推理路径。

泛化能力的灾难性衰退与“流畅废话”的风险

研究团队进一步发现,当这些基础模型被要求泛化执行训练数据中未直接演示的新转换组合时,它们会“灾难性地失败”。例如,一个在两次循环移位数据上训练的模型,可能被要求执行两次ROT移位的转换。在许多情况下,模型会尝试根据训练数据中的相似模式来泛化新的逻辑规则,但这种尝试常常导致“推理路径正确,但答案错误”的尴尬局面。更令人担忧的是,有时LLMs会“偶然”得出正确答案,但其背后却是“不忠实的推理路径”,即其推导过程在逻辑上是错误的。

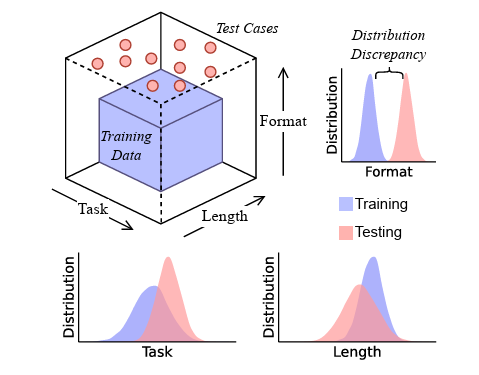

除了逻辑组合的泛化失败,研究还探讨了输入长度和格式变化对模型表现的影响。当输入文本字符串的长度略短或略长于训练数据中的示例时,或者当函数链的长度与训练数据不一致时,结果的准确性会“随着差异的增加而恶化”,这“预示着模型泛化的失败”。同样,测试任务格式上微小但模型不熟悉的差异(例如引入训练数据中不存在的字母或符号)也会导致性能“急剧下降”,并“影响模型响应的正确性”。

这些发现共同指向一个严峻的事实:LLMs的“推理”能力与其说是一种通用智能,不如说是一种高度专业化的模式匹配。它能够高效地在已知模式中运作,但在面对需要真正抽象、归纳和演绎的未知情境时,其局限性便暴露无遗。

避免“虚假可靠性”:高风险领域的警示

研究者们强调,尽管通过监督微调(SFT)引入少量相关数据可以在一定程度上改善“域外”性能,但这只是一种“修补”策略,不应被误认为是实现了真正的泛化。“依赖SFT来修复每一个域外故障是一种不可持续的、被动的策略,它未能解决核心问题:模型缺乏抽象推理能力。” 这种观点深刻指出,对LLMs的过度依赖,尤其是在其泛化能力尚未得到充分验证的领域,可能带来严重的后果。

由于CoT模型能够生成“流畅的废话”,即那些听起来合理但实际上逻辑有误的文本,这便营造出了一种“虚假的可靠性光环”。这种光环在日常交流中或许无伤大雅,但在医疗诊断、金融决策、法律分析等“高风险领域”则具有灾难性的潜在影响。一个逻辑错误的医疗建议可能危及生命,一个基于虚假推断的金融分析可能导致巨大损失,一份误导性的法律意见可能造成严重的法律后果。因此,研究者们强烈警告“不要将链式思考式的输出等同于人类思维”。

展望未来:超越表层模式识别

面对LLMs“模拟推理”的局限性,人工智能的未来发展路径必须重新审视。当前的测试和基准评估应优先考虑那些“域外”任务,以更有效地探查模型的真实泛化能力,而非仅仅衡量其在已知模式上的熟练度。此外,未来的模型开发需要超越“表层模式识别”,致力于构建能够展现“更深层次推断能力”的智能系统。

这意味着需要更基础性的研究,探索如何让AI不仅能识别模式,更能理解模式背后的抽象原理;不仅能模仿逻辑步骤,更能建立起真正的因果关系和概念理解。这可能涉及到对新的模型架构、训练方法,甚至对AI认知理论的深入探索。只有当LLMs能够真正地“理解”和“泛化”,而不仅仅是“模拟”和“复制”时,它们才能在复杂多变的世界中发挥其真正的潜力,成为人类可靠的智能伙伴。