人工智能浪潮下的能源挑战

近年来,人工智能(AI)技术的飞速发展深刻改变了多个行业,但其背后的能源消耗也日益成为关注焦点。随着大规模数据中心在全球范围内的快速扩张,美国等国家的电力消耗出现了数十年来的首次显著增长,其中相当一部分需求被归因于AI应用负载。这种增长,尤其是在部分地区仍依赖燃煤发电的情况下,使得AI的环境足迹面临严峻质疑。然而,由于缺乏透明和统一的测量标准,评估AI的真实环境影响始终是一项复杂任务。

大多数关于AI能耗的研究往往局限于实验室环境或特定模型测试,难以准确反映真实世界中大规模部署的AI服务所产生的实际能耗。这主要是因为缺乏对数据中心运营细节的深入了解,例如硬件的利用率、AI查询服务的频率以及支持基础设施的能耗等关键数据。正是基于对这种数据鸿沟的认识,谷歌——作为全球领先的AI技术提供商和数据中心运营商——发布了一份里程碑式的分析报告,为我们提供了窥探AI能耗奥秘的独特视角。这份报告不仅展示了其AI能耗的惊人优化成果,更揭示了实现这些突破背后的技术策略。

谷歌AI能耗测量的独特视角与全面框架

谷歌拥有得天独厚的数据优势,能够从真实世界的AI使用场景中收集详尽的能耗数据。这使得其分析报告远超传统学术研究,提供了更具参考价值的行业洞察。在新的分析中,谷歌采用了极其全面的测量框架,力求捕捉AI查询服务过程中涉及的各项能耗要素。其考虑范围不仅包括直接的计算能耗,更延伸至间接的环境影响。

考量范围与核心指标

谷歌的能耗测量体系涵盖了以下关键组成部分:

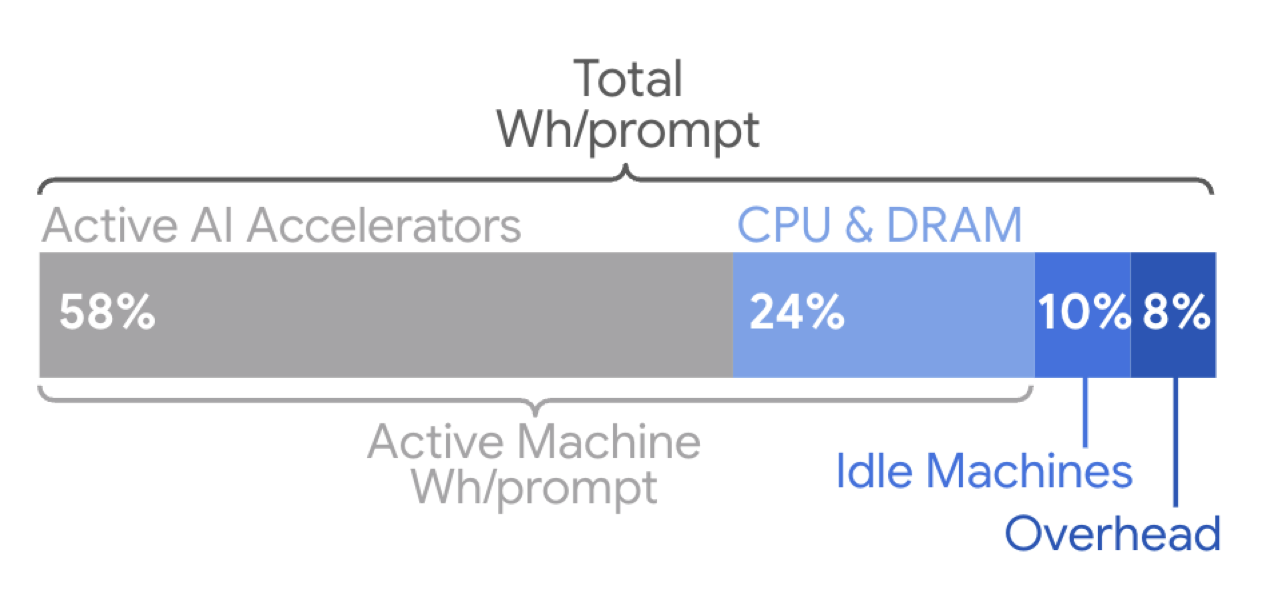

- 核心计算组件能耗:精确追踪中央处理器(CPUs)、专用AI加速器(如TPUs)以及内存(RAM)在处理查询时的活动能耗,以及在空闲状态下的待机能耗。这种精细化测量确保了对不同硬件负载下能耗的准确评估。

- 数据中心整体能耗:将AI查询所占用的数据中心份额考虑在内,包括冷却系统、电源转换以及其他支持性基础设施的能源和水资源消耗。通过整体评估,避免了只关注计算单元而忽略辅助系统能耗的偏差。

- 供应链碳排放:依据国际上日益推崇的“范围2”(Scope 2)和“范围3”(Scope 3)排放标准,谷歌将电力供应相关的碳排放以及硬件设备(如芯片、服务器等)生产过程中产生的碳排放也纳入考量。这使得其能耗评估更接近AI服务生命周期的全貌,体现了企业在环境责任方面的深度承诺。

通过对上述指标的综合分析,谷歌能够估算出每次AI查询(以中位数提示词为基准)所消耗的能源、产生的碳排放以及耗水量,从而量化其AI服务的具体环境足迹。这种详尽的测量方法为理解和管理AI能耗提供了坚实的数据基础。

测量体系中的策略性取舍

尽管谷歌的测量框架已相当全面,但为了聚焦于数据中心内部的AI服务核心影响,它也策略性地排除了一些因素。这些排除项包括:

- 网络传输能耗:接收请求和交付结果所需的网络传输能耗并未纳入考量。其原因是,这部分能耗受请求类型和地理位置影响极大,难以标准化计算。

- 终端用户硬件能耗:用户侧设备的计算负载和能耗差异巨大,从高性能游戏台式机到智能手机,能耗表现迥异。因此,谷歌没有将这部分能耗计入AI服务的环境成本。

- 模型训练能耗:一个值得注意的排除项是AI模型的训练能耗。尽管模型训练是AI生命周期中能源消耗巨大的环节,且谷歌无疑拥有这方面的精确数据,但在此次报告中并未将其分摊到每次查询的能耗中。报告主要关注已部署模型的推理阶段能耗。虽然这有助于简化对“每次查询”的即时影响评估,但也意味着报告并未呈现AI技术从研发到部署的完整能源开销。

为了得出具有代表性的数据,谷歌团队在24小时内追踪了AI请求及其所服务的硬件,并记录了硬件的空闲时间。这使得他们能够基于实际模型的使用情况,计算出每次请求的能耗估值,并以每日中位提示词作为计算环境影响的基准。

效率奇迹:AI查询能耗一年骤降33倍

谷歌的分析结果令人振奋:一次AI文本请求的个体环境影响非常小。他们估计,中位数的Gemini Apps文本提示词仅消耗0.24瓦时(Wh)的能量,产生0.03克二氧化碳当量(gCO2e),并消耗0.26毫升(约五滴)的水。为了更直观地理解,这相当于观看大约9秒电视的能耗。

然而,尽管单次请求的能耗很低,考虑到谷歌在每次搜索请求中都集成了AI操作,AI查询的总量无疑是极其庞大的。这种在几年前尚不存在的巨大计算需求,意味着累积的环境成本依然不容忽视。但令人欣慰的是,报告指出,仅仅在一年前,这种累积成本将会糟糕得多——其AI查询的能耗在一年内下降了33倍。

实现高效的核心策略与技术解析

谷歌实现这一惊人能效飞跃,并非偶然,而是多方面策略协同作用的结果:

可再生能源的整合与碳排放优化: 过去一年中,美国及全球太阳能发电的蓬勃发展,使得谷歌更容易获取可再生能源。这直接促使其每单位能源消耗的碳排放量减少了1.4倍。通过积极采购和部署清洁能源,谷歌有效降低了其数据中心的碳足迹。

软件优化:智能化与轻量化: 软件层面的创新是实现33倍能效提升的关键驱动力。谷歌采用了多项尖端技术:

- Mixture-of-Experts (MoE) 模型架构:这种方法允许AI模型在处理特定请求时,只激活模型中与该任务最相关的部分。这能够将计算需求降低10到100倍,显著提高了推理效率。

- 紧凑型模型版本:谷歌开发了其主模型(如Gemini)的多个紧凑版本,这些模型在保持高性能的同时,大幅减少了计算负载和内存占用。

- 数据中心管理优化:通过智能调度和资源管理,谷歌确保任何活跃的硬件都能得到充分利用,而在没有请求时,硬件能够进入低功耗状态,避免不必要的能源浪费。

定制硬件设计与软硬协同优化: 谷歌在AI效率方面的核心优势之一,在于其自主设计并制造定制的AI加速器(如TPU)。更重要的是,谷歌还为这些定制硬件架构其运行软件。这种从底层硬件到上层软件的深度垂直整合,使得公司能够对软硬件进行极致优化,确保两者之间高效协同。鉴于AI加速器在每次查询的能源使用中占据了超过一半的份额,这种定制化设计和优化显得尤为关键。

数据中心运营的长期经验: 谷歌在运营高效数据中心方面拥有数十年的经验,这些宝贵的知识和技术同样被应用到AI基础设施的管理中,进一步提升了整体的能源效率。

这些优化措施的综合效果是显著的。它们不仅直接减少了单次AI查询的能耗,还带来了连锁效应:例如,由于硬件在其使用寿命内能够处理更多的查询,与硬件制造相关的碳排放也被更有效地“摊薄”了。

行业倡议与未来展望

谷歌的这份报告,以其严谨的方法论和深入的考量,展现了其作为行业领导者的责任感,并超越了单纯的公关宣传。它以学术出版物的形式详细阐述了其方法和考量因素,旨在鼓励其他行业参与者采纳类似全面且透明的能耗测量框架。谷歌明确表示,他们倡导广泛采纳这种或类似全面的测量框架,以确保随着AI能力的不断提升,其环境效率也能同步提高。

展望未来,AI的可持续发展将成为该技术普及和应用的关键考量。谷歌的实践证明,通过技术创新和精细化管理,AI的能耗并非不可控。持续的研发投入、软硬件的深度协同优化、以及对可再生能源的积极整合,将是构建绿色AI生态系统的核心支柱。行业内若能普遍采纳统一的能耗测量标准,将有助于推动良性竞争,促使各方共同探索更高效、更环保的AI解决方案,最终实现AI技术与地球环境的和谐共生。这将不仅仅是技术上的胜利,更是可持续发展理念在数字时代的生动实践。