苹果SlowFast-LLaVA模型:长视频理解的新范式

在数字时代,长视频内容日益成为信息传递的主流载体,涵盖了从教育课程、娱乐节目到专业监控和医疗影像的广泛应用。这些视频蕴含着海量且复杂的动态信息,然而,如何让人工智能系统高效、准确地理解这些冗长且不断变化的视频内容,长期以来一直是人工智能领域,特别是计算机视觉和自然语言处理交叉学科中的一项重大挑战。传统的视频理解模型往往受制于计算资源的巨大消耗、内存开销以及对长时间序列上下文建模能力的不足。

近期,苹果研究团队发布了适配版的SlowFast-LLaVA模型,为解决这一难题提供了突破性的解决方案。该模型在长视频分析理解上的卓越表现,不仅展现了创新的技术路径,甚至在多项基准测试中超越了参数规模更为庞大的模型,为长视频内容分析开启了高效、精准的新篇章。

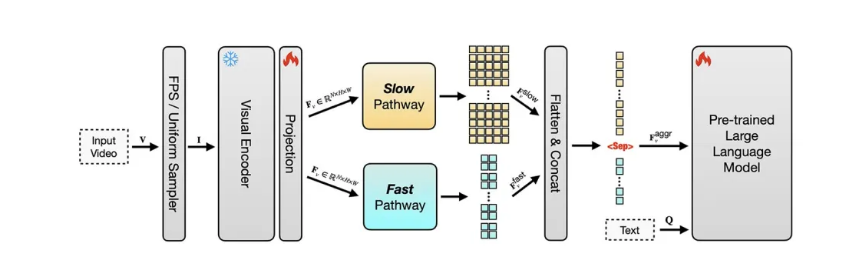

核心创新:双流架构深度解析

SlowFast-LLaVA模型的核心竞争力在于其独特设计的双流架构。这一创新机制巧妙地解决了传统逐帧处理模式下普遍存在的信息冗余问题以及上下文窗口溢出的挑战。通过将视频处理分解为两个协同工作的流,模型能够以更高的效率和更深的理解力处理长视频数据。

慢流:捕捉持久性语义与背景

模型的“慢流”分支以较低的帧率对视频进行稀疏采样和处理。其主要职责是捕捉场景中相对静态的细节、稳定的背景信息以及长期存在的语义上下文。例如,在一部叙事性视频中,慢流会持续关注场景的整体布局、人物的长时间出现以及环境氛围的演变。通过这种高效的采样方式,慢流能够有效地编码视频的全局结构和核心主题,为整体理解提供一个稳定的、低频率变化的语义基础。这种设计避免了对重复或缓慢变化的帧进行不必要的密集计算,从而显著提升了处理效率。

快流:追踪瞬时动作与动态变化

与慢流形成鲜明对比,“快流”分支则以高帧率运行,专注于捕捉视频中快速发生的动作、瞬时事件和精细的运动轨迹。例如,在体育赛事录像中,快流能够精准地捕捉运动员的每一个细微动作、球的快速移动路径等关键动态信息。通过对瞬时变化的敏感捕捉,快流弥补了慢流在时间分辨率上的不足,确保模型能够完整理解视频中所有重要的动态细节和瞬间发生的事件。

信息融合:协同与互补

双流架构并非简单地独立运行,而是在模型内部实现了精密的协同与信息融合。慢流提供的全局、长期上下文信息能够有效地指导快流更好地理解局部动态事件的意义,例如,知道当前场景在“办公室”中,快流捕捉到的“敲击键盘”动作就更容易被理解为“工作”。反之,快流捕捉到的精确动作细节又能丰富慢流对整体场景的描述,使其对事件的理解更为具体和深入。这种互补机制使得SlowFast-LLaVA能够同时兼顾视频的时间广度与深度,既能宏观把握视频主题,又能微观洞察细节变化,极大地优化了视频处理的效率和理解的准确性。相较于单一流模型或更为复杂的时空图卷积网络,这种架构在计算成本和模型效果之间取得了更为理想的平衡,展现了卓越的架构设计智慧。

卓越性能:挑战大规模模型的传统优势

在多个长视频基准测试中,SlowFast-LLaVA展现了令人瞩目的性能,其表现甚至超越了参数规模更大的竞争模型。这不仅是技术上的胜利,更标志着在AI效率和效果之间取得了一项重要的突破,预示着未来AI模型发展的新趋势。

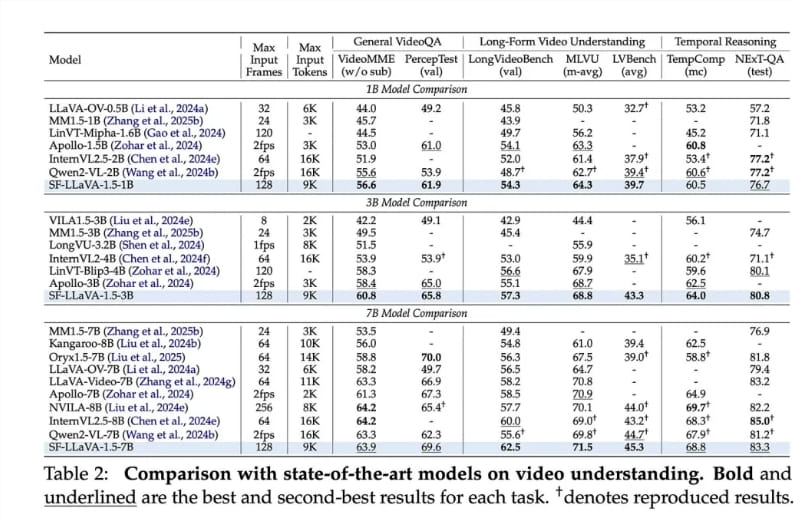

基准测试成果

SlowFast-LLaVA模型在LongVideoBench等多个长视频理解基准测试中取得了优异成绩。以其不同参数规模的版本为例:

- 10亿参数模型:在LongVideoBench的General VideoQA(通用视频问答)任务中获得了56.6分的优异成绩。这充分表明,即使是相对轻量级的SlowFast-LLaVA版本,也能在回答关于视频内容的通用、开放性问题上表现出强大的语义理解能力和推理能力。

- 70亿参数模型:在更具挑战性的Long-Form Video Understanding(长篇视频理解)任务中更是达到了71.5分的高分。此任务通常涉及更复杂的长时依赖关系建模、多事件推理以及跨场景的上下文理解。SlowFast-LLaVA在此任务中的突出表现,有力地证明了其在深度语义理解和长时间序列建模上的卓越实力。

性能超越的深层含义

这种“以小博大”的性能优势具有深远的意义。它意味着在不牺牲核心性能的前提下,可以部署更小、更高效的模型。这对于资源受限的边缘设备(如智能手机、物联网设备)、需要实时响应的视频分析场景(如自动驾驶、智能安防),以及需要快速迭代和部署的研发环境而言,都具有巨大的实际应用价值和成本效益。传统观点通常认为,更大的模型参数通常意味着更强的学习能力和更高的准确性,但SlowFast-LLaVA的成功有力地证明了,通过精巧且优化的架构设计,同样可以实现甚至超越传统“暴力堆叠参数”所能达到的效果。这为未来AI模型的轻量化、高效化和可持续发展指明了新的方向。

多模态能力的拓展

SlowFast-LLaVA不仅在纯粹的视频理解方面表现出色,其多模态能力也得到了充分体现。除了视频理解任务,该模型在知识推理和OCR(光学字符识别)等图像理解任务上同样取得了卓越成绩。这意味着该模型并非仅仅是一个视频分析工具,而是一个能够有效处理和整合不同形式信息的通用多模态智能体,例如视觉内容(图像、视频)与文本信息。在实际应用中,这种强大的多模态能力可以被广泛应用于各种场景,例如自动生成视频摘要、智能标注视频内容中出现的文字信息、对视频内容进行复杂的视觉问答、甚至在内容创作中提供智能辅助。例如,在教育领域,它可以辅助学习者理解教学视频中的复杂概念和图表;在媒体行业,它可以大大加速视频内容的生产、分类和管理流程,提升工作效率和内容价值。

当前局限与未来展望

尽管SlowFast-LLaVA模型在长视频理解领域取得了显著进展,为行业带来了新的突破,但如同任何前沿技术,它当前仍存在一定的局限性。目前,模型的输入帧长限制在128帧。这意味着对于极度冗长、信息密度极高或需要捕捉跨度极长的逻辑关联的视频(例如数小时的会议记录、复杂的纪录片),模型可能会存在关键信息遗漏或长程依赖建模不足的风险。这种限制使得模型在处理超长时间的视频内容时,可能无法完全捕捉到所有的长程依赖和细微变化,从而影响对整体叙事或复杂事件链的完整理解。

针对这些挑战,苹果研究团队已经明确表示,未来将持续投入精力,探索内存优化技术和更高效的时间建模策略,以期突破当前的帧长限制。潜在的优化方向可能包括:

- 分层时间建模(Hierarchical Temporal Modeling):引入多层次的时间聚合机制,允许模型在不同的时间尺度上处理信息。例如,先宏观理解视频段落,再微观分析具体帧,从而有效扩展其时间感受野,处理更长的视频序列。

- 稀疏注意力机制(Sparse Attention Mechanisms):采用更智能的注意力机制,使其不必关注所有帧,而是能够动态聚焦于视频中信息量最大的关键帧、关键时刻或语义区域,从而在不增加计算负担的情况下处理更长的序列。

- 外部记忆网络(External Memory Networks):集成外部记忆模块,用于存储和检索长程上下文信息,从而克服传统Transformer架构中固定上下文窗口的固有局限性,实现对无限长序列的理论理解。

- 计算资源与算法优化:进一步优化模型推理和训练的计算效率和显存占用,使其能够在更长的视频序列上进行训练和部署,而无需过高的硬件要求。

通过这些持续的技术迭代和方法创新,SlowFast-LLaVA有望在未来实现对任意长度视频的无缝理解,从而在更广泛的实际应用场景中发挥其潜力,例如在智能监控、自动驾驶、远程医疗诊断以及科学研究等对视频分析深度和广度都有极高要求的领域。

开源生态的贡献与行业影响

SlowFast-LLaVA模型是基于公开数据集训练并已全面开源的。这一举措对于整个AI社区而言,无疑是一项重大的贡献,具有深远的积极影响。开源不仅能够加速全球研究人员在该领域的进一步探索和创新,还能极大地促进相关技术的普及和实际应用。

推动研究与开发

通过提供高质量的开源模型和代码,SlowFast-LLaVA为全球的研究人员提供了一个强大的基石。他们可以在此基础上进行二次开发、性能测试、算法改进以及新的实验探索。这有助于避免“重复造轮子”,使得研究力量能够更集中于更有创新性的研究方向,例如探索更复杂的视频-语言交互模式、提升跨模态推理能力,或者将其应用于新的垂直行业场景,从而加速整个多模态AI领域的技术进步。

赋能产业应用

开源模型的出现,也极大地降低了企业和开发者采纳先进AI技术的门槛。无论是初创公司还是大型企业,都可以利用SlowFast-LLaVA的核心技术来开发创新的视频理解产品和解决方案,例如智能视频内容管理系统、个性化视频推荐引擎、智能视频内容审核工具、教育视频智能辅助系统等。这不仅有助于推动人工智能技术在更多垂直行业的落地和商业化,也加速了整个AI生态系统的成熟与发展,为社会创造更多价值。

塑造未来AI视频理解格局

SlowFast-LLaVA的发布,无疑为AI在长视频理解领域设定了一个新的性能标杆。它不仅通过精巧的架构设计展示了超越模型规模限制的可能性,也为多模态AI的未来发展提供了新的思路和方向。随着模型性能的不断提升和应用场景的持续拓展,我们可以预见,长视频的智能分析和理解能力将迎来一个高速发展的时期,这将深刻影响我们获取、处理和利用视频信息的方式,从而驱动数字内容产业和相关科技领域向更智能、更高效的方向迈进。