人工智能技术正以前所未有的速度渗透到各行各业,推动着数字经济的深刻变革。然而,随着模型规模的持续膨胀,尤其是万亿级参数大模型的涌现,传统的AI计算基础设施在效率、成本和可扩展性方面面临着巨大挑战。如何高效地训练、部署和运行这些超大规模模型,成为了当前AI发展亟待解决的核心问题。

2025年8月28日,在备受瞩目的百度云智大会上,百度智能云针对这一痛点给出了其最新的解决方案——百舸AI计算平台5.0的全面升级。这一新版本在网络通信、核心算力、推理系统及训推一体化四大维度进行了深度优化和能力提升,旨在为全球AI开发者和企业用户提供更强大、更高效、更易用的AI计算基础设施,彻底打破现有的AI计算效率瓶颈。

网络通信:实现毫秒级延迟与极速吞吐

AI模型训练,尤其是分布式训练,对网络通信有着极其严苛的要求。数据在计算节点间的传输速度和延迟,直接决定了模型收敛的速度和整体训练效率。百舸AI计算平台5.0在网络层面上进行了革命性创新,实现了通信速度的显著提升和延迟的极致降低。

平台引入了新一代高速互联技术和优化协议,确保大规模数据传输能够以更低的开销和更高的带宽进行。例如,在大型模型参数同步或梯度聚合时,传统网络可能成为瓶颈,导致部分计算资源空闲等待。而百舸5.0通过优化网络拓扑结构、采用RDMA(远程直接数据存取)等技术,有效减少了CPU参与数据传输的开销,从而大幅提升了网络吞吐量,使得数据传输不再是制约AI训练和推理效率的短板。这意味着,无论是百亿级还是万亿级参数模型,其在分布式训练过程中的节点间通信效率都得到了质的飞跃,显著缩短了模型的训练周期。

算力革命:昆仑芯超节点正式上线,赋能万亿级模型部署

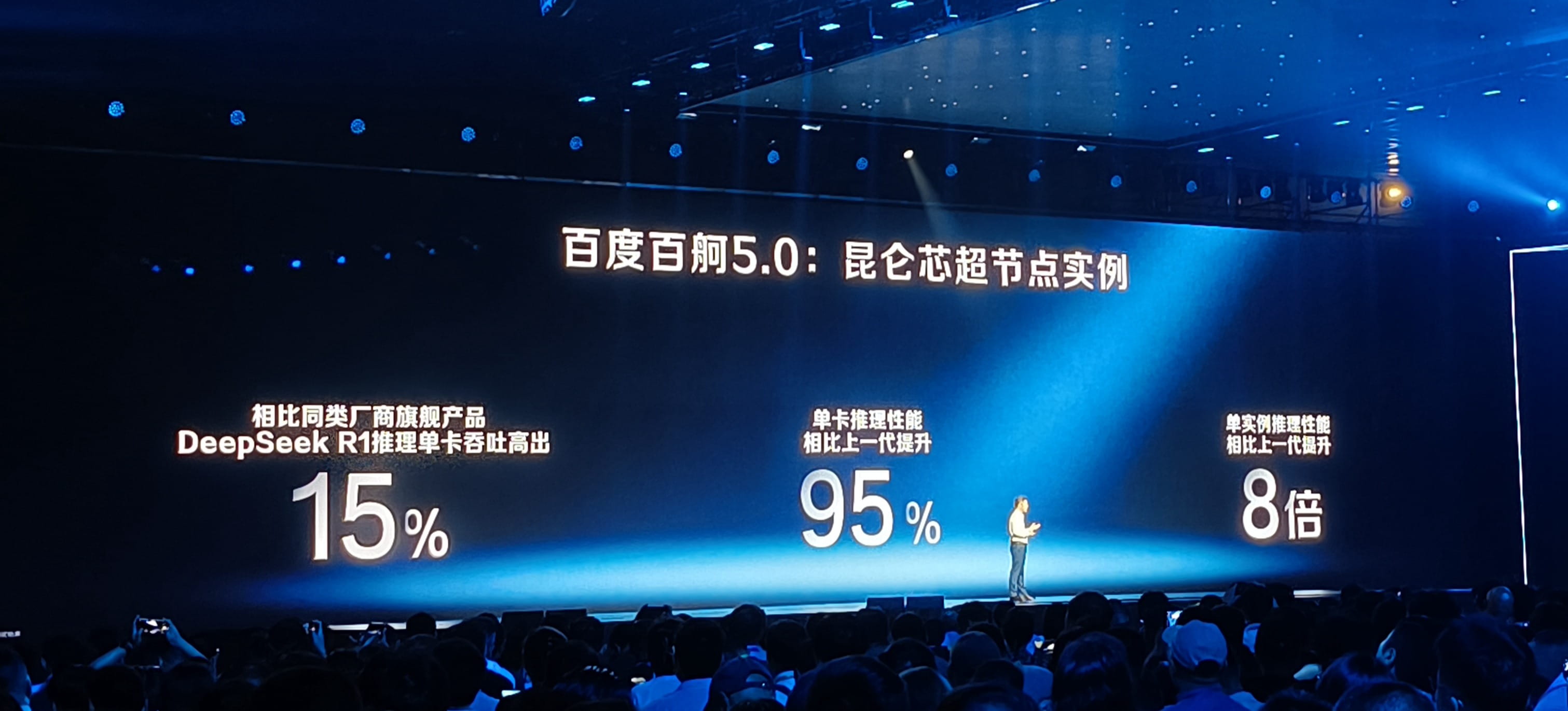

算力是AI发展的基石,而百度智能云在此次升级中最大的亮点之一,无疑是昆仑芯超节点在百舸AI计算平台5.0上的正式上线公有云服务。

昆仑芯是百度自主研发的AI芯片,其强大的计算能力和针对AI负载的优化设计,使其在处理复杂的深度学习任务时表现卓越。超节点概念的引入,意味着将大量昆仑芯芯片通过高速网络和先进的集群管理技术进行紧密集成,形成一个具备超大规模并行计算能力的统一体。这不仅仅是简单的硬件堆叠,更是一种系统级的协同优化,确保每个芯片的算力都能被高效利用,实现接近线性的扩展性。

昆仑芯超节点的具体优势体现在:

- 超大规模模型支撑能力: 业界最大的开源模型参数已达到1万亿,运行此类模型曾是少数顶级研究机构和企业专属的能力,需要耗费巨大的资源和时间。而借助昆仑芯超节点,用户现在仅需数分钟,通过一个云实例,就能够轻松启动并运行这些万亿级参数的巨型模型。这极大地降低了超大规模模型研究和应用的门槛,使得更多开发者能够接触和利用这些前沿技术。

- 极致的算力密度与能效比: 昆仑芯芯片在设计之初就充分考虑了AI计算的特点,提供了高密度的矩阵乘法单元和高效的内存访问机制。通过超节点的设计,这些芯片的协同工作进一步提升了整体算力密度,同时优化了能源效率,降低了运行大型AI任务的TCO(总拥有成本)。

- 高可用与弹性伸缩: 作为公有云服务的一部分,昆仑芯超节点不仅提供强大的固定算力,还具备云服务固有的高可用性和弹性伸缩能力。用户可以根据实际需求动态调整算力资源,无需担心硬件采购、部署和维护的复杂性,将更多精力投入到AI创新本身。

推理系统:解耦、自适应与智能调度,全面提升吞吐与降低延迟

除了训练,AI模型的推理也是其落地应用的关键环节。百舸AI计算平台5.0的推理系统通过“解耦”、“自适应”和“智能调度”三大核心策略,实现了质的飞跃,旨在提升吞吐量并大幅降低推理延迟,这对于实时性要求高的AI应用至关重要。

- “解耦”策略: 传统推理系统往往将不同任务紧密耦合,导致资源利用不均衡和瓶颈效应。百舸5.0通过将推理任务的不同阶段(如数据预处理、模型执行、后处理)进行解耦,允许这些阶段独立并行执行。这种模块化设计不仅提升了灵活性,也使得各阶段的资源可以独立优化和扩展,从而避免了单一环节的性能瓶颈。

- “自适应”策略: 针对不同模型、不同请求负载和不同硬件配置,推理系统能够自适应地调整资源分配和执行策略。例如,对于计算密集型模型,系统会分配更多计算资源;对于内存密集型模型,则优化内存访问。同时,它还能根据实时流量变化,动态调整并发批处理大小和并行度,确保在各种场景下都能达到最佳性能表现,避免资源浪费或性能不足。

- “智能调度”策略: 智能调度器是推理系统的“大脑”,它利用先进的算法来预测负载、优化任务排队,并将推理请求智能地分发到最合适的计算资源上。这包括根据设备利用率、模型大小、请求优先级等多种因素进行综合决策,旨在最大限度地提升系统吞吐量,同时确保关键请求能够以最低延迟得到响应。通过智能调度,即便是面对突发高峰流量,系统也能保持稳定高效的运行。

这些策略的综合应用,使得百舸AI计算平台5.0能够为自动驾驶、智能客服、实时推荐等对延迟和吞吐有严格要求的AI应用提供坚实的支撑。

训推一体:发布百舸强化学习框架,极致压榨算力资源

在AI开发的生命周期中,训练和推理往往被视为两个相对独立的阶段,但两者之间存在着紧密的内在联系。百舸AI计算平台5.0通过构建训推一体化的系统,旨在打通训练与推理的壁垒,实现更高效的资源利用和更快的迭代速度。其中,百舸强化学习框架的发布是这一方向上的重要里程碑。

强化学习(RL)是当前AI领域一个活跃的研究方向,尤其在机器人、自动驾驶、游戏AI等领域展现出巨大潜力。然而,强化学习的训练过程通常极其耗费算力,且对训练与环境交互的效率要求很高。百舸强化学习框架正是为解决这些挑战而生。

该框架深度优化了强化学习的训练算法和系统架构,通过并行化处理、内存优化和高效通信机制,能够极致地压榨底层的昆仑芯等算力资源。它支持大规模并发的环境交互与策略更新,显著缩短了强化学习模型的训练时间。更重要的是,这一框架是训推一体理念的体现,从训练阶段到模型部署推理,整个流程在同一个平台内无缝衔接,大大减少了开发者的工作量和潜在的兼容性问题。

训推一体化系统不仅提升了强化学习模型的开发效率,对于其他类型的深度学习模型同样具有深远意义。它使得模型从训练完成到实际部署应用的周期大大缩短,加速了AI创新成果的落地速度,使得企业能够更快地将AI能力转化为实际价值。

展望:赋能未来AI应用的基石

百舸AI计算平台5.0的发布,标志着百度智能云在AI基础设施建设上迈出了坚实的一步。它不仅仅是一系列技术升级的叠加,更体现了百度对AI发展趋势的深刻洞察和前瞻性布局。通过在网络、算力、推理和训推一体化四大核心领域的全面突破,百舸5.0平台为应对未来超大规模AI模型的挑战提供了强有力的武器。

这一平台将有力支持自动驾驶、生物医药、金融科技、智能制造等众多领域的AI应用创新。它使得原本需要顶级专家团队和海量资金才能进行的AI研究和开发,变得更加普惠和高效。未来,我们有理由相信,在百舸AI计算平台5.0这样先进基础设施的赋能下,更多的AI创新将加速涌现,共同推动人工智能技术迈向更广阔的应用场景,开启一个效率更高、创新更快的智能时代。