人工智能浪潮下的能源挑战与谷歌的绿色实践

近年来,全球对人工智能(AI)技术的投资与应用呈爆炸式增长,从智能搜索、内容创作到自动驾驶,AI正以前所未有的速度重塑着各个行业。然而,伴随AI的飞速发展,其庞大的能源消耗问题也日益凸显,成为业界和公众关注的焦点。据数据显示,美国用电量在过去一年中显著上升近4%,打破了数十年来相对平稳的趋势,而这一增长很大程度上与数据中心的快速扩张及其承载的AI算力需求密切相关。特别是在部分地区,燃煤发电占比的回升,使得AI的环境足迹面临严峻挑战。

长期以来,准确评估AI的真实环境影响一直是个复杂的问题。学术研究虽能测算单个AI模型的功率需求,但将其推广至实际应用场景,如海量用户查询和持续运行的数据中心,存在巨大挑战。数据的匮乏使得外部观察者难以窥探AI能耗的全貌。正是在这样的背景下,谷歌作为全球领先的科技巨头,凭借其对海量真实世界数据的掌控,发布了一份关于AI环境影响的深度分析报告,为我们揭示了AI能效优化的惊人潜力。

谷歌AI能耗分析的独特视角与方法论

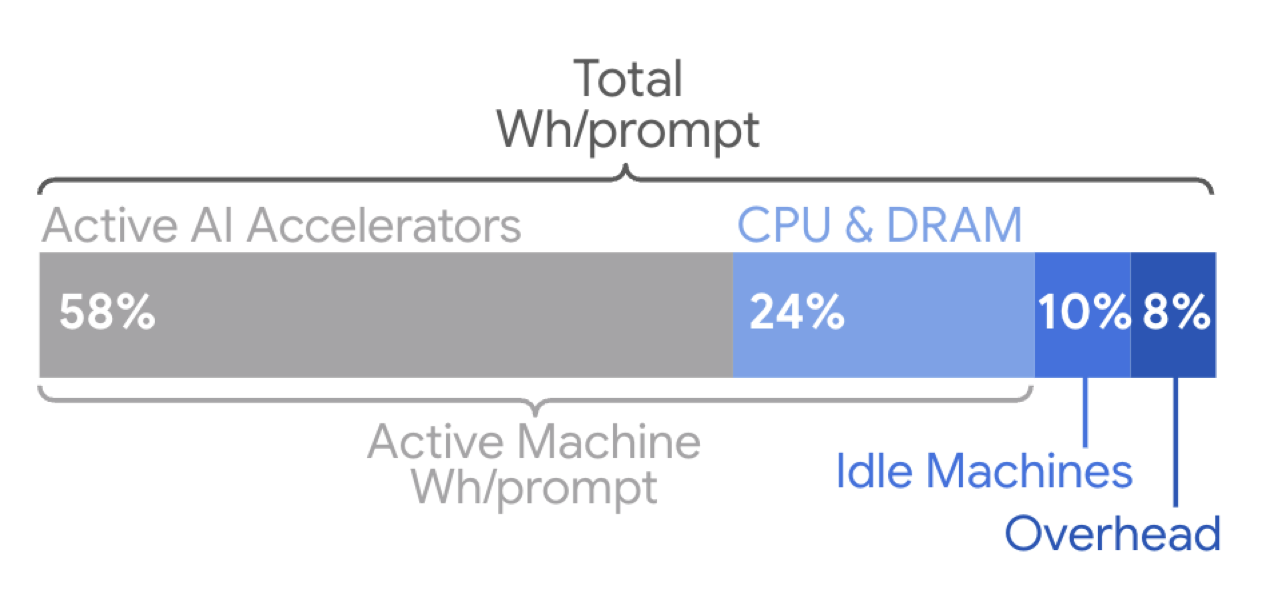

谷歌的这份分析报告提供了一个难得的机会,让我们得以一窥AI大规模部署下的能耗细节。与以往受数据限制的研究不同,谷歌的分析覆盖了更全面的能耗要素,包括处理器(CPU)、专用AI加速器(如TPU)和内存的能耗,无论是处理请求时的活跃状态还是请求间隙的空闲状态。此外,它还考虑了数据中心整体的能源和水资源消耗,并根据AI查询所占用的比例进行估算。更进一步,报告甚至追踪了与电力供应相关的碳排放,以及硬件制造过程中的隐含排放。

然而,为了确保分析的聚焦性和可操作性,谷歌也审慎地排除了部分因素。例如,网络传输和用户终端硬件(如智能手机或高性能PC)的能耗未被纳入,因为这些因素的差异性巨大且难以统一衡量。值得注意的是,AI模型的“训练”能耗——一个通常非常巨大的成本——也未被计入此次“查询”能耗的评估之中。尽管谷歌显然拥有这方面的数据,但选择将其与查询能耗区分开来,可能旨在更清晰地衡量模型部署后的运行效率。该团队通过对24小时内实际请求及其服务硬件的追踪,以及对硬件空闲时间的统计,推算出每次请求的平均能耗,并以每天的“中位数提示词”作为基准进行影响计算。

惊人的效率跃升:AI查询能耗一年骤降33倍

根据这份开创性的分析,谷歌得出了令人瞩目的结论:单个AI文本查询的能耗极低。报告指出,一次典型的Gemini Apps文本提示平均消耗约0.24瓦时电能,产生约0.03克二氧化碳当量(gCO2e),并消耗约0.26毫升(大约五滴)水。为了提供更直观的对比,谷歌估算这一能耗水平与观看约九秒电视节目相当。

诚然,尽管单个查询的能耗已大幅降低,但考虑到AI查询的庞大体量——例如,谷歌已将其应用于每一次搜索请求中,这在几年前是闻所未闻的计算需求——累积起来的能耗仍将是巨大的。然而,真正的“好消息”在于,仅仅在一年前,这一数字会比现在糟糕得多。谷歌声称,在过去一年中,其AI查询的能耗下降了33倍,这是一项非凡的成就。

深度剖析谷歌的能效优化策略

谷歌能取得如此显著的能效提升,并非偶然,而是多方面协同优化的结果。其策略涵盖了从能源采购、软件算法到定制硬件设计的全栈式创新。

1. 绿色能源的战略整合:

首先,随着美国及全球范围内太阳能等可再生能源的快速发展和部署,谷歌更容易实现其数据中心的绿色电力供应。在过去一年中,每单位能源消耗产生的碳排放量减少了1.4倍,这直接降低了AI服务的碳足迹。通过与可再生能源供应商建立长期合作关系,谷歌确保其数据中心尽可能使用清洁能源运行,这是其整体可持续发展战略的重要组成部分。

2. 软件层面的智能算法优化:

软件创新是实现33倍能耗降低的核心驱动力。谷歌团队描述了几种关键优化措施:

- 混合专家模型(Mixture-of-Experts, MoE): 这是一种先进的机器学习架构,其核心思想是根据不同的输入请求,只激活模型中特定且最相关的“专家”子网络进行计算。这意味着,一个大型AI模型在处理某个特定查询时,无需全面激活所有参数,从而将计算需求降低10到100倍。这种按需激活的机制极大地提升了模型的运行效率。

- 模型紧凑化与量化: 谷歌开发了多款其主模型的紧凑版本。通过模型蒸馏、量化等技术,可以在保持较高性能的同时,大幅减少模型的参数量和计算复杂度,使其在更少的资源下运行,进一步降低了计算负荷。

- 数据中心资源智能管理: 精细化的数据中心运营和管理也发挥了关键作用。谷歌能够确保活跃的硬件资源得到充分利用,而在没有请求时,则允许设备进入低功耗休眠状态。这种动态的资源调度最大化了硬件效率,减少了空闲能耗。

3. 硬件协同设计与定制加速器:

谷歌的另一个独特优势在于其自主设计定制AI加速器(如TPU)并开发相应的运行软件。这种软硬件协同设计的能力,使得谷歌能够针对AI工作负载进行端到端的深度优化。由于AI加速器上的活动占到单次查询总能耗的一半以上,因此在硬件层面进行优化显得尤为关键。谷歌在构建高效数据中心方面积累的丰富经验,也成功地应用到了AI基础设施的建设中。

AI请求服务中大部分能耗来自定制加速器芯片。图源:Elsworth et al.

AI请求服务中大部分能耗来自定制加速器芯片。图源:Elsworth et al.

所有这些努力的综合结果是,一次典型文本查询的能耗在一年内下降了33倍。这种效率提升带来了显著的连锁效应。例如,与硬件制造相关的碳排放成本,因为硬件在其使用寿命内能处理更多的查询,而被“稀释”了,从而降低了单位查询的隐含环境成本。

行业启示与未来展望

谷歌并没有将这些成果仅仅作为一项公关活动。相反,它以一种类似学术出版物的严谨方式详细阐述了其方法论和考量因素。其背后更深层次的意图是,希望推动整个AI领域采纳这种或类似全面的测量框架。报告的作者们总结道:“我们倡导广泛采用这种或类似全面的测量框架,以确保随着AI能力的进步,其环境效率也能同步提升。”

谷歌的案例为整个AI行业提供了一个清晰的范本,证明了通过技术创新和战略规划,AI的能耗问题并非不可逾越。这不仅仅是技术竞赛,更是企业社会责任的体现。未来,随着AI技术持续演进,对能效和可持续性的追求将成为衡量AI发展质量的重要标准。行业内的参与者,无论是大型科技公司还是初创企业,都应积极响应,共同构建一个更加高效、绿色的智能未来。通过透明的能耗报告和共享最佳实践,AI有望在为人类创造巨大价值的同时,最大程度地降低对地球环境的影响,实现技术与自然的和谐共生。