AI技术持续渗透至我们日常生活的方方面面,其中智能助手如谷歌Gemini,其与用户数据的交互方式正经历着前所未有的演变。这些变化不仅旨在提升用户体验,也深刻触及到个人隐私与数据主权的敏感议题。理解并主动管理这些新特性,对于确保数字时代的个人信息安全至关重要。

Gemini个性化上下文:深度学习与双刃剑

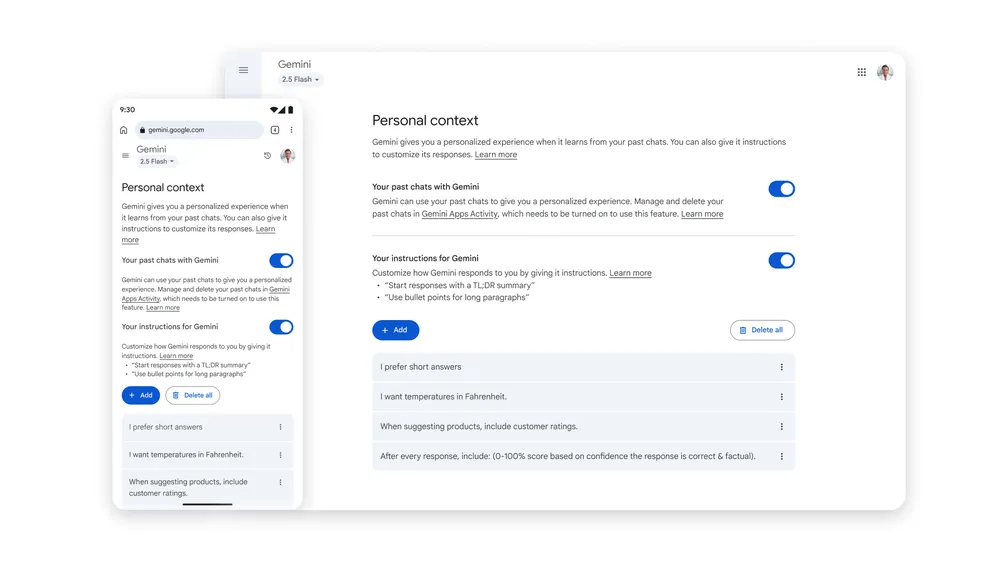

谷歌近期为Gemini引入了名为“个人上下文”的全新功能,此举标志着AI个性化服务迈入了更深层次。该功能的核心在于允许Gemini记忆用户过往对话中的特定细节,从而在未来的互动中提供更为精准、更贴合个人需求的回应。例如,当用户频繁讨论某个特定兴趣或职业领域时,Gemini将无需再次提示,即可根据这些历史信息进行推荐或生成内容。

这种深度学习机制的初衷是优化用户体验,使AI助手不再是“失忆症患者”,能够更好地理解和预判用户需求。特别是在寻求个性化推荐(如电影、书籍、旅行目的地等)时,个人上下文有望显著提升响应的相关性。它与用户明确设定的“保存指令”不同,后者是用户主动赋予AI的特定行为指南,而个人上下文则更侧重于AI基于历史交互的自主适应。

然而,深度个性化也伴随着潜在的风险。人工智能模型若与用户过于“亲近”,可能在无意中固化用户的某些认知偏见,甚至助长误导性信息或引发“妄想性”思维。此前已有研究指出,过度依赖AI助手可能导致用户对现实的判断力下降。因此,即便这项功能旨在提高便捷性,用户也需对其潜在的负面影响保持警惕,定期审视和调整AI的学习范围。

目前,个人上下文功能首先在Gemini 2.5 Pro模型上推出,并且对特定地区(如欧盟、英国和瑞士)的用户以及未满18岁的用户有所限制。谷歌计划未来将其扩展至更多区域,并支持更为高效的Gemini 2.5 Flash模型。用户可以随时在Gemini的主设置页面中启用或禁用此功能,以此来掌握AI的学习边界。

临时聊天:数字世界的“隐身模式”

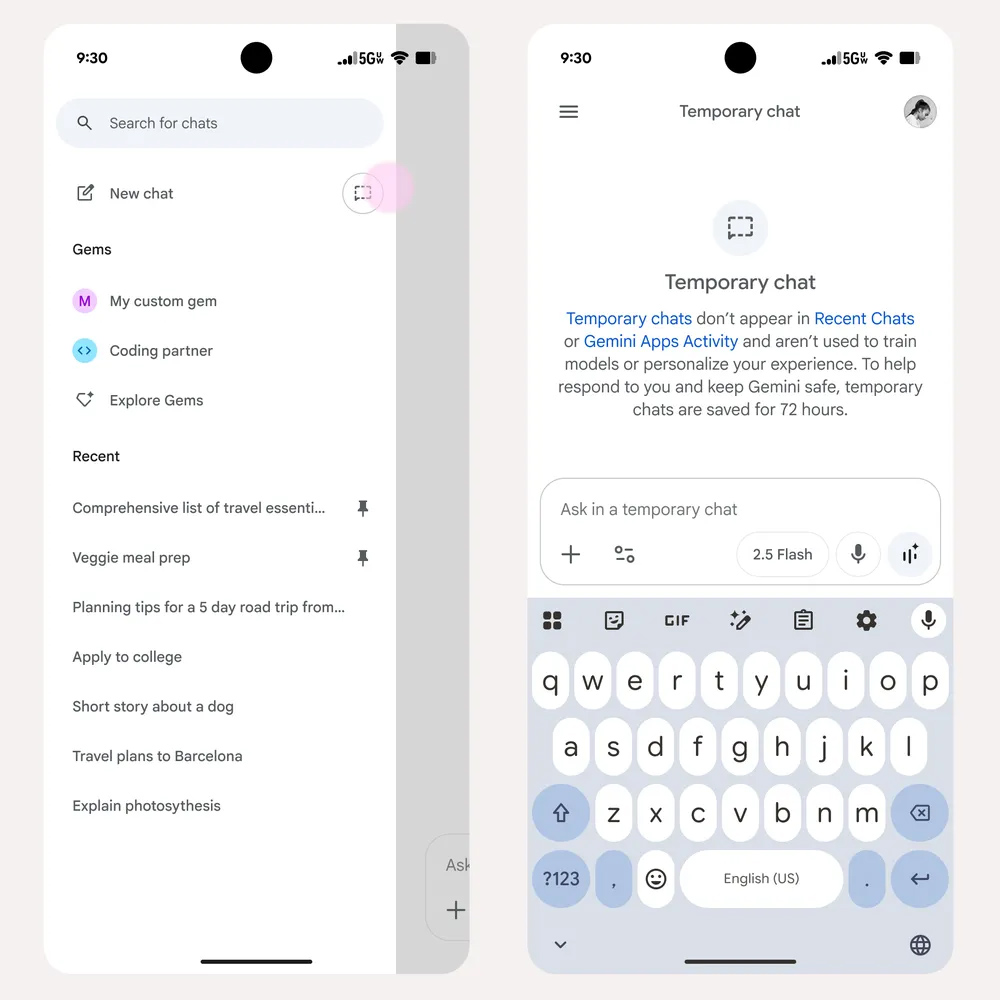

随着Gemini个性化能力的增强,用户对隐私保护的需求也日益凸显。为此,谷歌同步推出了“临时聊天”功能,这可以被视为Gemini的“隐身模式”。它为那些希望在不影响AI长期学习的前提下进行一次性对话的用户,提供了一个安全的港湾。

临时聊天与主界面的“新聊天”选项并列,通过一个专门的按钮即可启动。在此模式下进行的所有对话内容,都不会被纳入Gemini的个人上下文学习范围。这意味着用户可以放心地讨论敏感话题,而不必担心这些信息会被AI长期记忆并用于未来的个性化服务。

尽管被称为“临时”,但这些聊天记录并非即时消失。谷歌表示,临时聊天的内容将在服务器上保留72小时。这一设计旨在提供一定的便利性,允许用户在此期间回顾对话或继续进行。超过72小时后,这些记录将被自动删除,确保其临时性和隐私性。这项功能的逐步推出,预计将在未来几周内覆盖所有用户,提供更加灵活的隐私管理选项。

数据训练政策的重大调整:默认即参与?

除了上述针对用户互动的新功能,谷歌还宣布了一项关于Gemini数据使用策略的重大调整,这直接关系到用户数据的处理方式。自9月2日起,Gemini将默认使用部分用户聊天内容和上传数据(包括文件)来训练谷歌的AI模型。用谷歌官方的说法,此举是为了“改进所有人的谷歌服务”。

这意味着,除非用户主动选择退出,否则其在Gemini中的部分交互数据将用于AI模型的迭代与优化。这引发了广泛的关注和讨论,因为用户数据的贡献直接影响着AI的进步方向。对于企业而言,通过海量真实数据训练模型能够显著提升AI的理解力、生成能力和泛化性,从而提供更智能、更高效的服务。

然而,对于用户而言,这种默认参与的机制要求他们必须主动行使数据主权。如果用户不希望自己的数据被用于AI模型训练,则需要在谷歌账户层级的隐私设置中进行操作。谷歌将在未来几周内更新其账户隐私设置,将原有的“Gemini应用活动”更改为“保留活动”。用户可以禁用此设置,或者在每次对话时使用“临时聊天”模式,以防止数据被用于模型开发。

用户数据主权的实践与反思

在AI技术飞速发展的当下,用户数据与AI模型训练之间的关系日益紧密。谷歌Gemini的这些新变化,无疑将智能助手推向了更个性化、更智能的未来。但同时,它们也对用户的数字素养和隐私管理能力提出了更高的要求。

为了有效保护个人数据,用户应采取以下策略:

- 定期审视隐私设置: 主动查看并理解Gemini以及谷歌账户中的隐私设置,特别是关于“个人上下文”和“保留活动”的选项。

- 审慎选择: 根据对话内容的敏感程度,灵活选择使用“临时聊天”模式,或在必要时禁用“个人上下文”功能。

- 了解数据流向: 关注AI服务商的隐私政策更新,明确自己的数据将如何被收集、存储和使用。

- 平衡利弊: 在享受AI个性化带来的便利与维护个人数据隐私之间找到平衡点,根据自身需求做出明智决策。

这些调整是AI行业发展中的必然趋势。随着AI模型对数据的需求不断增长,如何在确保技术进步的同时,最大程度地尊重并保护用户隐私,将是所有AI服务提供商必须长期面对的挑战。对于用户而言,成为一个知情且主动的参与者,而非被动的接受者,是驾驭这一变革时代的关键。只有当用户能够真正掌控自己的数据,AI的未来才能更健康、更可持续地发展。