AI大模型时代对算力基础设施的挑战与机遇

随着人工智能技术的飞速发展,特别是生成式AI和大语言模型的兴起,对底层计算基础设施提出了前所未有的高要求。这些模型动辄拥有千亿乃至万亿级的参数,其训练和推理过程需要海量的算力支持、高效的数据传输以及极致优化的系统调度。传统的计算架构已难以满足这种指数级增长的需求,效率瓶颈日益凸显,直接影响了AI应用的创新速度与普及广度。正是在这一背景下,百度智能云审时度势,重磅推出了百舸AI计算平台5.0,旨在通过全面的技术革新,打破现有AI计算的效率壁垒,为各行各业的智能化转型提供强大支撑。

百舸AI计算平台5.0:四大核心支柱全面革新

百舸AI计算平台5.0的发布,标志着百度在AI计算基础设施领域迈出了重要一步。此次升级并非简单的功能迭代,而是从网络、算力、推理系统以及训推一体化等四大核心维度进行深度优化,力求构建一个更高效、更稳定、更易用的AI计算生态。

网络:构建AI高速信息通路

在大规模AI模型训练中,数据在计算节点间的传输速度和延迟是决定整体效率的关键因素。千亿级参数模型通常需要在数千甚至上万个GPU上并行训练,如果网络通信存在瓶颈,再强大的计算单元也难以充分发挥其潜能。百舸5.0在网络层面进行了全面强化,采用高性能RDMA(远程直接内存访问)网络和专属的低延迟互联技术,显著提升了数据吞吐能力,并大幅降低了节点间通信的平均延迟。这意味着模型训练过程中各计算单元之间的数据交换更加迅速流畅,有效减少了同步等待时间,从而加速了模型的收敛速度和整体训练周期。对于追求极致效率的AI研发团队而言,这种网络层面的优化无疑是提升生产力的关键一步。

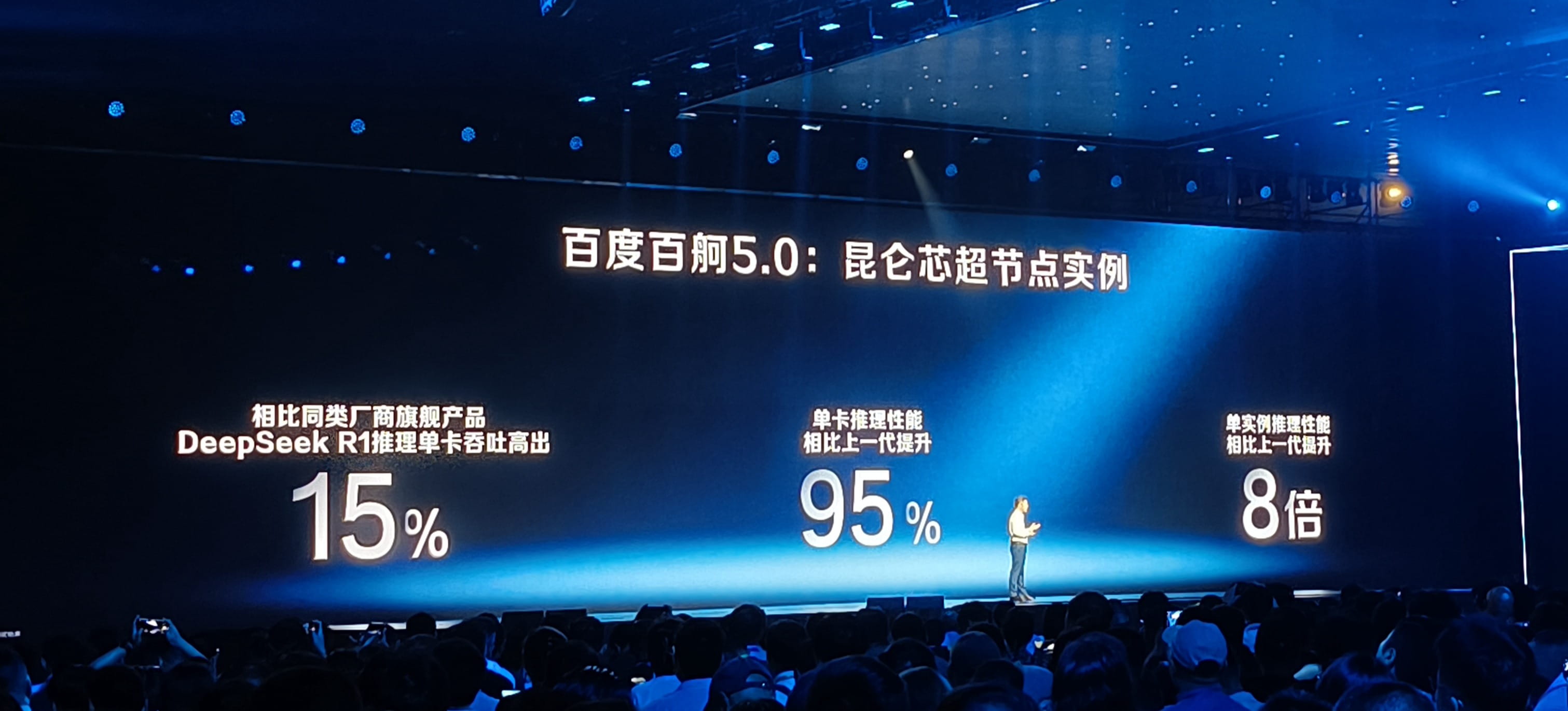

算力核心:昆仑芯超节点赋能万亿级模型

算力是AI发展的基石,而专用AI芯片则是提供高性能算力的核心。百度自研的昆仑芯AI芯片,正是针对AI任务的计算特性进行了深度优化。在百舸AI计算平台5.0中,昆仑芯超节点的正式上线,将这一算力提升到了新的高度。所谓“超节点”,是将多个昆仑芯及配套的高速存储、互联硬件高效集成,形成一个具备超强计算能力的统一体。它不仅提供了强大的并行计算能力,更通过软硬一体的协同优化,实现了极高的算力利用率。

此前,运行一个万亿级参数的大型开源模型,对于许多企业和开发者而言,是一项成本高昂且技术复杂的任务。然而,借助百舸5.0的昆仑芯超节点,这一门槛被极大降低。现在,用户只需几分钟时间,通过一个云实例,就能轻松启动并运行万亿级模型。这不仅民主化了高性能AI算力,让更多中小企业和个人开发者能够触及并利用最前沿的AI技术,也极大地加速了大型模型在不同场景下的应用探索与落地。昆仑芯超节点的普及,预示着AI大模型将不再是少数巨头的专属,而是成为普惠大众的智能工具。

推理系统:解耦、自适应与智能调度的艺术

除了模型训练,高效的推理能力同样是AI应用能否商业化成功的关键。面对高并发、低延迟的实时AI服务需求,百舸5.0的推理系统采用了“解耦”、“自适应”和“智能调度”三大核心策略,旨在最大化推理吞吐量并最小化服务延迟。

- 解耦:将推理服务与底层的硬件资源进行深度解耦。这意味着无论底层硬件如何变化,推理服务都能以统一、灵活的方式部署和运行,大大提升了系统的可维护性和扩展性。

- 自适应:推理系统能够根据实时的负载情况、模型特性以及资源状况,动态地调整资源分配策略、并发批处理大小(batch size)和模型加载方案。这种智能响应机制确保了在高压场景下也能保持服务质量,有效避免了资源浪费和性能瓶颈。

- 智能调度:通过集成先进的AI算法,系统能够智能地调度推理请求,优化任务排队、模型加载与卸载,并进行高效的计算资源分配。例如,对于需要低延迟响应的请求,系统会优先分配空闲资源或优化模型加载顺序;对于吞吐量要求更高的任务,则会采用更大的批处理并优化并行执行。

这些策略的综合运用,使得百舸5.0的推理系统能够显著提升吞吐量,同时有效降低平均延迟,确保了AI应用在人脸识别、语音交互、推荐系统等对实时性要求极高的场景下,能够提供流畅、准确的用户体验。

训推一体化:百舸强化学习框架压榨算力潜力

传统的AI开发流程往往将训练和推理视为相对独立的环节,这不仅增加了开发和部署的复杂性,也可能导致资源利用率不高。百舸AI计算平台5.0通过发布百舸强化学习框架,进一步推动了训推一体化的发展,旨在实现对算力资源的极致压榨,提升整体效率。

强化学习作为人工智能领域的前沿方向,其训练过程通常涉及大量的试错、环境交互和策略更新,对计算资源的需求呈现出高度动态和迭代的特点。百舸强化学习框架正是为应对此类挑战而设计,它深度融合了训练和推理的生命周期,提供了一套统一且优化的工具链。该框架能够智能地管理和调度训练与推理所需的计算资源,减少了模型在不同阶段间的切换开销。通过对底层硬件和软件堆栈的精细化控制,该框架能够最大程度地提升昆仑芯等AI芯片的利用率,使得即使是复杂的强化学习任务也能在有限的资源下实现更快的训练和更高效的策略部署。这不仅加速了前沿AI模型的研发进程,也为自动驾驶、机器人控制等对实时决策和环境适应能力有高要求的领域,提供了强大的技术支撑。

赋能AI创新生态的加速器

百度智能云百舸AI计算平台5.0的全面升级,是百度在AI基础设施领域深厚积累的集中体现。它不仅仅是硬件算力的简单叠加,更是通过网络优化、芯片创新、系统级调度和训推一体化等多维度协同,构建了一个从底层硬件到上层框架的完整高效的AI计算体系。这一平台有效地解决了当前AI大模型发展所面临的算力瓶颈和效率挑战,为开发者和企业提供了前所未有的强大工具。它将加速AI技术从实验室走向广泛应用,推动各行各业的智能化转型进入一个全新的阶段,最终赋能更广泛的AI创新生态,共同迎接智能时代的新机遇。