在当前全球人工智能技术飞速发展的浪潮中,对强大、高效计算能力的需求达到了前所未有的高度。尤其是在大模型时代,训练参数突破万亿,对基础设施的挑战也日益严峻。正是在这样的背景下,百度智能云在2025年的云智大会上,隆重推出了其AI计算基础设施的全面升级成果——百舸AI计算平台5.0全新版本。此次升级不仅仅是简单的迭代,而是在网络、算力、推理系统以及训推一体化系统等核心支柱上,实现了全面的能力跃升,旨在根本性地打破AI计算效率瓶颈,为行业发展注入新动能。

百舸AI计算平台5.0的发布,标志着百度智能云在构建面向未来的AI算力底座方面迈出了坚实一步。它不仅为大模型的研发和应用提供了坚实支撑,更通过一系列创新技术,确保了AI任务从训练到推理的全流程高效流畅运行。

网络通信效率的飞跃:低延迟与高带宽的融合

在大规模AI模型训练中,数以百计乃至千计的计算节点需要进行频繁的数据交换和模型参数同步。网络通信的效率直接决定了整个训练过程的快慢。传统网络架构往往成为性能瓶颈,导致算力无法充分发挥。

百舸AI计算平台5.0在网络层面的升级,核心在于构建一个更快速、更低延迟、更高带宽的通信基础设施。这包括引入先进的RDMA(Remote Direct Memory Access)技术,实现计算节点间数据的零拷贝传输,大幅减少CPU介入,降低延迟。同时,通过优化网络拓扑结构和采用新一代高速互联技术,确保了在多GPU、多服务器集群协同工作时,数据传输的效率最大化。这种通信效率的提升,对于加快模型收敛速度、提升分布式训练稳定性具有决定性意义,使得大规模模型能够以更高的并行度进行训练,显著缩短了整体研发周期。

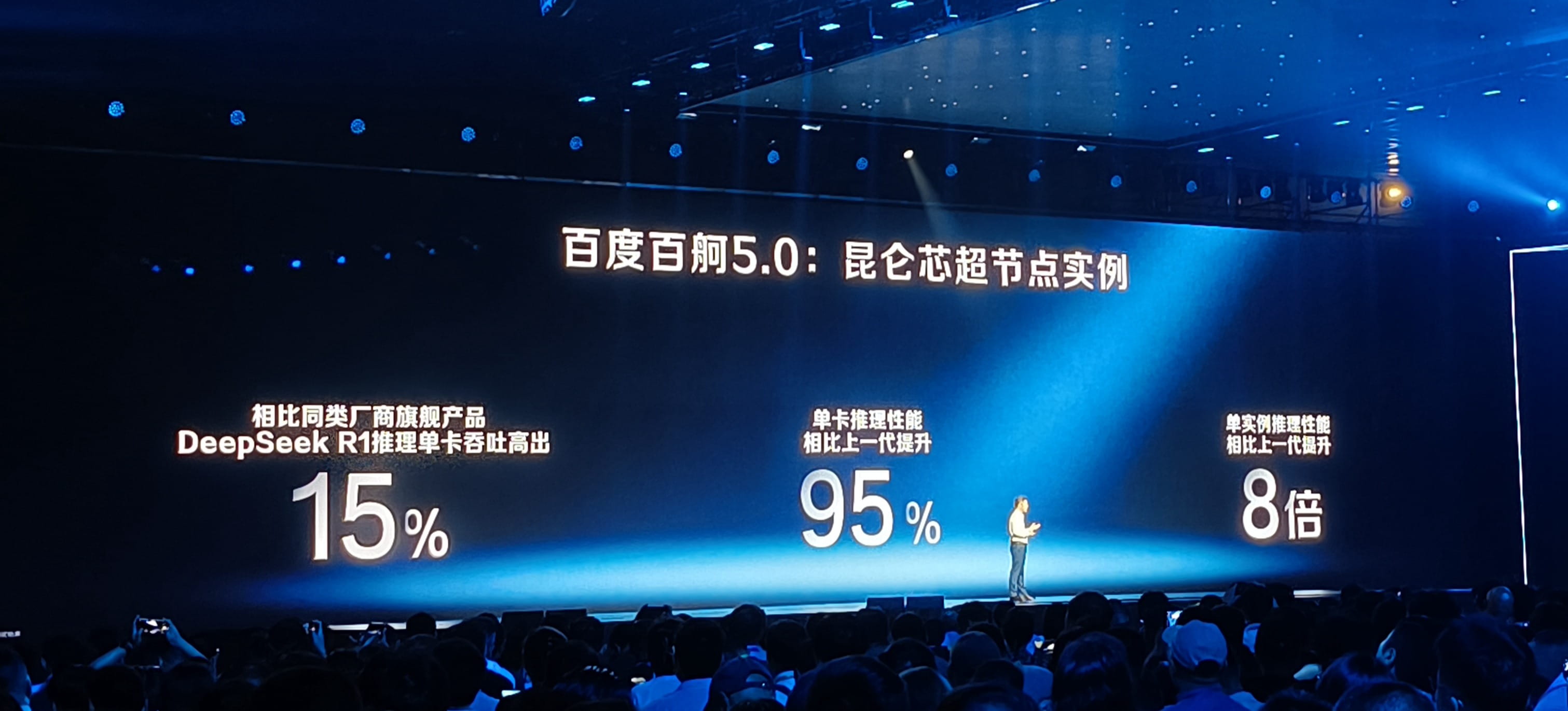

算力新纪元:昆仑芯超节点与万亿参数模型的驾驭

AI算力是推动人工智能发展的核心引擎。随着模型规模的几何级增长,对单点算力和聚合算力的需求也达到了前所未有的高度。百度智能云百舸AI计算平台5.0在此次升级中,最引人注目的莫过于昆仑芯超节点的正式上线并面向公有云服务开放。

昆仑芯作为百度自主研发的AI芯片,其性能已在业界得到广泛认可。而“昆仑芯超节点”的概念,是将海量昆仑芯芯片通过高性能互联技术聚合起来,形成一个拥有超级算力的大型计算集群。这意味着用户无需自行搭建复杂的AI集群,只需通过云服务即可轻松获取和调度近乎无限的算力资源。这种超节点不仅提供了强大的浮点运算能力,更针对AI模型的特点进行了深度优化,例如矩阵乘法、张量计算等操作效率的提升。

在此超节点算力支持下,即使是业界参数量达到万亿级别的最大开源模型,也能在短短几分钟内,通过单个云实例启动并运行。这一能力极大地降低了超大规模模型研究和应用的门槛,使得更多的开发者和企业能够探索和利用大模型的潜力,加速创新步伐。通过提供如此强大的算力支撑,百度智能云正致力于将AI领域的“不可能”变为“可能”,推动更多前沿AI技术的突破与落地。

推理系统革新:智能调度下的极致吞吐与低延迟

除了模型训练,AI的实际应用更离不开高效的推理系统。推理系统面临的挑战是多样化的:它需要应对实时性要求极高的在线服务,也需要处理批量数据处理任务;同时,还需要在有限的硬件资源下,最大化吞吐量并尽可能降低延迟。百舸AI计算平台5.0在推理系统上采用了“解耦”、“自适应”和“智能调度”三大核心策略,以应对这些复杂需求。

“解耦”策略将推理任务的各个环节(如模型加载、输入预处理、模型执行、输出后处理)进行模块化分离,减少了模块间的耦合,从而提升了系统的灵活性和可维护性。这使得系统可以针对不同任务动态组合和优化流程,避免了不必要的资源浪费。

“自适应”策略则意味着推理系统能够根据实时的负载情况、资源使用率以及服务质量(QoS)要求,动态调整资源分配和并发策略。例如,在高并发场景下,系统可以自动扩容并优化批处理大小(batch size),以提升整体吞吐量;在低延迟场景下,则可能采用更小的批处理,确保快速响应。

“智能调度”是连接前两者的核心大脑。它利用先进的AI算法和优化模型,对推理请求进行精细化管理和资源分配,确保每个请求都能被最优的计算资源处理,并在规定时间内返回结果。这种智能调度不仅提升了单个模型的推理效率,更在多模型、多任务并发运行的环境下,实现了整体资源的极致利用和性能的最优化。通过这三大策略的协同作用,百舸AI计算平台5.0的推理系统能够为用户提供行业领先的吞吐量和毫秒级的低延迟服务,为各类AI应用场景提供了坚实保障。

训推一体化:百舸强化学习框架的性能飞轮

AI模型从研发到部署,通常经历训练和推理两个阶段。传统的流程中,训练和推理之间可能存在技术栈不兼容、数据格式转换繁琐、版本管理复杂等问题,导致效率低下。百舸AI计算平台5.0通过发布百舸强化学习框架,进一步完善了其训推一体化能力,旨在构建一个无缝衔接、高效协同的AI全生命周期管理平台。

强化学习(RL)是当前AI领域的热点之一,但其对计算资源的需求和训练过程的复杂性远超监督学习。百舸强化学习框架专门针对RL的特点进行设计和优化,实现了对算力资源的极致压榨。这包括但不限于:高效的样本采集与存储机制、分布式训练的优化策略、模型与环境的并行交互能力,以及对多种RL算法的通用支持。通过这一框架,开发者可以更便捷地进行复杂的强化学习实验,加速智能体的训练过程。

“训推一体化”的理念贯穿于百舸AI计算平台5.0的始终。它确保了模型在训练完成后,能够以最小的改动、最高的效率部署到推理环境中。这种无缝衔接不仅减少了开发和运维的工作量,更使得AI模型能够更快地迭代和更新,形成一个“训练-部署-反馈-再训练”的闭环,极大地提升了AI系统的整体效能和灵活性。这对于需要快速响应市场变化、持续优化模型性能的业务场景尤为关键。

突破AI计算瓶颈的深远意义

百舸AI计算平台5.0的全面升级,不仅仅是技术参数的提升,其背后蕴含的是对整个AI产业发展的深远影响。首先,它通过提供可负担的、高性能的AI计算服务,降低了AI技术创新的门槛,使得更多中小企业和个人开发者能够接触和使用顶尖的AI算力,加速创意孵化和技术落地。其次,它为大模型、AGI(通用人工智能)等前沿研究提供了强大的基础设施支持,使得科学家和研究人员能够更大胆地探索未知领域,推动AI理论和应用实现新的突破。最后,高效的训推一体化能力,加速了AI技术从实验室到实际应用的转化,缩短了产品上市周期,为各行各业的智能化转型提供了坚实的技术保障。

此次升级,是百度智能云在持续投入AI基础设施建设上的又一力证。它不仅体现了百度在AI技术领域的深厚积累,更展示了其致力于构建一个开放、普惠、高效的AI生态系统的决心。随着AI技术的不断演进,对计算能力的需求将持续增长,而百舸AI计算平台5.0的推出,无疑为未来的AI发展奠定了坚实的基础,开启了AI算力新篇章,助力全球各行各业实现智能化转型升级。