人工智能语言模型如GPT-5在训练数据中展现出两大主要处理特征:记忆(复述之前见过的精确文本,如著名引言或书籍段落)和所谓的"推理"(使用通用原理解决新问题)。来自AI初创公司Goodfire.ai的新研究首次提供了明确证据,表明这些不同功能实际上通过模型架构中完全独立的神经路径运作。

记忆与推理的神经分离

研究人员发现,这种分离异常清晰。在10月底发布的预印本论文中,他们描述了当移除记忆路径时,模型失去了97%的原文复述能力,但保持了几乎全部的"逻辑推理"能力。

以艾伦人工智能研究所的OLMo-7B语言模型第22层为例,研究人员根据称为"曲率"的指标(下文将详细解释)将所有权重组件(处理信息的数学值)从高到低排序。当他们检查这些排序后的组件时,排名靠后的50%权重组件在记忆数据上的激活高出23%,而排名前10%的组件在普通、非记忆文本上的激活高出26%。

换句话说,专门用于记忆的组件聚集在排名的底部,而问题解决组件则聚集在顶部。这种机制分离使研究人员能够精准地移除记忆,同时保留其他能力。他们发现可以删除排名靠后的组件来消除记忆,同时保留处理问题解决的排名靠前的组件。

算术运算与记忆的意外联系

最令人惊讶的是,研究人员发现算术运算似乎与记忆共享相同的神经路径,而非逻辑推理。当移除记忆电路时,数学性能骤降至66%,而逻辑任务几乎不受影响。这一发现可能解释了为何AI语言模型在未使用外部工具时 notoriously 在数学方面表现不佳。它们试图从有限的记忆表中回忆算术,而非真正进行计算,就像一个记住了乘法表但从未理解乘法如何运作的学生。

这一发现表明,在当前规模下,语言模型将"2+2=4"更多地视为记忆事实而非逻辑运算。这与人类对数学的理解形成鲜明对比,人类通常将算术视为逻辑推理的应用,而非简单的记忆事实。

"推理"概念的多层次理解

值得注意的是,AI研究中的"推理"涵盖了一系列能力,不一定与我们人类所说的推理完全匹配。在最新研究中,记忆移除后幸存的逻辑推理包括评估真假陈述和遵循if-then规则等任务,这些本质上是将学习到的模式应用于新输入。

这也与当前AI模型即使在模式匹配能力保持完整的情况下仍然 struggle 的更深层次的"数学推理"(如证明或新颖问题解决)有所不同。这种区别表明,AI的"推理"能力可能比人类所理解的更为基础和有限。

损失景观:理解AI思维的新视角

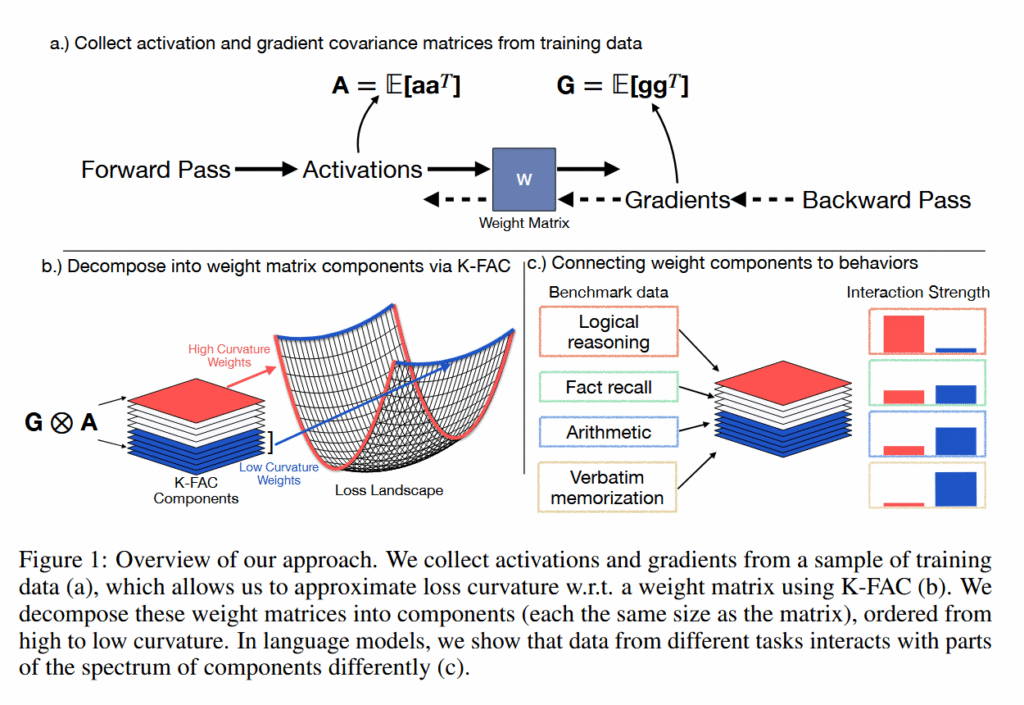

为了理解Goodfire的研究人员如何在这些神经网络中区分记忆与推理,了解AI中称为"损失景观"的概念很有帮助。"损失景观"是一种可视化AI模型预测在调整其内部设置(称为"权重")时正确或错误程度的方式。

想象你在调校一台有数百万个旋钮的复杂机器。"损失"衡量机器犯错误的数量。高损失意味着许多错误,低损失意味着错误很少。"景观"是你可以映射出每个旋钮设置组合错误率时看到的内容。

在训练过程中,AI模型本质上在这个景观中"滚下山坡"(梯度下降),调整其权重以找到错误最少的山谷。这个过程提供了AI模型的输出,比如对问题的回答。

研究人员分析了特定AI语言模型损失景观的"曲率",测量模型性能对不同神经网络权重微小变化的敏感度。尖锐的峰谷代表高曲率(微小变化导致大效果),而平坦的平原代表低曲率(变化影响最小)。他们使用这些曲率值将权重组件从高到低排序,如前所述。

使用称为K-FAC(Kronecker分解近似曲率)的技术,他们发现单个记忆的事实在这个景观中创造了尖锐的尖峰,但由于每个记忆项在不同的方向上尖峰,当它们平均在一起时,创造了平坦的轮廓。同时,许多不同输入依赖的推理能力在整个景观中保持一致的适度曲线,就像无论从哪个方向接近,形状基本相同的起伏山丘。

研究人员写道:"实现许多输入共享机制的路径会相干地叠加并保持平均高曲率,"描述推理路径。相比之下,记忆使用"与特定示例相关的特殊尖锐方向",当跨数据平均时呈现平坦。

不同任务揭示的机制光谱

研究人员在多个AI系统上测试了他们的技术,以验证这些发现在不同架构中是否成立。他们主要使用艾伦研究所的OLMo-2开放语言模型系列,特别是70亿和10亿参数版本,选择它们是因为其训练数据公开可访问。对于视觉模型,他们在ImageNet上训练了定制的8600万参数Vision Transformer(ViT-Base模型),并故意使用错误标签的数据来创建受控记忆。他们还对照现有的记忆移除方法(如BalancedSubnet)验证了他们的发现,以建立性能基准。

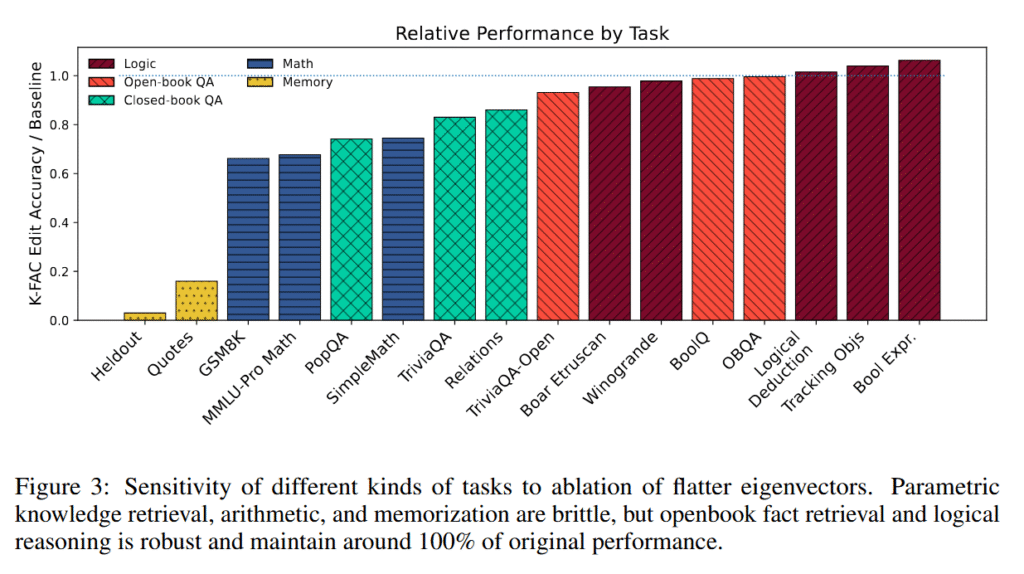

该团队通过有选择地从这些训练好的模型中移除低曲率权重组件来测试他们的发现。记忆内容从接近100%的回忆率下降到3.4%。同时,逻辑推理任务保持了95%到106%的基线性能。

这些逻辑任务包括布尔表达式评估、逻辑推理谜题(解决者必须跟踪"如果A比B高"等关系)、通过多次交换进行目标跟踪,以及基准测试,如用于是非推理的BoolQ、用于常识推理的Winogrande和需要根据提供的事实进行推理的科学问题OpenBookQA。一些任务介于这两个极端之间,揭示了机制的光谱。

数学运算和闭卷事实检索与记忆共享路径,在编辑后性能降至66%到86%。研究人员发现算术特别脆弱。即使模型生成相同的推理链,在移除低曲率组件后,它们仍然在计算步骤上失败。

"算术问题本身在7B规模下被记忆,或者因为它们需要使用狭窄使用的方向来进行精确计算,"团队解释道。依靠提供上下文而非内部知识的开放书籍问答被证明对编辑程序最稳健,保持了接近完整的性能。

有趣的是,机制分离因信息类型而异。像国家首都这样的常见事实在编辑后几乎没有变化,而像公司首席执行官这样的罕见事实下降了78%。这表明模型根据信息在训练中出现的频率分配不同的神经资源。

K-FAC技术在不记忆记忆内容训练示例的情况下,优于现有的记忆移除方法。在未见过的历史引言上,K-FAC实现了16.1%的记忆率,而之前最好的方法BalancedSubnet实现了60%。

视觉变压器显示出类似的模式。当使用故意错误标记的图像训练时,模型发展出用于记忆错误标签与学习正确模式的独立路径。移除记忆路径恢复了先前错误标记图像上66.5%的准确率。

记忆移除的局限性

然而,研究人员承认他们的技术并不完美。一旦被移除的记忆可能会在模型接收更多训练后返回,因为其他研究表明,当前的遗忘方法只是抑制信息,而非从神经网络的权重中完全擦除它。这意味着"被遗忘"的内容只需针对这些被抑制区域的几个训练步骤就可以重新激活。

研究人员也无法完全解释为什么某些能力(如数学)在移除记忆时如此容易崩溃。目前尚不清楚模型是否真的记忆了所有算术,或者数学只是碰巧使用与记忆相似的神经回路。此外,一些复杂能力在他们的检测方法中可能看起来像记忆,即使它们实际上是复杂的推理模式。最后,他们用来测量模型"景观"的数学工具在极端情况下可能变得不可靠,尽管这并不影响实际的编辑过程。

未来展望与潜在应用

展望未来,如果信息移除技术在未来得到进一步发展,AI公司可能有一天能够从神经网络中移除版权内容、私人信息或有害记忆文本,而不会破坏模型执行转换任务的能力。然而,由于神经网络以仍然不完全理解的方式分布式存储信息,研究人员目前表示他们的方法"不能保证敏感信息的完全消除"。这是AI新研究方向中的早期步骤。

这项研究为理解和改进AI模型开辟了新途径。通过识别和分离记忆与推理的神经路径,研究人员可能能够开发出更高效、更安全、更符合伦理的AI系统。例如,可以设计出减少有害记忆同时保留有益推理能力的模型,或者创建专门针对特定认知功能优化的专业模型。

此外,这一发现可能对AI教育应用产生深远影响。如果能够理解AI如何学习和处理信息,教育者可以设计更有效的教学方法,帮助AI模型更好地掌握数学等学科,而不仅仅是依赖记忆。

结论:AI认知机制的新理解

Goodfire.ai的研究代表了我们对AI神经网络内部运作理解的重要突破。通过证明记忆与推理在神经层面的分离,研究人员不仅揭示了AI学习机制的一个关键方面,还为未来的AI发展和应用提供了新的可能性。

这项研究强调了AI认知机制的复杂性,同时也指出了当前AI模型在数学等领域的局限性。随着这一研究方向的深入,我们可能会看到更先进、更高效、更安全的AI系统的出现,这些系统将更好地模拟人类的认知过程,同时克服当前模型的局限性。

虽然这一技术仍处于早期阶段,但其潜在应用广泛,从提高AI安全性到改善AI教育应用,再到开发更专业化的AI模型。随着研究的深入,我们可能会看到这一技术如何塑造AI的未来发展,以及它如何帮助我们创造更智能、更可靠的AI系统。