人工智能领域正经历着前所未有的快速发展,各大科技公司和研究机构纷纷推出创新成果,推动AI技术向更高效、更实用的方向迈进。本文将深入分析近期AI领域的多项重大突破,从开源模型、智能硬件到应用创新,全面展现AI技术的多元化发展趋势。

阿里巴巴开源Z-Image:轻量化图像生成的新突破

阿里巴巴通义实验室近期开源的Z-Image图像生成模型,代表了AI图像生成领域的重要进展。这一模型凭借仅6B参数规模,实现了接近三倍参数级别商业模型的视觉质量,为AI图像生成领域带来了新的可能性。

技术架构创新

Z-Image采用单流DiT架构,包含Turbo、Base和Edit三种变体,满足了不同场景下的需求。这种模块化设计使得用户可以根据具体应用场景选择最适合的模型版本,实现了灵活性与性能的平衡。

双语文字渲染能力

传统AI图像生成模型在文本处理方面往往存在局限性,而Z-Image通过创新算法实现了中英双语文字的高质量渲染,解决了这一行业痛点。这一特性使得模型在生成包含文字的图像时表现更加出色,拓展了应用场景。

轻量化与高效性能

Z-Image的显存占用低至16GB,可在消费级显卡上流畅运行,大大降低了AI图像生成的技术门槛。这一特性使得个人开发者和中小型企业也能利用先进的AI图像生成技术,无需依赖昂贵的专业设备。

夸克AI眼镜:AI技术进入物理世界的里程碑

夸克AI眼镜的发布标志着阿里千问首次进入物理世界,通过硬件升级和创新技术,为用户提供更高效、便捷的AI体验。这一产品代表了AI技术与硬件融合的新方向。

双旗舰芯片加持

夸克AI眼镜搭载了双旗舰芯片,显著提升了千问的响应速度和性能表现。这种硬件配置使得AI眼镜能够处理更加复杂的任务,为用户提供更加流畅的交互体验。

手机级影像能力

引入手机级影像能力是夸克AI眼镜的另一大亮点,特别是在暗光环境下表现出了卓越的拍摄画质与稳定性。这一特性使得AI眼镜不仅能够提供AI助手功能,还能成为高质量的拍摄工具。

创新电池设计

采用双电池可换电设计,确保了长时间在线待命。这种设计解决了智能设备续航能力不足的普遍问题,使得用户可以长时间使用AI眼镜而无需担心电量问题。

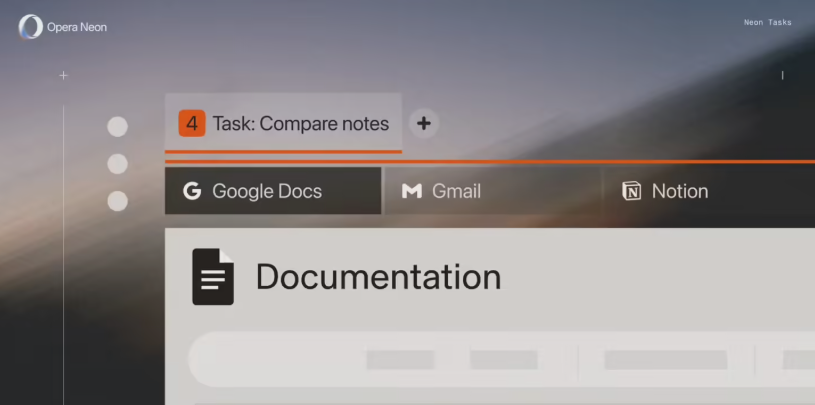

Opera Neon浏览器升级:AI赋能工作流的新范式

Opera Neon浏览器推出的重大更新,新增'1分钟深度研究'模式,集成Gemini3Pro与Nano Banana Pro双模型,并首次支持自然语言创建与编辑Google Docs,代表了AI技术在浏览器应用中的创新突破。

'1分钟深度研究'模式

这一创新模式使用户能够在短时间内获取全面、深入的研究结果,大大提升了复杂问题处理的效率。通过AI技术的加持,浏览器能够快速分析海量信息,提炼出关键内容,为用户提供决策支持。

双模型灵活切换

支持Gemini3Pro与Nano Banana Pro模型切换,使用户能够灵活应对多阶段任务。这种设计使得用户可以根据任务特点选择最适合的AI模型,优化工作流程。

Google Docs智能集成

集成Google Docs智能体,实现自然语言操作文档,显著提高了写作效率。用户可以通过简单的语音指令完成文档创建、编辑和格式调整等操作,大大降低了文档处理的门槛。

清华大学AI应用指导原则:规范与创新的平衡

清华大学发布的《清华大学人工智能教育应用指导原则》,旨在规范校园内人工智能的使用,代表了学术界对AI技术应用的深入思考。

全局性与分层级的引导规范

该指导原则首次系统性地提出了人工智能应用的全局性和分层级的引导规范,涵盖了教学及学术研究的各个核心场景。这种全面的规范体系为AI在教育领域的应用提供了明确的指导框架。

学术诚信的坚守

指导原则强调严禁将AI生成的内容作为学业成果,确保学术诚信。这一规定反映了学术界对AI技术潜在风险的清醒认识,以及在技术应用与学术规范之间寻求平衡的努力。

鼓励创新与规范并行

学校鼓励教师与学生积极探索AI辅助学习,但需遵循明确的使用规范。这种既鼓励创新又强调规范的态度,为AI技术在教育领域的健康发展提供了保障。

DeepMind系统指令:AI从'黑箱'到'工程化'的跨越

DeepMind公开的Gemini 3 Pro专属System Instructions,显著提升了大模型在多个基准测试中的表现,标志着AI技术发展的重要转折点。

任务成功率的显著提升

Gemini 3 Pro的System Instructions提升了Agent任务成功率约5%,这一看似不大的提升在实际应用中具有重要意义,特别是在处理复杂任务时,可靠性的提升能够显著降低错误率。

逻辑推理与风险评估

指令强调逻辑依赖、风险评估和假设探索,增强模型的可靠性。这些能力的提升使得AI系统能够更加接近人类的思维方式,处理更加复杂的问题。

指令工程化的未来方向

DeepMind计划将指令封装为可配置JSON Schema,并在2026年Q1开放给Vertex AI等平台。这一举措将使得AI系统的指令工程变得更加标准化和可扩展,推动AI技术的进一步发展。

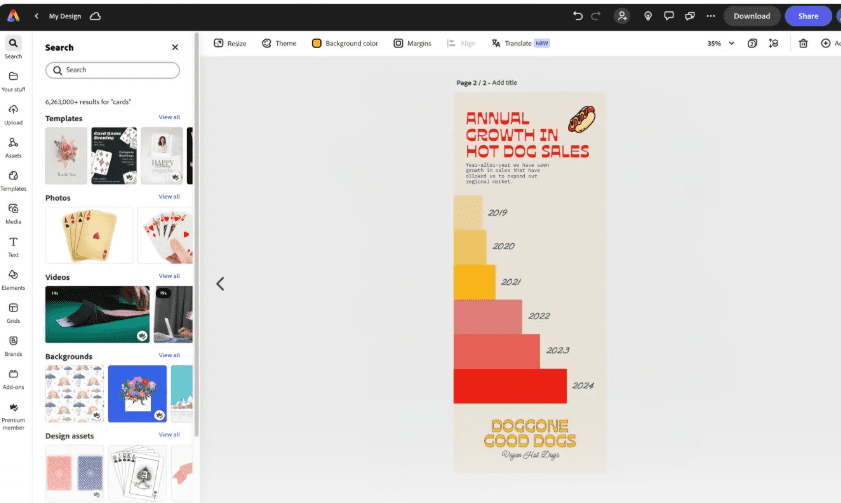

Adobe Project Graph:重塑创意工作流的AI工具

Adobe推出的Project Graph是一个基于节点的视觉化编辑器,旨在帮助艺术家和设计师更高效地自定义创作流程,代表了AI技术在创意领域应用的新方向。

节点式编辑器设计

该系统使用节点编辑器,让用户像搭积木一样自定义创作流程。这种直观的设计方式降低了创意工作流程的复杂度,使非专业用户也能创建复杂的AI驱动工作流。

AI模型与工具的灵活连接

通过将AI模型、工具和效果器连接起来,提升了创作的可控性和精确度。用户可以根据具体需求选择和组合不同的AI工具,实现个性化的创意表达。

工作流的可分享与协作

支持将复杂的工作流打包为可分享的工具,从而提升团队协作效率。这一特性使得创意工作流程可以标准化和规模化,大大提高了创意团队的生产力。

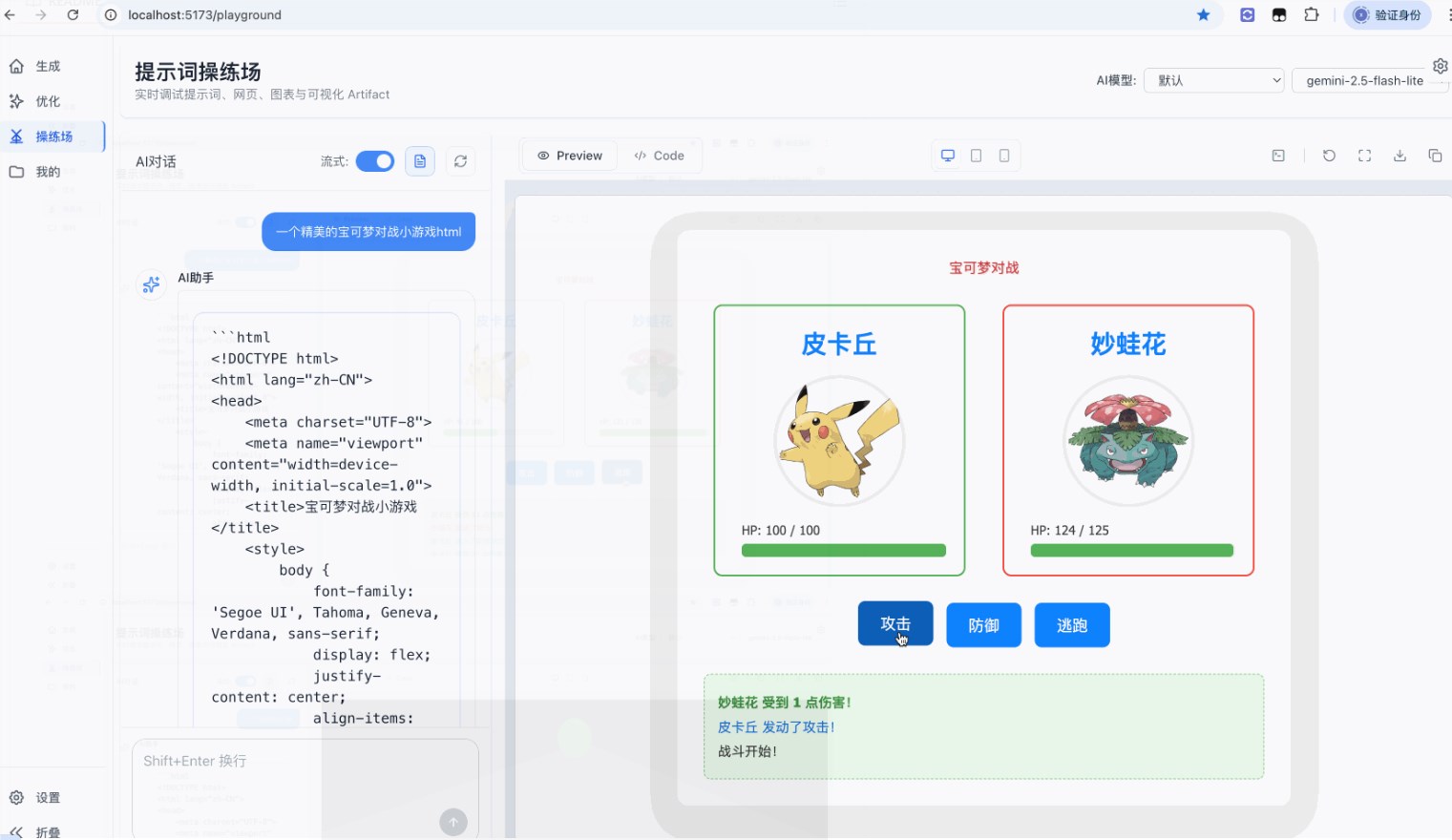

YPrompt:革新提示词工程的聊天式工具

YPrompt是一款创新的聊天式提示词工程工具,通过与用户的对话深入挖掘需求,自动生成专业的提示词,代表了AI辅助创作工具的新趋势。

对话式需求挖掘

通过与用户的对话深入挖掘需求,自动生成专业的提示词。这种交互方式使得AI能够更好地理解用户的真实意图,生成更加精准的提示词。

多种输出格式支持

支持多种输出格式,方便用户即时查看效果。这种灵活性使得用户可以根据不同的应用场景选择最适合的提示词格式,提高了工具的实用性。

版本管理功能

每次修改都会记录版本,用户可随时对比和回滚。这一功能确保了提示词工程的可追溯性和可复现性,特别适合团队协作和长期项目。

巨人网络多模态模型:音视频生成技术的突破

巨人网络AI Lab联合清华大学SATLab、西北工业大学推出三项音视频多模态生成技术成果,展示了团队在音视频多模态生成领域的最新进展。

音乐驱动的视频生成

音乐驱动的视频生成模型YingVideo-MV可通过一段音乐和一张人物图像生成高质量的音乐视频片段。这一技术为音乐视频创作提供了全新的可能性,大大降低了创作门槛。

歌声转换技术的实用化

零样本歌声转换模型YingMusic-SVC实现了'真实歌曲可用'的歌声转换能力,有效抑制干扰并降低破音风险。这一突破使得AI歌声转换技术从实验室走向实际应用,为音乐创作和娱乐产业带来新的可能性。

歌声合成与音色克隆

歌声合成模型YingMusic-Singer支持输入任意歌词生成自然歌声,具备零样本音色克隆功能,提升创作灵活性。这些特性使得AI在音乐创作中的应用更加广泛和深入。

AI技术发展的多维趋势分析

通过对近期AI领域多项创新成果的分析,我们可以观察到几个明显的发展趋势,这些趋势正在塑造AI技术的未来方向。

模型轻量化与高效能

从Z-Image的低参数高性能设计,到夸克AI眼镜的硬件优化,AI技术正朝着更加轻量化、高效能的方向发展。这一趋势使得AI技术能够从云端走向边缘,从专业设备走向消费级产品。

多模态融合的深化

巨人网络的多模态模型、Adobe的创意工作流工具等,都展示了AI技术在多模态融合方面的深入发展。AI系统正在打破不同数据类型和感官模态之间的界限,提供更加全面和自然的人机交互体验。

指令工程的重要性凸显

DeepMind的系统指令、YPrompt等工具的出现,反映了AI领域对指令工程的高度重视。如何通过精确的指令引导AI系统完成任务,已成为提升AI性能和可靠性的关键因素。

行业规范与伦理考量

清华大学AI应用指导原则的发布,体现了学术界对AI技术伦理和规范问题的重视。随着AI技术的广泛应用,建立合理的规范和伦理框架,确保技术的健康发展,已成为行业共识。

结论:AI技术生态的多元化发展

从开源模型到智能硬件,从浏览器升级到创意工具,AI技术正在各个领域展现出强大的创新活力。这些突破不仅推动了AI技术本身的进步,也为各行各业带来了新的可能性。

未来,随着技术的不断成熟和应用场景的持续拓展,AI技术将更加深入地融入我们的日常生活和工作方式。在这个过程中,技术创新与规范建设的平衡,效率提升与伦理考量的兼顾,将成为AI技术健康发展的关键因素。

我们有理由相信,在各方共同努力下,AI技术将继续朝着更加智能、更加普惠、更加可靠的方向发展,为人类社会创造更大的价值。