在人工智能领域,随着训练数据、训练计算能力和测试计算能力的不断提升,AI系统的性能边界正在被不断突破。近年来,并行智能体(Parallel Agents)作为一种新兴技术方向,正展现出强大的潜力,能够显著加速AI系统的处理效率,特别是在测试计算能力(Test-time Compute)不断扩展的背景下。

并行智能体的崛起

AI能力的扩展一直遵循着可预测的规律:更多的训练数据、更大的训练计算能力以及更高的测试计算能力。百度前团队和OpenAI的研究都表明,AI模型的性能与数据量和训练计算量之间存在明确的正相关关系。然而,随着推理模型需要思考、反思和迭代答案,以及代理工作流(Workflows)的复杂性增加,这些方法往往需要更长的处理时间。

并行智能体的出现为这一挑战提供了创新解决方案。通过让多个智能体同时工作,我们能够在不显著增加用户等待时间的前提下,大幅提升系统的处理能力和输出质量。这一思路与人类团队协作的方式有着异曲同工之妙——通过分工合作,复杂任务得以更高效地完成。

并行智能体的实际应用

研究智能体的并行化

现代研究智能体已经广泛采用并行处理技术。多个智能体可以同时抓取和分析不同的网页内容,从而更快地整合信息,生成深度研究报告。这种方法显著缩短了传统研究过程中需要逐一处理信息源的时间,同时保持了研究质量。

代码框架中的并行智能体

在代码生成领域,一些先进的代理框架允许用户协调多个智能体同时处理代码库的不同部分。例如,Claude Code等工具展示了如何使用git worktrees等技术实现并行代码开发。这种方法不仅提高了代码生成的效率,还增强了系统的容错能力——当某个智能体遇到困难时,其他智能体可以继续推进工作。

用户界面与后台处理的并行

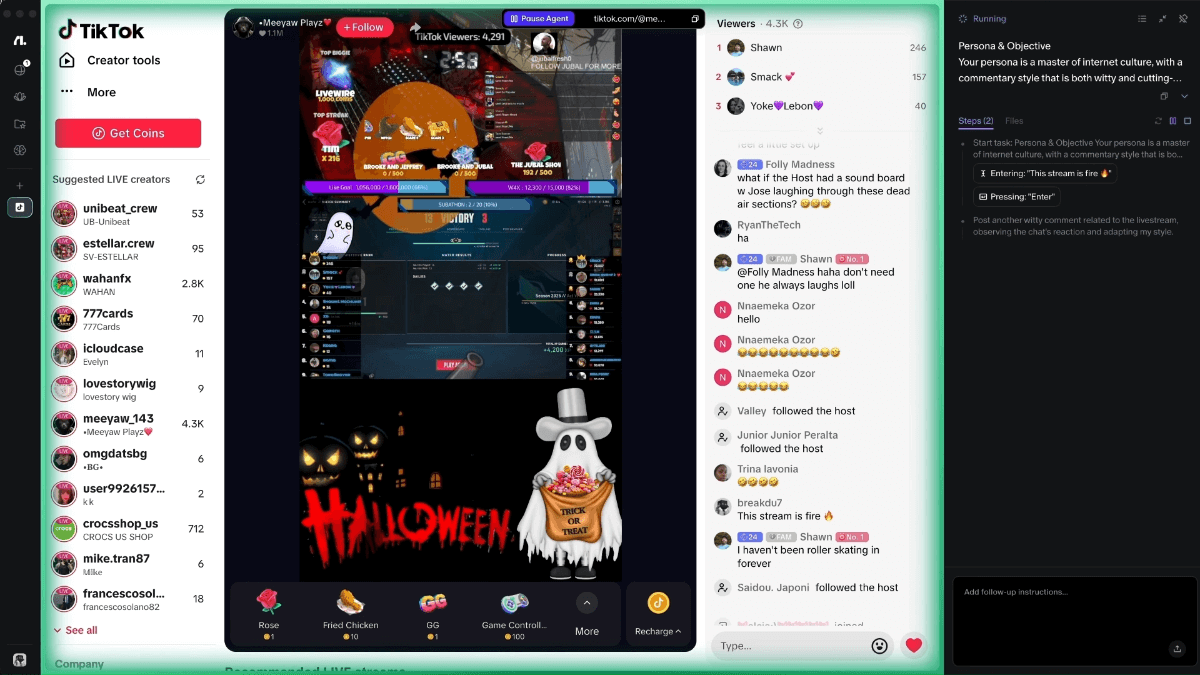

一种日益流行的设计模式是让计算密集型智能体在后台运行,同时由另一个智能体负责监控并向用户提供简短更新。这种设计模式为用户提供了实时反馈,同时保持了系统的响应速度。在此基础上,进一步发展为并行智能体架构,其中UI智能体保持用户知情,同时将异步用户反馈路由给其他智能体。

任务分解与并行处理的挑战

将复杂任务分解为适合并行处理的小任务,是并行智能体面临的主要挑战之一。对于人类管理者而言,将构建复杂软件应用这样的任务分解给多个工程师并行工作已经相当困难;扩展到大量工程师时,挑战更为显著。同样,为并行智能体分解任务也面临着类似的挑战。

然而,随着LLM推理成本的持续下降,使用更多token进行并行处理的成本效益正在不断提高。这种成本优势使得即使需要大量智能体并行工作,也不会显著增加用户的等待时间,从而使得并行智能体架构变得切实可行。

并行智能体的研究进展

学术界和工业界正在积极探索并行智能体的最佳实现方式。Ryan Ehrlich等人发表的"CodeMonkeys: Scaling Test-Time Compute for Software Engineering"展示了并行代码生成如何帮助探索解决方案空间。这种方法通过同时生成多个代码版本,然后从中选择最优方案,显著提高了代码生成的质量和效率。

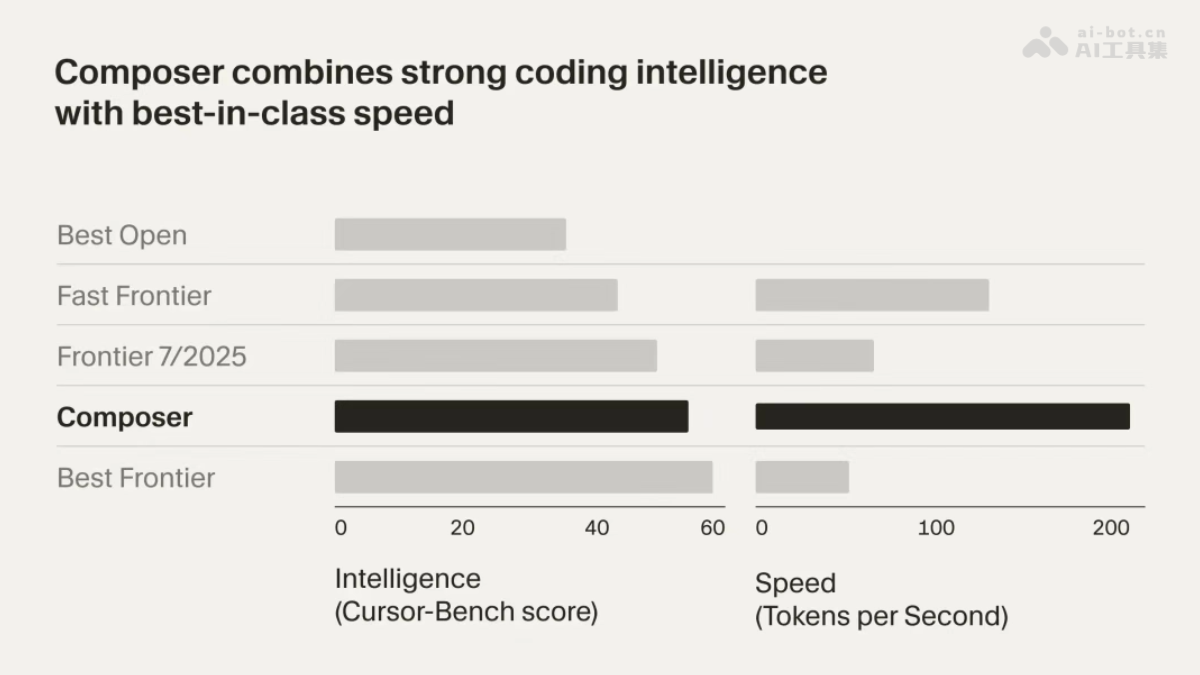

Junlin Wang提出的"混合智能体(Mixture-of-Agents)"架构是一种组织并行智能体的创新方法:让多个LLM提出不同答案,然后由一个聚合LLM将这些答案合并为最终输出。这种方法不仅简单有效,还展示了并行智能体在保持多样性的同时整合知识的能力。

并行智能体的未来展望

并行智能体领域仍有大量研究和工程探索空间。我相信,能够高效并行工作的智能体数量——就像能够高效并行工作的人类一样——将会非常高。随着技术的不断成熟,我们可能会看到数百甚至数千个智能体协同工作的场景,这将彻底改变AI系统的处理能力和应用范围。

智能体协调的进化

未来的智能体系统将需要更复杂的协调机制,以管理大量并行智能体之间的交互。这可能包括:

- 智能体间的通信协议

- 任务分配和负载平衡算法

- 结果整合和质量控制机制

- 冲突解决和一致性保障

行业应用的扩展

随着并行智能体技术的成熟,其应用范围将从当前的代码生成、研究分析等领域扩展到更多行业:

- 医疗诊断:多个智能体同时分析不同医疗数据

- 金融分析:并行处理市场数据和预测模型

- 创意设计:协同生成和评估创意方案

- 科学研究:加速复杂科学问题的解决

结论

并行智能体代表了AI系统架构的一次重要演进,它通过利用测试计算能力的扩展,在不增加用户等待时间的前提下,显著提升了AI系统的性能和效率。随着LLM推理成本的持续下降和智能体协调技术的不断进步,我们正迎来一个AI系统能够以前所未有的速度和规模处理复杂问题的时代。

这一技术演进不仅将改变AI系统的内部架构,还将重塑人机交互的方式,为用户提供更加流畅、高效的体验。在未来的几年里,我们可能会看到并行智能体技术在各个领域的广泛应用,推动AI能力的边界不断扩展。