人工智能领域正在经历一场静默的革命——并行智能体的崛起。随着AI能力的不断提升,研究人员和工程师们正在探索新的方法来扩展和优化AI系统的性能。并行智能体技术,作为这一探索的前沿方向,正在为AI系统带来前所未有的加速效果。

并行智能体的基本概念

并行智能体是指多个AI代理同时工作以完成任务的架构设计。这一技术理念源于对AI扩展规律的深入研究。我们知道,AI模型的性能随着训练数据量和计算资源的增加而提升,而测试时计算(test-time compute)的引入进一步增强了AI的能力。

然而,传统的推理模型和代理工作流大多是顺序执行的,这导致处理复杂任务时需要较长时间。并行智能体技术通过让多个智能体同时工作,在保持用户等待时间可控的前提下,显著提升了AI系统的处理能力和效率。

理论基础:扩展定律与并行化

百度前团队和OpenAI的研究为并行智能体的发展奠定了理论基础。研究表明,AI模型的性能与数据量和训练计算量之间存在可预测的扩展关系。随着大语言模型每token成本的持续下降,曾经因计算成本过高而难以实现的并行化技术,如今已变得切实可行。

扩展定律告诉我们,增加计算资源可以提升AI性能,但如何高效利用这些资源成为关键。并行智能体提供了一种解决方案:通过将复杂任务分解为多个子任务,由不同智能体同时处理,然后在结果层面进行整合,从而实现整体性能的提升。

并行智能体的实际应用

研究智能体

现代研究智能体已经广泛采用并行处理技术。许多智能体能够同时获取并分析多个网页内容,从而快速合成深度研究报告。这种方法大大缩短了信息收集和分析的时间,使研究人员能够更快地获得洞察。

代码生成框架

在软件开发领域,一些智能体编码框架允许用户编排多个智能体同时处理代码库的不同部分。例如,通过使用git worktrees等技术,开发团队可以并行推进多个功能的开发,显著提高开发效率。

设计模式创新

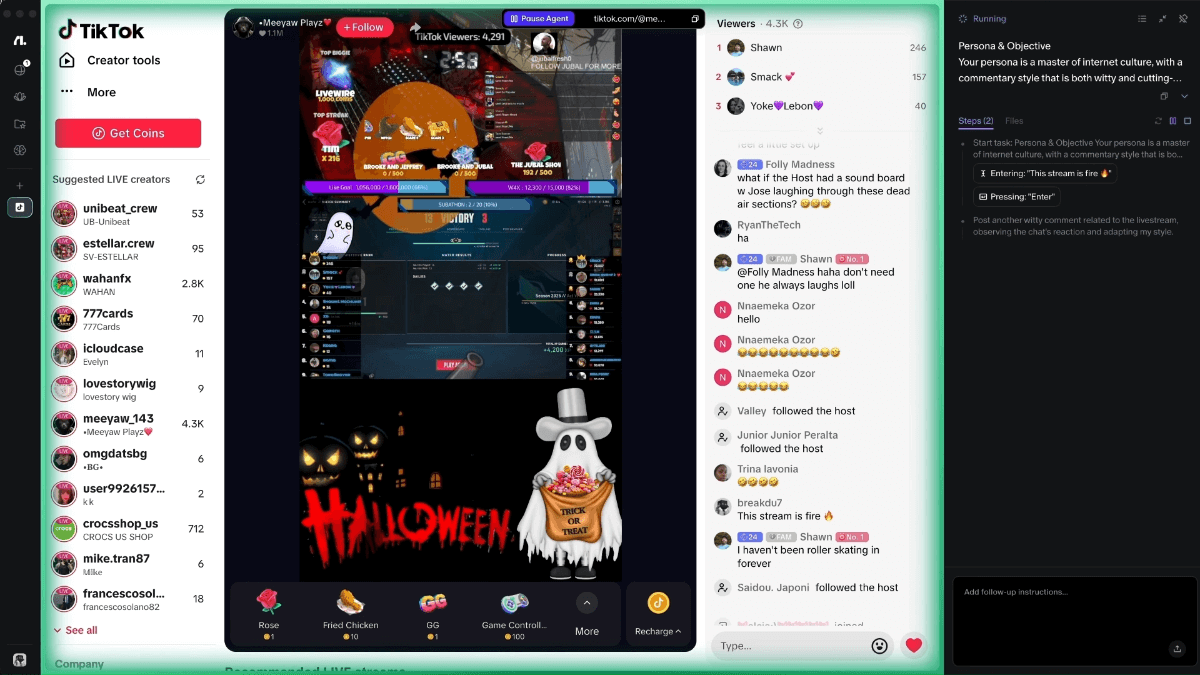

一种新兴的设计模式是让计算密集型智能体在后台运行数分钟完成任务,同时由另一个智能体监控进展并向用户提供简短更新。这种模式进一步发展为并行智能体架构,其中UI智能体保持用户知情,同时可能将异步用户反馈路由给其他智能体。

技术挑战与解决方案

任务分解难题

将复杂任务分解为适合并行处理的子任务,是并行智能体面临的主要挑战之一。这与人类项目经理将复杂项目分解给工程师团队面临的挑战类似。随着工程师数量增加,协调和管理变得更加困难。

然而,LLM推理成本的下降使得使用更多token进行任务分解变得可行。通过智能体并行处理,可以在不显著增加用户等待时间的情况下,充分利用计算资源。

研究进展

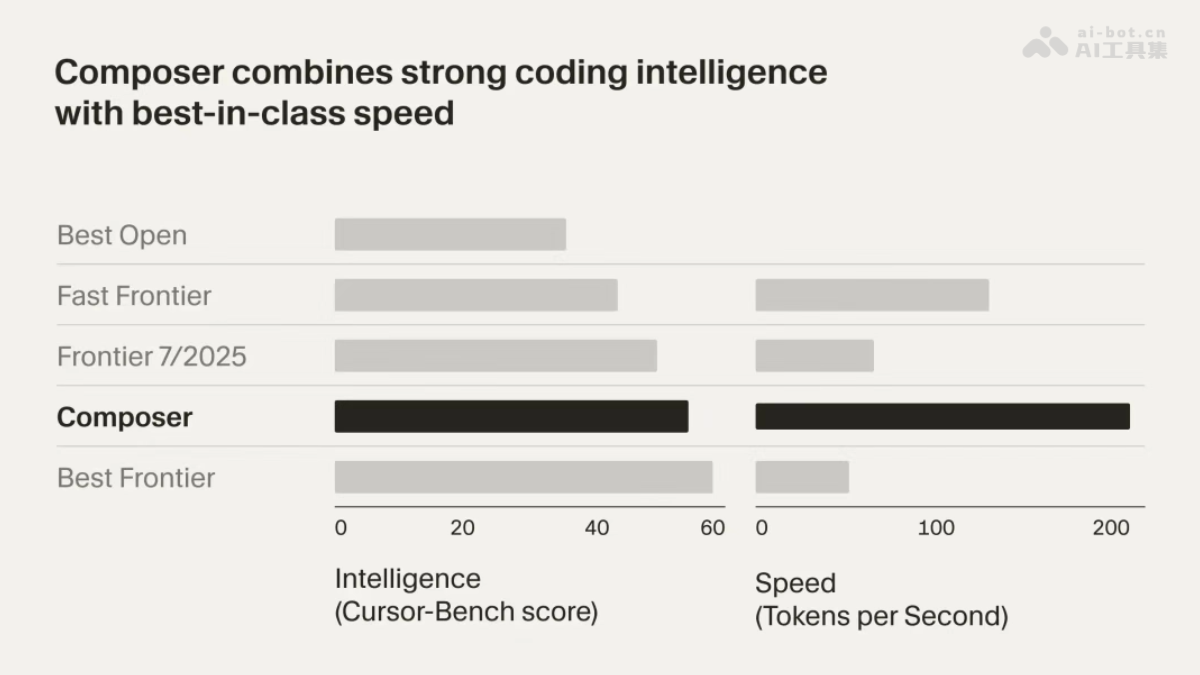

学术界对并行智能体的研究正在快速发展。例如,Ryan Ehrlich等人发表的《CodeMonkeys: Scaling Test-Time Compute for Software Engineering》展示了并行代码生成如何帮助探索解决方案空间。Junlin Wang提出的"混合智能体"(mixture-of-agents)架构则提供了一种组织并行智能体的简单方法:让多个LLM提出不同答案,然后由聚合器LLM将它们合并为最终输出。

未来展望

并行智能体领域仍有大量研究和工程工作需要探索。如何最佳地利用并行智能体,以及能够有效并行工作的智能体数量上限,都是值得深入研究的问题。

可以预见,随着技术的不断成熟,并行智能体将在更多领域展现其价值。从内容创作到软件开发,从数据分析到决策支持,并行智能体将为AI系统带来质的飞跃。

结论

并行智能体代表了AI系统扩展的新方向,它通过让多个智能体同时工作,在保持响应速度的同时提升了处理复杂任务的能力。随着大语言模型成本的持续下降和技术的不断成熟,并行智能体有望在未来几年内重塑AI系统的架构和性能边界。

这一技术不仅为AI性能提升提供了新思路,也为解决计算资源分配和任务分解等传统难题提供了创新方案。随着研究的深入和应用的扩展,并行智能体将成为推动AI技术发展的重要力量。