在人工智能快速发展的今天,AI代理能够处理的任务复杂度和规模正在以前所未有的速度增长。然而,一个长期困扰开发者的技术瓶颈始终存在:上下文窗口限制。随着生产环境中的AI代理需要处理更复杂的任务并生成更多的工具结果,它们经常耗尽有效的上下文窗口,迫使开发者在截断代理对话记录或降低性能之间做出艰难选择。Anthropic最新推出的上下文编辑功能和记忆工具,正从根本上解决这一挑战,为AI代理的长任务处理能力带来革命性突破。

上下文窗口的局限与真实需求的矛盾

现代AI系统面临一个根本性矛盾:上下文窗口有物理限制,但真实世界的任务却没有。当生产环境中的AI代理处理日益复杂的任务时,它们会迅速积累工具调用结果、对话历史和中间数据,这些内容很容易超过预设的上下文限制。传统的解决方案往往需要在以下两难选择中权衡:

- 截断对话记录:删除早期的重要信息,可能导致AI失去对任务全貌的理解

- 降低性能:保留所有信息但让模型处理过长的上下文,导致响应速度和准确性下降

Anthropic的上下文管理技术通过两种创新方式解决了这一困境,帮助开发者确保只有相关数据保持在上下文中,同时将宝贵的洞察力跨会话保存。

上下文编辑:智能清理与性能提升

上下文编辑功能是Anthropic推出的首个突破性技术。当AI代理接近令牌限制时,该功能会自动从上下文窗口中清除过时的工具调用和结果。这一看似简单的创新实际上解决了多个关键问题:

工作原理

随着AI代理执行任务并积累工具结果,上下文编辑会智能地移除陈旧内容,同时保持对话流的连贯性。这种机制有效延长了代理无需人工干预就能运行的时间,显著提高了AI代理的实际工作能力。

性能优势

上下文编辑不仅解决了令牌限制问题,还带来了额外的性能提升。通过让Claude专注于相关上下文,模型能够更有效地分配计算资源,提高响应质量和准确性。在内部测试中,仅使用上下文编辑就带来了29%的性能提升。

实际应用场景

- 长对话会话:维持客户服务或咨询类AI代理的长时间对话,无需担心上下文溢出

- 复杂任务处理:在需要多步骤推理的任务中,保持关键信息可用

- 实时数据处理:处理持续流入的数据流,同时保留关键洞察

记忆工具:突破上下文限制的外部存储系统

如果说上下文编辑是优化现有资源的创新,那么记忆工具则是彻底突破了上下文物理限制的革命性技术。该功能使Claude能够通过基于文件的系统在上下文窗口之外存储和查询信息。

核心功能

记忆工具允许Claude在您基础设施中专用内存目录中创建、读取、更新和删除文件,这些文件在会话之间保持持久化。这意味着AI代理能够:

- 随时间构建知识库:将学习到的信息保存,不断积累专业知识

- 维护跨会话的项目状态:在不同对话之间保持项目进度和上下文

- 参考先前学习:无需将所有信息都保持在上下文中即可利用历史经验

技术实现

记忆工具完全通过工具调用在客户端运行,开发者可以完全控制存储后端,决定数据的存储位置和持久化方式。这种设计既保证了灵活性,又确保了数据安全性和隐私保护。

与上下文编辑的协同效应

记忆工具与上下文编辑形成了完美的互补关系:

- 记忆工具负责保存长期重要的信息

- 上下文编辑负责清理临时和过时的数据

这种协同工作模式使AI系统能够同时处理短期任务需求和长期知识积累,实现了真正的"记忆"与"思考"分离。

Claude Sonnet 4.5:上下文感知的智能升级

Claude Sonnet 4.5作为Anthropic最新的旗舰模型,不仅本身在AI代理构建方面表现卓越,还通过内置的上下文感知能力显著增强了上下文编辑和记忆工具的效果。这一先进特性使Claude能够在整个对话过程中持续跟踪可用令牌,从而更有效地管理上下文。

上下文感知的工作机制

Claude Sonnet 4.5内置的上下文感知系统实现了以下功能:

- 实时令牌监控:持续跟踪上下文中的令牌使用情况

- 智能内容评估:判断不同内容的重要性级别

- 前瞻性规划:预测未来可能的令牌需求,提前优化上下文分配

性能提升数据

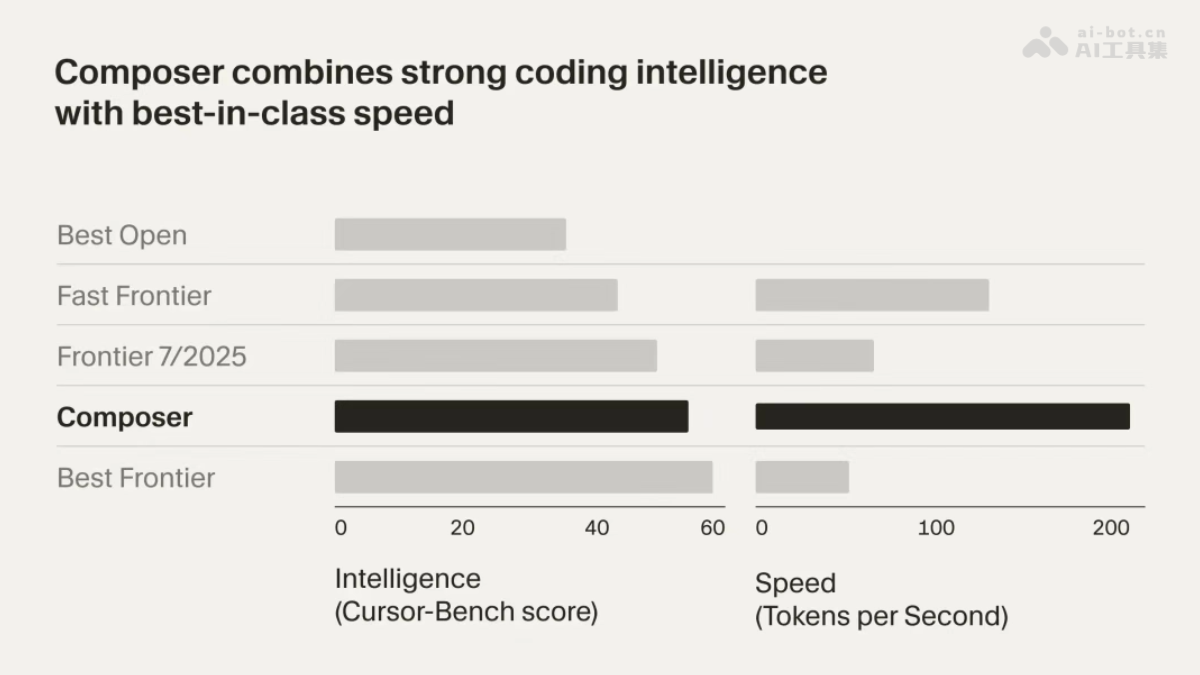

在内部评估测试中,结合使用记忆工具和上下文编辑相比基准测试带来了显著的性能提升:

- 组合使用:39%的性能提升

- 仅上下文编辑:29%的性能提升

在100轮网络搜索评估中,上下文编辑使AI代理能够完成原本会因上下文耗尽而失败的工作流程,同时将令牌消耗减少了84%。

构建长期运行的AI代理

上下文管理技术的推出为构建长期运行的AI代理开辟了全新可能性。这些代理现在可以处理整个代码库、分析数百个文档,或维护广泛的工具交互历史,而不会遇到上下文限制的阻碍。

编码应用场景

在软件开发领域,上下文管理技术解决了AI辅助编程的核心痛点:

- 上下文编辑:自动清除旧的文件读取和测试结果,保持上下文相关

- 记忆工具:保存调试洞察和架构决策,构建项目知识库

这种组合使AI代理能够在大型代码库上工作而不会失去进度,显著提高了开发效率。例如,一个AI助手可以在多次会话中学习特定代码库的结构和约定,然后在后续会话中利用这些知识提供更准确的代码建议。

研究应用场景

在研究分析领域,上下文管理技术使AI能够构建和利用日益增长的知识库:

- 记忆工具:存储关键发现和见解,建立研究领域专业知识

- 上下文编辑:移除过时的搜索结果,保持上下文相关性

这种机制使研究AI能够随时间积累专业知识,在后续研究中提供更深入的见解。例如,一个研究AI可以在分析数十篇论文后,将关键发现和模式存储到记忆中,然后在面对新问题时能够快速调用这些相关知识。

数据处理应用场景

在数据处理工作流中,上下文管理技术使AI能够处理大规模数据集:

- 记忆工具:存储中间结果和计算状态

- 上下文编辑:清理原始数据,保留处理后的关键信息

这种能力使AI代理能够处理原本会因令牌限制而失败的数据处理工作流。例如,一个数据分析AI可以处理数GB的日志文件,将关键指标和模式存储到记忆中,同时保持上下文专注于当前分析任务。

实施指南:开始使用上下文管理功能

上下文编辑和记忆工具已在Claude开发者平台、Amazon Bedrock和Google Cloud的Vertex AI上以公开测试版形式提供。以下是开始使用这些功能的实用指南。

技术要求

- Claude Sonnet 4.5或更高版本

- 支持工具调用的开发环境

- 用于记忆工具的存储后端(文件系统、数据库等)

初始设置步骤

- 配置上下文编辑:在代理配置中启用上下文编辑功能,设置适当的令牌阈值

- 设置记忆工具:配置记忆工具的存储后端,定义持久化策略

- 集成到现有工作流:将上下文管理功能集成到AI代理的决策逻辑中

最佳实践

- 合理设置令牌阈值:根据任务复杂度调整上下文编辑的触发点

- 设计记忆结构:为记忆工具设计高效的信息组织和检索系统

- 监控性能指标:跟踪上下文管理对AI代理性能的实际影响

- 迭代优化:根据实际使用情况不断调整上下文管理策略

未来展望:AI上下文管理的演进方向

上下文管理技术的推出只是AI系统架构演进的第一步。随着这些技术的成熟和普及,我们可以预见几个重要的发展方向:

更智能的上下文筛选

未来的上下文管理系统将采用更先进的算法来评估信息的重要性,不仅基于简单的时效性,还会考虑语义相关性、任务关联性和历史价值等多维度因素。

跨模态记忆整合

记忆工具将扩展到处理不同类型的数据,包括文本、图像、音频和视频等,使AI代理能够构建更全面和多模态的知识表示。

分布式上下文管理

随着AI系统规模的扩大,上下文管理将向分布式架构发展,使多个AI代理能够共享和协同管理上下文资源,实现更复杂的多代理协作场景。

自适应上下文策略

未来的AI系统将能够根据任务类型和复杂度自动调整上下文管理策略,实现真正的自适应智能。

结论

Anthropic推出的上下文编辑和记忆工具代表了AI系统架构的重要进步,这些技术不仅解决了上下文限制这一长期存在的痛点,还为AI代理的长任务处理能力开辟了全新可能性。通过智能管理上下文内容和建立持久化记忆系统,AI代理现在能够处理更复杂的任务、维持更长的会话,并在多次交互中积累和利用知识。

随着这些技术的成熟和普及,我们可以预见AI代理将在更多领域发挥关键作用,从软件开发到科学研究,从客户服务到数据分析。开发者现在有机会利用这些突破性技术构建更强大、更可靠的AI系统,推动人工智能在实际应用中的边界不断扩展。

Claude Sonnet 4.5及其上下文管理功能不仅展示了当前AI技术的可能性,也为未来的AI系统设计指明了方向。在这个AI能力快速发展的时代,理解并有效利用这些先进技术,将成为开发者和组织保持竞争优势的关键因素。