在人工智能领域,模型大小与性能之间的平衡一直是开发者面临的重大挑战。然而,Anthropic最新发布的Claude Haiku 4.5模型彻底颠覆了这一传统认知,展示了AI技术发展的全新可能性。这款小型AI语言模型不仅实现了与五个月前发布的顶级Claude Sonnet 4相近的性能表现,更将运行成本降低至三分之一,同时处理速度提升了超过两倍。这一突破性进展标志着AI模型设计理念的重要转变,从单纯追求规模转向更加注重效率与实用性的平衡。

小身材大能量:Haiku 4.5的技术突破

Claude Haiku 4.5的发布代表了AI模型蒸馏技术的一次重大成功。通过这种先进技术,Anthropic能够将大型神经网络的知识和能力"蒸馏"到更小规模的模型中,使其在特定任务上保持与大型模型相近的性能水平。这一过程类似于将一杯浓咖啡的精华提取出来,制成一小瓶浓缩咖啡液——虽然体积减小,但咖啡因含量和风味依然浓郁。

Claude 4.5 Haiku基准测试结果

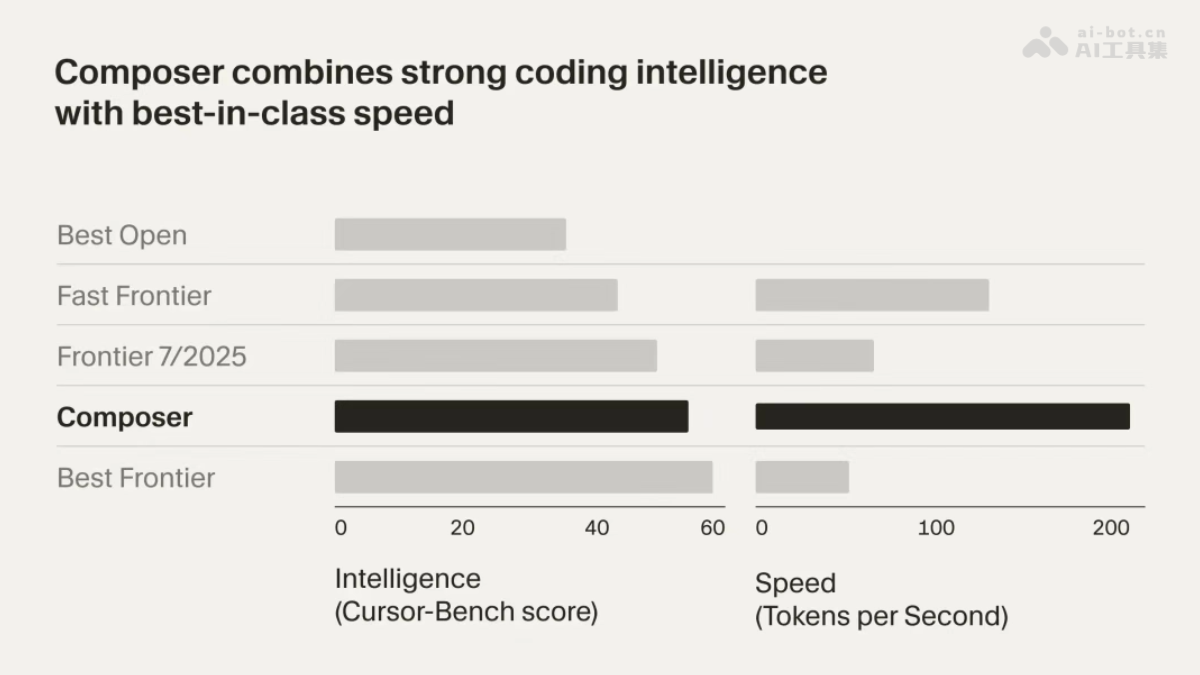

在关键的编程能力测试SWE-bench Verified中,Haiku 4.5取得了73.3%的得分,与Sonnet 4的72.7%表现相当。这一结果令人震惊,因为它表明一个规模更小的模型可以在复杂的编程任务上与顶级模型相媲美。更令人印象深刻的是,Haiku 4.5在某些特定任务上甚至超越了Sonnet 4,例如使用计算机进行操作的能力。这些测试结果表明,通过精心设计的蒸馏过程,小型模型完全可以保留大型模型的核心能力。

成本与效率的双重优势

Haiku 4.5不仅在性能上表现出色,其经济性更是令人瞩目。通过API使用,这款小型模型的定价为每百万输入token 1美元,每百万输出token 5美元。相比之下,Sonnet 4.5的定价分别为每百万输入token 3美元和每百万输出token 15美元,而Opus 4.1的定价则高达每百万输入token 15美元和每百万输出token 75美元。

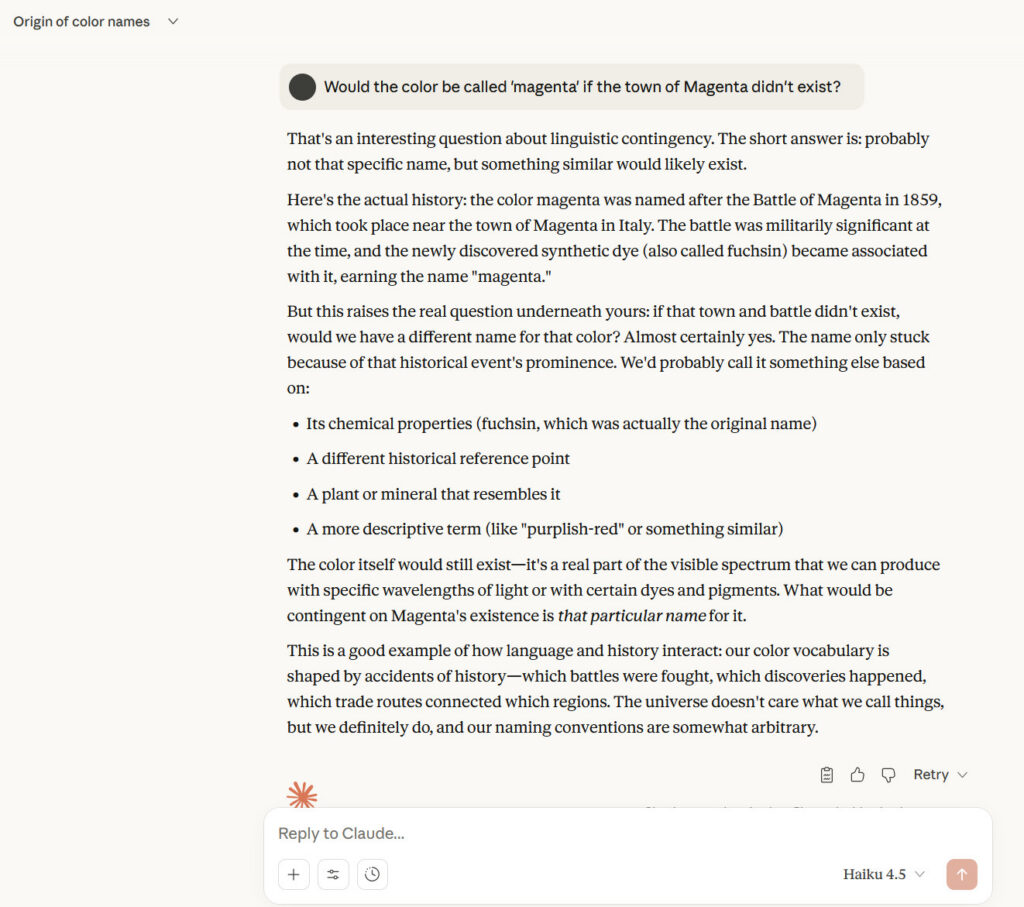

Claude 4.5 Haiku回答了Ars Technica的经典AI问题

这种成本优势对于大规模部署AI应用的企业来说具有重大意义。想象一下,一个需要处理数百万用户请求的客服系统,使用Haiku 4.5而非更昂贵的模型,可以节省大量运营成本,同时保持相近的服务质量。对于初创公司和资源有限的开发者而言,这种高性价比的AI工具无疑降低了技术门槛,使更多创新成为可能。

多模型协同工作的新范式

Anthropic在设计Haiku 4.5时,充分考虑了其在多模型工作流中的角色。这款模型并非要完全取代大型模型,而是作为大型模型的补充和加速器。在Anthropic设想的理想工作流中,Sonnet 4.5这样的前沿模型负责分析和分解复杂问题,制定多步骤计划,然后协调多个Haiku 4.5实例并行处理子任务。

这种分工协作模式类似于一个项目管理团队:项目经理(Sonnet)负责整体规划和决策,而多个执行人员(Haiku)则并行处理具体任务。通过这种方式,系统可以充分利用大型模型的推理能力和小型模型的高效执行能力,实现整体性能的最大化。这种架构特别适合需要实时响应的应用场景,如聊天助手、客户服务代理或结对编程环境。

实际应用场景分析

Haiku 4.5的高效性能使其在多种应用场景中展现出独特优势。对于需要快速响应的实时应用,如聊天机器人和客户服务系统,Haiku 4.5的速度优势可以显著提升用户体验。想象一下,一个智能客服系统能够在用户输入问题后立即提供相关答案,而不需要用户等待数秒钟,这种即时响应能力可以大大提高用户满意度。

在软件开发领域,Haiku 4.5可以作为编程助手的理想选择。对于需要频繁进行代码转换、语法检查或简单编程任务的开发者来说,这款模型能够提供快速、准确的协助,而不会因为等待模型响应而打断工作流程。特别是在结对编程环境中,Haiku 4.5可以作为实时代码审查伙伴,帮助开发者发现潜在问题并提供改进建议。

对于需要处理大量简单查询的企业应用,如数据分析或文档处理,Haiku 4.5的经济性优势尤为明显。企业可以部署大量Haiku 4.5实例来并行处理任务,而无需承担大型模型的高昂成本。这种"规模化效率"的思路正在改变企业对AI资源分配的认知,推动AI应用从"少而精"向"多而快"转变。

技术原理深度解析

Haiku 4.5的成功背后,是AI模型蒸馏技术的精妙应用。蒸馏过程本质上是一种知识迁移方法,通过训练小型模型模仿大型模型的输入-输出行为,将大型模型的知识"压缩"到小型模型中。这一过程通常包括两个关键阶段:预训练和蒸馏。

在预训练阶段,大型模型(如教师模型)在大量数据上进行训练,学习广泛的模式和知识。然后,在蒸馏阶段,小型模型(如学生模型)不仅学习原始训练数据,还学习模仿教师模型的输出行为。通过这种方式,学生模型能够捕捉到教师模型的"决策过程",而不仅仅是表面的知识。

Anthropic在Haiku 4.5的蒸馏过程中可能采用了多种先进技术,如知识蒸馏、注意力蒸馏和参数共享等。这些技术共同作用,使得小型模型能够在保持性能的同时显著减少计算资源需求。特别是注意力蒸馏技术,能够让学生模型学习教师模型的注意力机制,理解哪些输入部分对输出最重要,从而更有效地分配计算资源。

行业影响与未来展望

Haiku 4.5的发布对AI行业产生了深远影响。首先,它证明了AI模型的发展方向正从单纯追求规模转向更加注重效率和实用性。这一趋势可能会促使更多AI公司重新思考模型设计策略,将更多资源投入到模型优化和效率提升上,而非仅仅扩大模型规模。

其次,Haiku 4.5展示了多模型协同工作流的巨大潜力。未来,我们可能会看到更加复杂的AI系统架构,其中不同规模和能力的模型各司其职,协同完成复杂任务。这种"模块化AI"的设计思路可能会成为行业标准,推动AI应用向更加灵活、高效的方向发展。

从长远来看,小型高效模型的普及可能会加速AI技术的民主化。当AI工具变得更加经济实惠和易于使用时,更多开发者和企业将能够利用AI技术解决实际问题,推动创新和经济增长。这种"AI平民化"的趋势可能会催生全新的应用场景和商业模式,进一步拓展AI技术的边界。

挑战与局限性

尽管Haiku 4.5取得了令人瞩目的成就,但它仍然存在一些局限性和挑战。首先,与大型模型相比,Haiku 4.5在需要广泛知识储备的任务上可能表现不佳。例如,在需要深入理解特定领域知识或进行复杂推理的任务中,大型模型如Sonnet或Opus可能仍然更具优势。

其次,蒸馏过程可能会导致模型失去一些细微但重要的能力。大型模型通常具有更好的泛化能力和创造性思维,而小型模型可能在处理全新或非常规任务时表现不佳。因此,在选择使用哪种模型时,开发者需要根据具体应用场景进行权衡。

最后,虽然Anthropic发布的基准测试结果令人印象深刻,但这些数据仍需经过独立验证才能确认其可靠性。在实际应用中,模型性能可能会因使用场景、数据分布和评估方法的不同而有所差异。因此,开发者在采用Haiku 4.5时,仍应进行充分的测试和评估。

结论:AI模型设计的新时代

Claude Haiku 4.5的发布标志着AI模型设计进入了一个新时代,一个更加注重效率、实用性和经济性的时代。通过蒸馏技术和其他优化方法,Anthropic成功打破了"模型大小决定性能"的传统观念,证明了小型模型完全可以实现与大型模型相近的性能水平。

这一突破不仅为企业提供了更具成本效益的AI解决方案,也为整个行业指明了发展方向。未来,我们可能会看到更多类似Haiku 4.5的高效模型出现,它们将在各自的领域发挥重要作用,推动AI技术的广泛应用和创新。

对于开发者而言,Haiku 4.5的出现意味着更多的选择和可能性。根据具体应用场景和需求,开发者可以灵活选择不同规模和能力的模型,构建更加高效、经济的AI系统。这种灵活性和选择性将进一步促进AI技术的创新和应用,为人类社会带来更多价值和便利。

随着AI技术的不断发展,我们有理由相信,模型效率与性能的平衡将越来越精细,AI系统将变得更加智能、高效和普及。Claude Haiku 4.5只是这一变革的开始,未来还有更多令人期待的技术突破和应用创新等待我们去探索和实现。