在人工智能领域,腾讯混元最近宣布了一项引人瞩目的模型矩阵全面升级计划,这无疑标志着其在AI技术上的又一次重大飞跃。此次升级不仅是对现有模型的优化,更是推出了全新的视觉推理模型T1-Vision和语音通话模型混元Voice,进一步丰富了其AI产品线。

旗舰快思考模型混元TurboS和深度思考模型混元T1的升级,以及基于TurboS基座打造的T1-Vision和混元Voice的推出,都显示出腾讯在多模态AI技术上的雄心。与此同时,腾讯混元图像2.0、腾讯混元3D v2.5及混元游戏视觉生成等一系列多模态模型也同步进行了更新,这一系列动作无疑将增强腾讯在AI领域的竞争力,并推动多模态技术的进一步发展。

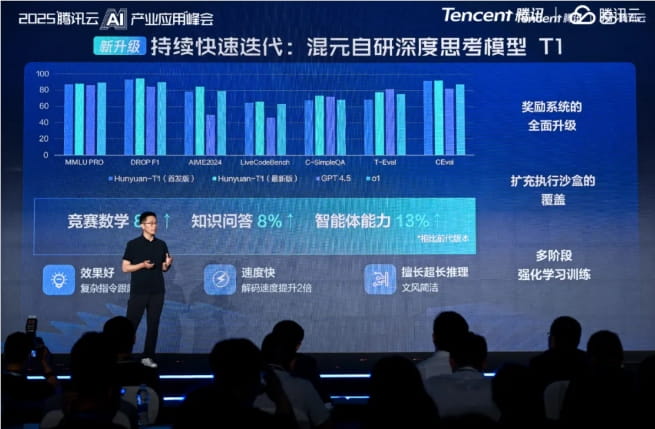

在2025腾讯云AI产业应用峰会上,腾讯集团高级执行副总裁汤道生透露,混元TurboS模型已在全球公认的Chatbot Arena评测平台上名列前茅,跻身前八,成为国内仅次于DeepSeek的优秀模型。尤其值得一提的是,TurboS在代码和数学等理科领域的强大能力使其在全球范围内也位居前十。这一成就的取得,得益于其创新的预训练和后训练技术,使得理科推理能力显著提升了超过10%。

另一款深度思考模型T1也在不断迭代更新。最近的升级显著提升了T1在竞赛数学和常识问答等多个领域的能力,其中竞赛数学成绩提升了8%,复杂任务的Agent能力提升了13%。这些持续的技术进步充分体现了腾讯在AI领域的坚定投入和创新精神。

新发布的T1-Vision模型,其独特之处在于具备原生长思维链,并支持多图输入。这一设计使得模型在理解图像时更加高效,整体效果比之前的级联方案提高了5.3%,理解速度也提升了50%。这种原生思维链的引入,让模型能够更自然地模拟人类的思考过程,从而在视觉推理任务中表现出更强的能力。

混元Voice模型则专注于实现低延迟的语音通话。通过优化算法和网络传输,新版模型的响应速度提高了30%,将延迟降低至1.6秒。这对于实时语音交流应用来说至关重要,能够显著提升用户体验。

在多模态生成方面,混元图像2.0凭借其超高的准确率和快速的生成能力,在行业内处于领先地位。它能够满足用户对实时交互体验的需求,让用户能够即时看到AI生成的结果,极大地提升了创作效率。同时,混元3D v2.5模型在生成能力和可控性方面也取得了显著突破,使其在多个生成类目中表现出色。

为了更好地服务于各行各业,腾讯混元还计划推出大规模可漫游的3D场景生成模型,以助力游戏、智能等行业的创新。这种模型能够创建出高度逼真的虚拟环境,为用户提供沉浸式的体验,具有广泛的应用前景。同时,腾讯混元还积极致力于开源技术的推进,已实现图像、视频、3D等全模态的开源,并为参与的合作伙伴提供免费的模型资源和技术支持。这一举措将有助于推动整个AI生态系统的发展。

腾讯混元模型矩阵升级的技术细节分析

腾讯混元此次模型矩阵的全面升级,不仅仅是简单的性能提升,更是在多个关键技术方向上的创新突破。下面,我们将深入分析这些技术细节,以便更好地理解腾讯混元的技术实力。

- TurboS模型的理科推理能力提升

TurboS模型在理科推理能力方面的提升,主要归功于其创新的预训练和后训练技术。预训练阶段,模型通过海量的数据学习通用的知识表示,而后训练阶段则专注于提升模型在特定领域的性能。具体来说,腾讯混元采用了以下策略:

- Curriculum Learning(课程学习):模型首先学习简单的理科知识,然后逐步过渡到复杂的知识。这种循序渐进的学习方式有助于模型更好地掌握理科概念。

- Adversarial Training(对抗训练):通过引入对抗样本,增强模型的鲁棒性和泛化能力。这种训练方式可以有效地防止模型过拟合。

- Knowledge Distillation(知识蒸馏):将大型模型的知识迁移到小型模型中,从而提升小型模型的性能。这种技术可以有效地降低模型的计算复杂度。

- T1模型的Agent能力提升

T1模型在Agent能力方面的提升,主要得益于其对复杂任务的处理能力的增强。具体来说,腾讯混元采用了以下技术:

- Reinforcement Learning(强化学习):通过与环境的交互,学习最优的策略。这种技术可以有效地提升模型在复杂任务中的表现。

- Hierarchical Reinforcement Learning(分层强化学习):将复杂任务分解为多个子任务,然后分别学习每个子任务的策略。这种技术可以有效地降低学习的难度。

- Memory Networks(记忆网络):通过引入外部记忆,增强模型对历史信息的利用能力。这种技术可以有效地提升模型在长期任务中的表现。

- T1-Vision模型的原生思维链

T1-Vision模型的原生思维链是其最大的亮点之一。传统的视觉推理模型通常采用级联的方式,即将多个模型串联起来完成任务。这种方式存在一些问题,例如:

- 误差累积:每个模型都可能产生误差,这些误差会逐级累积,最终导致整体性能下降。

- 效率低下:每个模型都需要单独运行,导致整体效率低下。

T1-Vision模型通过引入原生思维链,可以有效地解决这些问题。原生思维链是指模型在内部模拟人类的思考过程,逐步推理出答案。具体来说,T1-Vision模型采用了以下技术:

- Graph Neural Networks(图神经网络):将图像表示为图结构,然后利用图神经网络进行推理。这种技术可以有效地捕捉图像中的关系信息。

- Attention Mechanism(注意力机制):让模型能够关注图像中的关键区域。这种技术可以有效地提升模型的推理能力。

- Symbolic Reasoning(符号推理):将图像中的信息转换为符号表示,然后利用符号推理规则进行推理。这种技术可以有效地提升模型的逻辑推理能力。

- 混元Voice模型的低延迟语音通话

混元Voice模型在低延迟语音通话方面的突破,主要归功于其对语音编码和网络传输的优化。具体来说,腾讯混元采用了以下技术:

- Low-Latency Codec(低延迟编解码器):采用高效的语音编解码算法,降低语音传输的延迟。

- Network Optimization(网络优化):优化网络传输协议,减少网络拥塞和丢包。

- Error Correction(纠错):采用前向纠错技术,减少语音传输中的错误。

通过这些技术,混元Voice模型能够实现1.6秒的低延迟语音通话,为用户提供流畅的语音交流体验。

腾讯混元模型矩阵升级的行业影响

腾讯混元此次模型矩阵的全面升级,无疑将对AI行业产生深远的影响。具体来说,其影响主要体现在以下几个方面:

- 推动多模态AI技术的发展

腾讯混元在多模态AI技术方面的投入和创新,将推动整个行业的发展。通过开源多模态模型,腾讯混元将为其他企业和研究机构提供宝贵的资源和技术支持,促进多模态AI技术的普及和应用。

- 加速AI在各行业的应用

腾讯混元的模型矩阵升级,将加速AI在各行业的应用。例如,T1-Vision模型可以应用于智能安防、自动驾驶等领域;混元Voice模型可以应用于智能客服、语音助手等领域;混元3D v2.5模型可以应用于游戏开发、虚拟现实等领域。

- 提升用户体验

腾讯混元的模型矩阵升级,将显著提升用户体验。例如,低延迟的语音通话可以提供更流畅的语音交流体验;高准确率的图像生成可以提供更逼真的视觉效果;智能的Agent可以提供更便捷的服务。

总而言之,腾讯混元此次模型矩阵的全面升级,是其在AI领域的一次重大突破。通过不断的技术创新和开源合作,腾讯混元将为AI行业的发展做出更大的贡献。