在数字内容创作领域,动画生成技术正迎来一场深刻的变革。由中国科学院深圳先进技术研究院计算机视觉与模式识别实验室、中国电信人工智能研究所等机构联合推出的MTVCrafter框架,无疑是这场变革中的一颗耀眼新星。它不仅代表着人像动画生成技术的新高度,也预示着未来数字内容创作的无限可能。

MTVCrafter:技术原理与创新

MTVCrafter的核心在于其独特的4D运动标记化(4DMoT)技术和运动感知视频扩散Transformer(MV-DiT)架构。传统的动画生成方法往往依赖于2D渲染姿态图像,这在处理复杂运动和视角变化时会遇到诸多挑战。而MTVCrafter则另辟蹊径,直接对3D运动序列进行建模,从根本上避免了2D方法的局限性。

4DMoT作为MTVCrafter的基石,其精妙之处在于能够将连续的3D运动数据转化为离散的标记序列。这一过程通过编码器-解码器结构实现,编码器负责提取运动特征,解码器则将这些特征映射到离散的标记空间。这种标记化的方法不仅降低了计算复杂度,也为后续的动画生成提供了更加灵活和可控的输入。

MV-DiT则是MTVCrafter的另一大亮点。它是一种基于Transformer的架构,专门用于处理视频扩散任务。MV-DiT的核心在于其独特的4D运动注意力机制,该机制能够将4D运动标记与视觉标记(如视频帧)有效地结合起来,从而实现对运动序列的精确控制。此外,MV-DiT还采用了4D旋转位置编码(RoPE),以恢复因标记化和展平而丢失的时空关系。这种设计使得MV-DiT能够生成高质量、自然且连贯的人类动画视频。

为了进一步提高生成质量和泛化能力,MTVCrafter还引入了运动感知的分类器自由引导技术。该技术基于学习无条件和条件生成的联合表示,从而能够更好地控制生成过程,并生成更加符合预期的动画效果。此外,MTVCrafter还采用了一种简单但有效的重复和拼接策略,将参考图像与噪声视频潜变量结合,以确保身份一致性。这意味着生成的动画角色能够保持与参考图像一致的身份特征,避免身份漂移或失真。

MTVCrafter的核心功能

MTVCrafter的功能强大而全面,主要体现在以下几个方面:

- 高质量动画生成:MTVCrafter能够生成高质量、自然且连贯的人类动画视频。这得益于其先进的4D运动标记化技术和运动感知视频扩散Transformer架构,能够精确地捕捉和重现人类的各种运动姿态。

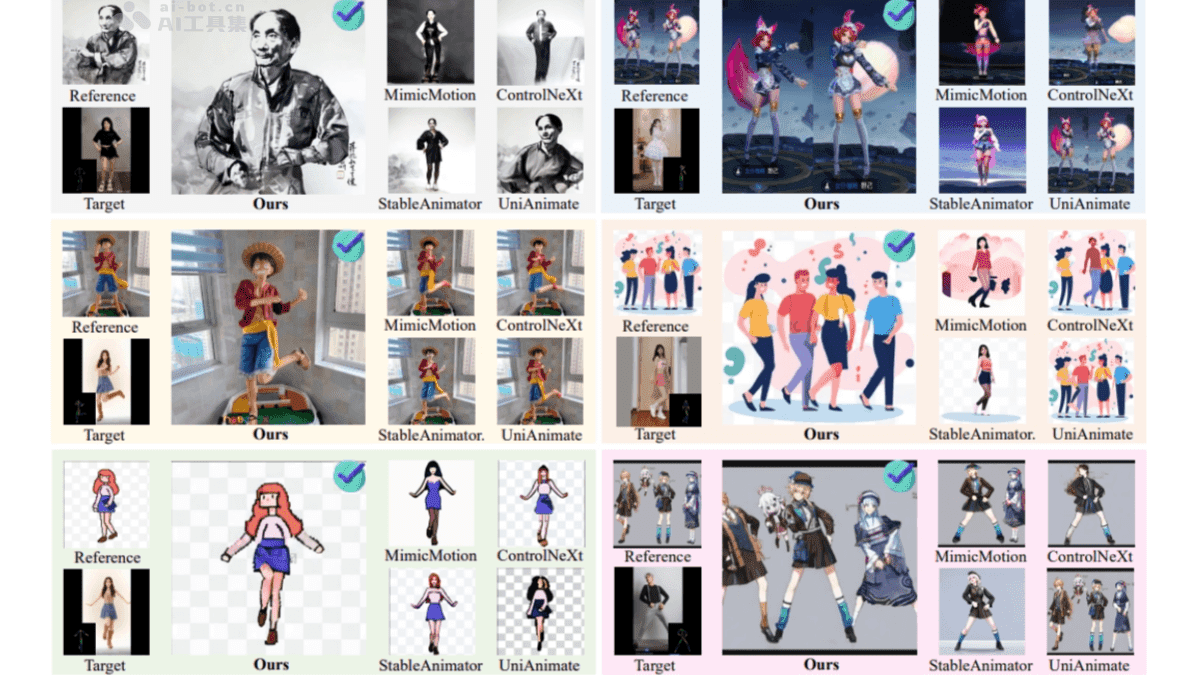

- 强大的泛化能力:MTVCrafter具有强大的泛化能力,能够支持泛化到未见的运动和角色,包括单个和多个角色、全身和半身角色。这意味着MTVCrafter不仅能够处理常见的运动和角色,还能够应对各种复杂的、未知的场景。

- 精确的运动控制:MTVCrafter能够实现对运动序列的精确控制。这得益于其4D运动标记化和运动注意力机制,能够精确地控制动画角色的每一个动作,确保动画的准确性和一致性。

- 身份一致性保持:MTVCrafter能够在动画生成过程中,保持参考图像的身份特征,避免身份漂移或失真。这意味着生成的动画角色能够始终保持与参考图像一致的外貌和特征。

MTVCrafter的应用场景

MTVCrafter的应用前景十分广阔,可以应用于各种需要人像动画生成的场景,例如:

- 数字人动画:MTVCrafter可以为虚拟主播、客服、偶像等数字人生成自然流畅的动作和表情,提高数字人的表现力和吸引力。在直播电商、在线教育、虚拟社交等领域,数字人正扮演着越来越重要的角色。MTVCrafter的出现,无疑将为数字人注入新的活力。

- 虚拟试穿:MTVCrafter可以结合用户照片和服装,生成动态试穿效果,提升购物体验。传统的在线购物往往缺乏真实的试穿体验,导致用户难以做出购买决策。而MTVCrafter的虚拟试穿功能,则能够让用户身临其境地感受服装的上身效果,从而提高购买转化率。

- 沉浸式内容:MTVCrafter可以在VR和AR中生成与用户动作同步的虚拟角色动画,增强沉浸感。VR和AR技术正日益普及,为用户带来前所未有的沉浸式体验。MTVCrafter的虚拟角色动画功能,能够让用户在虚拟世界中与自己或他人进行互动,从而增强沉浸感和互动性。

- 影视特效:MTVCrafter可以快速生成高质量角色动画,降低制作成本,提升特效表现力。影视特效制作是一个耗时耗力的过程,需要大量的专业人员和设备。而MTVCrafter的出现,则能够大大降低制作成本,提高制作效率,并提升特效的表现力。

- 社交媒体:MTVCrafter可以让用户结合照片和动作创作个性化动画,增加内容趣味性。在社交媒体上,用户越来越追求个性化和创意的内容。MTVCrafter的个性化动画功能,能够让用户创作出独一无二的动画作品,从而吸引更多的关注和互动。

MTVCrafter的优势与挑战

与其他同类框架相比,MTVCrafter具有明显的优势:

- 更高的生成质量:MTVCrafter基于先进的4D运动标记化技术和运动感知视频扩散Transformer架构,能够生成更高质量、更自然的动画视频。

- 更强的泛化能力:MTVCrafter具有更强的泛化能力,能够支持泛化到未见的运动和角色,包括单个和多个角色、全身和半身角色。

- 更精确的运动控制:MTVCrafter能够实现对运动序列的更精确控制,确保动画的准确性和一致性。

- 更好的身份一致性:MTVCrafter能够在动画生成过程中,保持参考图像的身份特征,避免身份漂移或失真。

当然,MTVCrafter也面临着一些挑战:

- 计算资源需求:MTVCrafter的训练和推理需要大量的计算资源,这可能会限制其在一些低端设备上的应用。

- 数据依赖性:MTVCrafter的性能高度依赖于训练数据的质量和数量,如果训练数据不足或存在偏差,可能会影响其生成效果。

- 可控性:虽然MTVCrafter能够实现对运动序列的精确控制,但在某些情况下,用户可能需要更加精细的控制,例如控制角色的表情和眼神。

MTVCrafter的未来发展方向

展望未来,MTVCrafter的发展方向主要集中在以下几个方面:

- 降低计算资源需求:通过优化模型结构和算法,降低MTVCrafter的计算资源需求,使其能够在更多的设备上运行。

- 提高数据利用率:通过采用数据增强、迁移学习等技术,提高MTVCrafter的数据利用率,减少对训练数据的依赖。

- 增强可控性:通过引入更多的控制信号,例如语音、文本、手势等,增强MTVCrafter的可控性,使其能够生成更加符合用户需求的动画。

- 拓展应用场景:将MTVCrafter应用于更多的领域,例如游戏、教育、医疗等,为这些领域带来新的可能性。

结语

MTVCrafter作为一种新型的人像动画生成框架,其先进的技术原理、强大的功能和广阔的应用前景,使其在数字内容创作领域具有巨大的潜力。随着技术的不断发展和完善,MTVCrafter有望成为未来数字内容创作的重要工具,为人们带来更加丰富多彩的数字体验。