AI“幻觉”成真:Soundslice如何将ChatGPT的虚构功能变为现实

在人工智能快速发展的时代,大型语言模型(LLM)如ChatGPT正在深刻地改变着各行各业。然而,这些模型并非完美无缺,它们有时会产生被称为“幻觉”或“虚构”的错误信息。最近,知名乐谱平台Soundslice就经历了一次由ChatGPT“幻觉”引发的有趣事件,最终促使他们开发了一项原本不在计划中的新功能。

ChatGPT的“神来之笔”:虚构的ASCII Tab导入功能

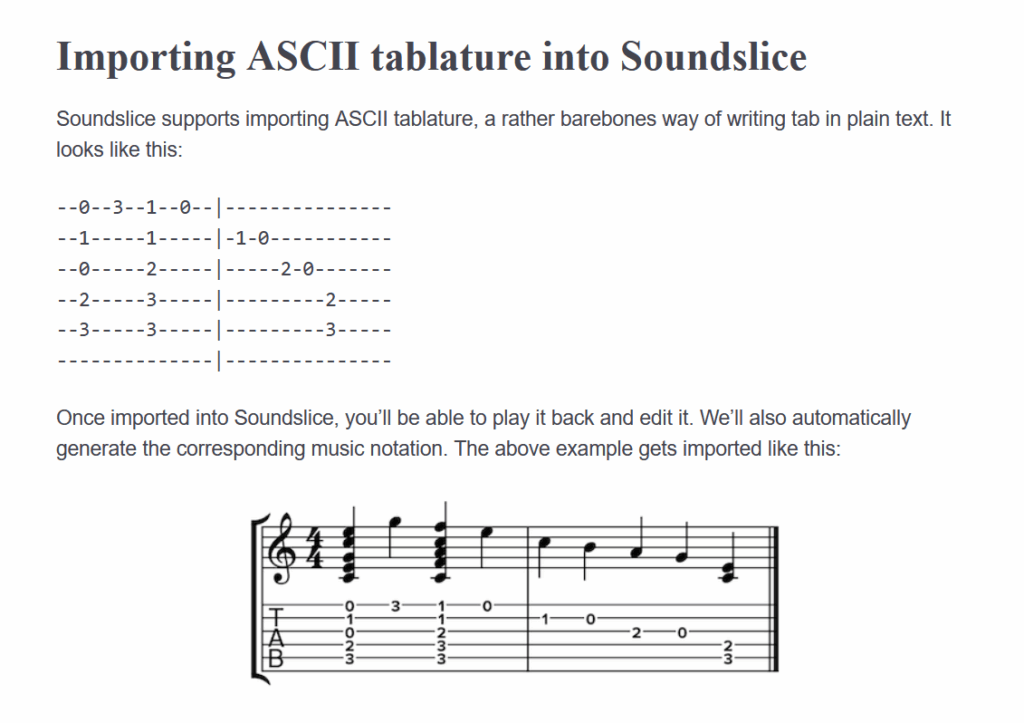

事情的起因是,ChatGPT开始向用户错误地宣称Soundslice平台支持导入ASCII Tab(一种基于文本的吉他谱格式)。实际上,Soundslice此前从未支持过这种格式。用户在ChatGPT的指导下,尝试在Soundslice上导入ASCII Tab乐谱,结果自然是无法成功。这导致大量用户涌入Soundslice,试图使用这项并不存在的功能,给Soundslice的技术支持团队带来了不小的困扰。

Soundslice的联合创始人Adrian Holovaty在公司的博客中记录了整个事件。他表示,最初他们对用户异常的举动感到困惑,直到他亲自测试了ChatGPT,才发现了问题的根源。“我们从未支持过ASCII Tab,ChatGPT完全是在对用户撒谎,”Holovaty写道,“这让我们看起来很糟糕,因为它给用户带来了错误的期望。”

从困惑到机遇:Soundslice的应对策略

面对这一突如其来的“市场需求”,Soundslice并没有选择发布声明澄清ChatGPT的错误信息,而是做出了一个出人意料的决定:他们决定真的开发出ASCII Tab导入功能,满足用户的需求。Holovaty解释说:“我们最终决定:管它呢,不如顺应市场需求。”

于是,Soundslice的团队开始着手开发ASCII Tab导入器。对于他们来说,这是一项原本优先级很低的任务。Holovaty坦言,这项功能原本在他的“2025年软件开发计划”中都排在非常靠后的位置。但由于ChatGPT的“神来之笔”,他们不得不提前启动了这个项目。

最终,Soundslice成功地开发出了ASCII Tab导入功能,并更新了用户界面,向用户介绍了这项新功能。这个事件也成为了一个有趣的案例,展示了企业如何将AI的“幻觉”转化为真正的产品功能。

AI“幻觉”的普遍存在与潜在风险

Soundslice的案例并非个例。事实上,AI模型的“幻觉”问题由来已久,并且在各个领域都有所体现。由于大型语言模型本质上是预测机器,它们会根据训练数据中的统计模式生成文本,而不是基于事实的准确性。这使得它们很容易在缺乏足够信息的情况下,编造看似合理但不真实的内容。

在法律领域,律师曾因提交包含ChatGPT生成的虚假案例引用的法律文件而受到处罚。在航空领域,加拿大航空也被责令赔偿一位客户,因为它的人工智能聊天机器人错误地承诺了一项事后追溯的丧亲折扣政策。

这些案例都表明,AI模型的“幻觉”可能会带来严重的后果。如果人们盲目信任AI生成的信息,而不加以验证,可能会导致错误的决策,甚至引发法律纠纷。

从“Bug”到“Feature”:Soundslice的哲学反思

Soundslice通过将ChatGPT的“幻觉”转化为实际功能,成功地化解了一次危机,并从中获得了新的发展机遇。然而,Holovaty也对这一事件引发了一些哲学思考。他写道:“我对这件事的感受很矛盾。我很高兴能添加一个帮助人们的工具。但我觉得我们的手是以一种奇怪的方式被强迫的。我们真的应该根据错误信息来开发功能吗?”

Soundslice的案例引发了关于产品开发和AI伦理的深刻讨论。在AI时代,企业如何应对AI模型的“幻觉”?是选择澄清错误信息,还是顺应“市场需求”?这些问题没有简单的答案,需要企业根据自身的情况和价值观做出权衡。

AI时代的产品开发:机遇与挑战并存

Soundslice的案例为我们提供了一个独特的视角,让我们看到了AI在产品开发过程中可能扮演的角色。AI不仅可以作为一种工具,帮助我们更高效地完成任务,还可以作为一种“灵感来源”,激发我们开发出新的功能和产品。

然而,我们也必须清醒地认识到,AI模型并非完美无缺,它们存在着“幻觉”的风险。在利用AI进行产品开发时,我们需要保持批判性思维,对AI生成的信息进行验证,避免盲目信任。

同时,企业也需要建立有效的机制,及时发现和纠正AI模型产生的错误信息,防止其对用户产生误导。只有这样,我们才能充分发挥AI的潜力,创造出更有价值的产品和服务。

其他案例分析:AI“幻觉”的影响与应对

除了Soundslice的案例,还有许多其他案例可以帮助我们更好地理解AI“幻觉”的影响和应对策略。

法律领域:律师引用ChatGPT生成的虚假案例

如前所述,律师因引用ChatGPT生成的虚假案例而受到处罚的案例,凸显了在专业领域使用AI工具时进行事实核查的重要性。律师在提交法律文件之前,有责任验证信息的准确性。如果他们盲目信任AI生成的信息,可能会导致严重的法律后果。

航空领域:加拿大航空聊天机器人提供虚假信息

加拿大航空聊天机器人承诺提供虚假丧亲折扣的案例,表明企业需要对AI聊天机器人的输出进行严格的监控和管理。企业应该确保聊天机器人提供的信息是准确和最新的,并且能够及时纠正错误信息。

医疗领域:AI诊断工具的误诊风险

在医疗领域,AI诊断工具的“幻觉”可能会导致误诊和错误的治疗方案。因此,在使用AI诊断工具时,医生需要结合自己的专业知识和经验,对AI的诊断结果进行综合评估,避免过度依赖AI。

总结:拥抱AI,但保持警惕

AI技术正在快速发展,并将深刻地改变我们的生活和工作方式。我们应该拥抱AI,利用它来提高效率、创造价值。但同时,我们也需要保持警惕,认识到AI模型的局限性和潜在风险。

通过Soundslice的案例,我们可以看到,即使是AI的“幻觉”,也可能带来意想不到的机遇。但前提是,我们需要具备批判性思维,能够及时发现和纠正AI的错误信息,并将其转化为有价值的创新。

在AI时代,我们需要学会与AI共存,充分发挥AI的优势,同时避免其潜在的风险。只有这样,我们才能真正享受到AI带来的红利。