在人工智能与计算机视觉快速发展的今天,三维空间重建技术正经历着前所未有的变革。近日,字节跳动Seed团队推出了名为Depth Anything 3(DA3)的视觉空间重建模型,这一创新性成果以其独特的架构设计和卓越的性能表现,引起了业界的广泛关注。本文将深入剖析Depth Anything 3的技术原理、核心功能、应用场景及其对未来视觉空间重建领域的影响。

什么是Depth Anything 3

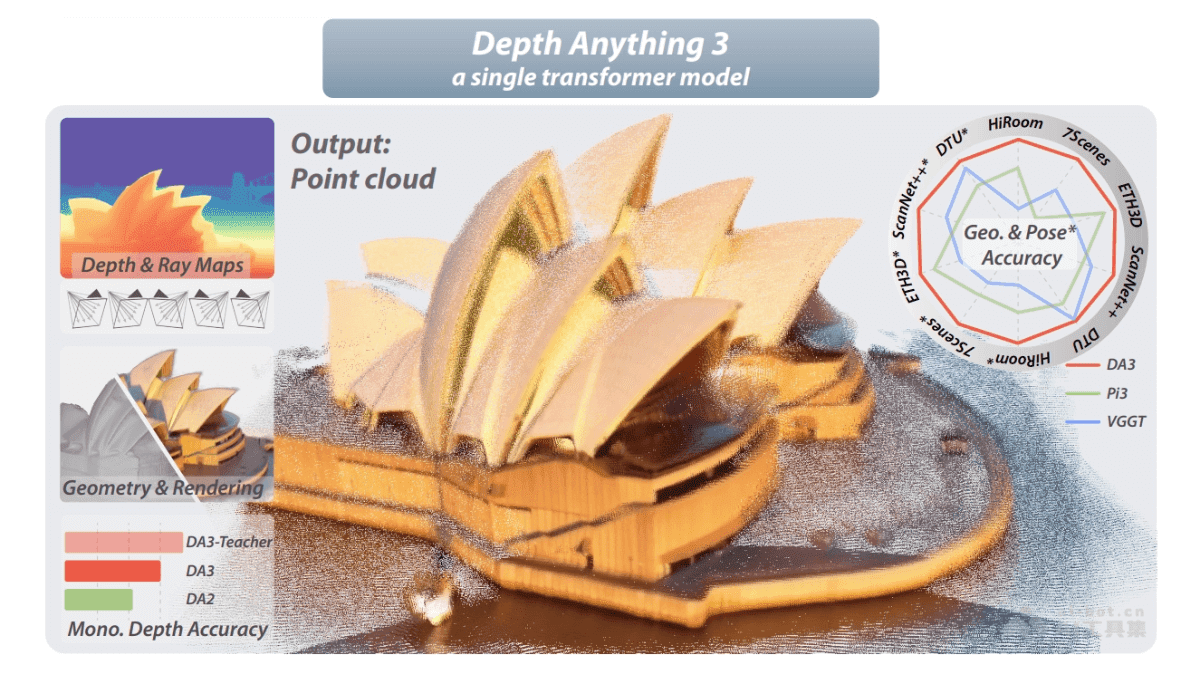

Depth Anything 3(DA3)是字节跳动Seed团队研发的一款革命性视觉空间重建模型,其核心创新在于通过单一Transformer架构实现从任意视角的视觉输入中恢复三维空间几何结构。与传统的多任务训练复杂模型不同,DA3采用了创新的"深度-射线"表征法,极大地简化了模型设计,同时显著提升了重建精度和推理效率。

该模型在相机姿态精度和几何重建精度方面均超越了此前的主流模型,同时保持了高效的推理速度,为视觉空间重建领域提供了新的高效解决方案。DA3的出现,不仅代表了字节跳动在AI视觉领域的技术实力,也为自动驾驶、机器人导航、虚拟现实等前沿应用场景带来了新的可能性。

Depth Anything 3的核心功能

多视角空间重建能力

Depth Anything 3最突出的功能是其强大的多视角空间重建能力。与传统方法不同,DA3能够从任意数量的视觉输入(包括单张图片、多视角图像或视频流)中重建出完整的三维空间结构。这一特性使得模型在实际应用中具有极高的灵活性,能够适应各种复杂场景的重建需求。

在单目重建任务中,DA3能够仅凭一张图像就生成具有一定精度的三维空间表示;而在多视角重建场景中,模型能够充分利用不同视角间的信息互补,生成更加完整和准确的三维模型。这种从单目到多视角的灵活适应能力,使得DA3在资源受限或难以获取多视角数据的场景中依然能够发挥重要作用。

高精度相机姿态估计

相机姿态估计是三维重建中的关键环节,Depth Anything 3在这方面表现出色。模型能够准确估计输入图像的相机姿态,包括位置和方向等关键参数。更值得注意的是,即使在没有已知相机参数的情况下,DA3依然能够实现较为准确的姿态估计,这一特性大大降低了模型在实际应用中的部署门槛。

传统的相机姿态估计方法通常需要复杂的标定过程或特定的相机模型假设,而DA3通过其创新的"深度-射线"表征法和Transformer架构,实现了更加鲁棒和准确的姿态估计。这一进步不仅提高了三维重建的整体精度,也为后续的视觉SLAM(同步定位与地图构建)等应用提供了更加可靠的基础。

单目深度估计

单目深度估计是Depth Anything 3的另一核心功能,也是三维场景理解的基础。模型在单目深度估计任务上表现出色,能够从单张图像中预测出像素级的深度信息,为三维场景理解提供关键支持。

与传统的深度估计方法相比,DA3的优势在于其预测的深度图不仅具有较高的精度,而且保持了良好的尺度一致性。这意味着在不同图像中,相同物体的相对深度关系能够得到准确保持,这对于需要精确空间关系的应用场景(如自动驾驶中的障碍物检测)具有重要意义。

新视角合成

新视角合成是Depth Anything 3的又一创新功能,通过与3D高斯渲染技术结合,模型能够生成从未知视角观察的高质量图像。这一功能在虚拟现实和增强现实领域具有广泛应用,能够实现更加自然和沉浸式的视角渲染。

传统的新视角合成方法通常需要大量的训练数据和复杂的渲染流程,而DA3通过其深度-射线表征和高效的Transformer架构,实现了更加轻量化和高质量的新视角合成。这不仅降低了技术门槛,也为实时应用场景提供了可能。

高效推理与部署

Depth Anything 3的简洁架构设计使其在推理速度和资源消耗上具有显著优势。模型能够快速处理大规模场景,同时保持较低的内存占用和计算开销,这使得它不仅适用于云端部署,还能在移动端和嵌入式设备上高效运行。

在实际应用中,DA3的高效性意味着更低的延迟和更好的用户体验。例如,在自动驾驶场景中,模型能够实时处理摄像头捕捉的图像,为车辆提供及时的环境感知;在机器人导航中,DA3能够快速响应环境变化,支持机器人的实时决策。这种高效性不仅提升了应用性能,也降低了部署成本,加速了技术的商业化进程。

Depth Anything 3的技术原理

单一Transformer架构

Depth Anything 3最显著的技术特点是其采用的单一Transformer架构。与传统的多任务复杂模型不同,DA3仅使用一个Transformer模型(如DINOv2)作为基础架构,无需复杂的定制化设计。这种简洁的架构不仅降低了模型的复杂度,也提高了训练和推理的效率。

Transformer的自注意力机制是DA3能够灵活处理任意数量输入视图的关键。通过自注意力机制,模型能够动态交换跨视图信息,实现高效的全局空间建模。这种设计使得DA3能够从单张图片到多视角视频流的各类输入中提取有效的空间信息,为三维重建提供坚实基础。

深度-射线表征法

"深度-射线"表征法是Depth Anything 3的核心创新之一。模型通过预测深度图和射线图来完整描述三维空间,其中深度图提供像素到相机的距离信息,射线图则描述像素在三维空间中的投影方向。这种表征方式自然解耦了空间几何与相机运动,简化了模型输出,同时提高了精度和效率。

传统的三维重建方法通常需要显式地估计相机参数和场景几何,而DA3的深度-射线表征将这两者统一在一个统一的框架中,避免了复杂的参数估计过程。这种表征方式不仅简化了模型设计,也提高了重建的鲁棒性,特别是在相机参数不完全已知的情况下。

输入自适应的跨视图自注意力机制

Depth Anything 3引入了输入自适应的跨视图自注意力机制,通过动态重排输入视图的token,实现高效的跨视图信息交换。这一机制使模型能够灵活处理从单目到多视图的各种输入场景,并根据输入数据的特性自适应地调整信息交换策略。

在多视角输入场景中,跨视图自注意力机制允许模型在不同视图间建立对应关系,提取互补的空间信息;而在单目输入场景中,机制则能够充分利用图像内的上下文信息,生成合理的深度预测。这种输入适应性使得DA3能够在一个统一的框架下处理多种输入类型,大大提高了模型的实用性和灵活性。

双DPT头设计

为联合预测深度和射线图,DA3设计了双DPT头结构。DPT(Dense Prediction Transformer)头是一种专门用于密集预测任务的Transformer组件,能够高效处理像素级的预测任务。

在DA3中,两个DPT头共享特征处理模块,在最终融合阶段分别优化深度和射线图的输出。这种设计既保证了特征提取的效率,又增强了两任务之间的交互和一致性。深度和射线图虽然预测的是不同类型的空间信息,但它们在三维空间中相互关联,双DPT头设计能够充分利用这种关联性,提高整体重建质量。

教师-学生训练范式

Depth Anything 3采用了教师-学生训练范式,通过在合成数据上训练的教师模型生成高质量的伪标签,为学生模型提供更准确的监督。这种训练策略特别适合于缺乏大规模真实标注数据的三维重建任务。

在教师-学生框架中,教师模型通常在大量合成数据上进行预训练,掌握较为全面的三维重建知识;然后,教师模型为真实数据生成伪标签,学生模型则在这些伪标签的指导下进行训练。这种两阶段训练方式既利用了合成数据的丰富性,又保证了模型在真实数据上的泛化能力。

一步完成高精度输出

传统三维重建方法通常需要多次迭代优化才能获得高精度结果,而Depth Anything 3通过一次前馈就能生成高精度的深度和射线图,无需传统方法中的多次迭代优化。这一特性显著提升了推理速度,简化了训练和部署流程,同时确保三维重建的精确性和高效性。

一步完成高精度输出的能力主要得益于DA3创新的表征方式和高效的Transformer架构。深度-射线表征将三维重建问题转化为两个相对独立的预测任务,而Transformer的自注意力机制则能够有效地捕捉全局空间信息,从而在一次前馈过程中生成高质量的重建结果。

Depth Anything 3的应用场景

自动驾驶领域

在自动驾驶领域,Depth Anything 3能够从车辆摄像头拍摄的多视角图像中快速重建三维环境,帮助自动驾驶系统更准确地感知周围物体的距离和位置,提升决策的可靠性和安全性。

传统自动驾驶系统通常依赖激光雷达等昂贵传感器来获取环境深度信息,而DA3仅通过摄像头就能实现高精度的三维重建,大大降低了硬件成本。同时,模型的高效推理能力使其能够实时处理摄像头捕捉的图像,为自动驾驶系统提供及时的环境感知支持。

在具体应用中,DA3可以用于车辆周围环境的实时三维建模,包括道路、建筑物、行人、车辆等元素的精确定位。这些信息对于自动驾驶系统的路径规划、障碍物避让和决策制定至关重要。此外,模型的高精度深度估计还能提升计算机视觉算法的性能,如目标检测、语义分割等,从而进一步提高自动驾驶系统的整体性能。

机器人导航

机器人导航是Depth Anything 3的另一重要应用场景。通过实时重建环境的三维结构,DA3能够为机器人提供精确的地形和障碍物信息,支持其在复杂环境中进行高效导航和路径规划。

在室内环境中,DA3可以帮助服务机器人理解房间布局、识别家具和障碍物,从而实现自主导航和任务执行。在户外环境中,模型则能够帮助机器人适应复杂地形,识别潜在危险,确保安全导航。特别是在救援机器人、农业机器人等特殊应用场景中,DA3的高效性和鲁棒性使其成为理想的环境感知解决方案。

与传统机器人导航方法相比,DA3的优势在于其能够从单目摄像头获取深度信息,无需额外的深度传感器,这大大降低了机器人的制造成本和复杂度。同时,模型的高效推理能力使其能够在资源受限的嵌入式设备上运行,满足机器人实时导航的需求。

虚拟现实和增强现实

虚拟现实(VR)和增强现实(AR)是Depth Anything 3具有广阔应用前景的领域。模型能够将现实场景快速转换为高精度的三维模型,用于虚拟现实中的场景重建或增强现实中的虚拟物体融合,提升用户的沉浸感。

在VR应用中,DA3可以用于创建逼真的虚拟环境,使用户能够在虚拟空间中获得更加真实的体验。例如,在虚拟旅游应用中,模型可以真实还原旅游景点的三维结构,为用户提供身临其境的游览体验。在AR应用中,DA3则可以帮助虚拟物体与现实场景进行自然融合,提高AR应用的真实感和沉浸感。

Depth Anything 3的新视角合成功能在VR/AR领域尤其有价值。通过生成从未知视角观察的高质量图像,模型可以实现更加自然和流畅的视角切换,提升用户体验。同时,模型的高效性使其能够在移动设备上实时运行,支持移动VR/AR应用的发展。

建筑测绘与设计

在建筑行业,Depth Anything 3可以从建筑场景的多视角图像中重建出详细的三维点云,为建筑测绘、室内设计和虚拟建筑漫游提供高效的数据支持。这一应用不仅提高了工作效率,也降低了专业测绘设备的使用成本。

传统建筑测绘通常需要专业的激光扫描设备和大量人工操作,而DA3仅通过普通相机拍摄的照片就能实现高精度的三维重建,大大简化了测绘流程。在建筑设计阶段,模型生成的三维模型可以帮助设计师更好地理解空间关系,优化设计方案。在建筑展示和营销阶段,虚拟建筑漫游则能够为客户提供更加直观和沉浸式的体验。

Depth Anything 3在建筑遗产保护方面也具有特殊价值。通过高精度重建历史建筑的三维结构,模型可以为建筑修复和保护提供精确的数据支持,同时也能够创建数字孪生模型,用于建筑的研究和教育。

文化遗产保护

文化遗产保护是Depth Anything 3具有社会意义的重要应用领域。模型可以用于重建历史建筑或文物的三维结构,便于进行数字化保护、修复研究及虚拟展示,帮助文化遗产的传承和推广。

在文物数字化方面,DA3可以创建高精度的文物三维模型,为文物的虚拟展示和研究提供基础数据。这些数字模型不仅可以用于博物馆的线上展览,还可以为文物修复提供参考,减少对原始文物的直接接触和损害。在历史建筑保护方面,模型可以帮助记录建筑的结构特征和损坏情况,为修复决策提供科学依据。

Depth Anything 3的高效性和低成本特性使其特别适合于大规模文化遗产数字化项目。与传统三维扫描技术相比,DA3仅需要普通相机和相对简单的拍摄流程,大大降低了数字化工作的门槛,使得更多文化遗产能够得到保护和传承。

技术创新与未来展望

Depth Anything 3的出现代表了视觉空间重建领域的重要进步。其创新的单一Transformer架构、深度-射线表征法以及高效的训练和推理策略,为三维重建技术开辟了新的研究方向。这些技术创新不仅提高了重建精度和效率,也降低了技术应用的门槛,加速了三维重建技术的普及和应用。

未来,Depth Anything 3及其后续版本可能会在以下几个方面继续发展和完善:

多模态融合:结合RGB图像、红外图像、雷达等多种传感器数据,进一步提高重建的鲁棒性和准确性。

实时性能优化:针对移动设备和嵌入式平台进行进一步优化,实现更低延迟和更高帧率的实时三维重建。

动态场景处理:扩展模型对动态场景的理解能力,实现运动物体的三维重建和跟踪。

语义理解增强:将语义信息融入三维重建过程,生成具有语义理解的三维场景表示。

大规模场景重建:优化模型对大规模场景的处理能力,实现城市级环境的高效三维重建。

随着这些技术的发展,Depth Anything 3有望在更多领域发挥重要作用,推动自动驾驶、机器人、虚拟现实等技术的进步,同时也将为科学研究、文化遗产保护等领域提供强有力的技术支持。

结论

Depth Anything 3作为字节跳动Seed团队推出的创新性视觉空间重建模型,通过单一Transformer架构和深度-射线表征法,实现了从任意视角输入中恢复三维空间几何结构的高效解决方案。该模型在相机姿态精度、几何重建精度和推理效率方面均表现出色,为自动驾驶、机器人导航、虚拟现实等多个领域带来了新的可能性。

Depth Anything 3的技术创新不仅体现在其卓越的性能上,更体现在其对传统三维重建方法的简化和革新。通过一步完成高精度输出、输入自适应的跨视图自注意力机制等创新设计,模型大大降低了三维重建的复杂度和计算成本,使得这一技术能够在更广泛的场景中得到应用。

随着Depth Anything 3及其后续版本的不断发展,我们有理由相信,视觉空间重建技术将在未来几年内取得更加显著的进步,为人类社会带来更多的便利和价值。同时,这一技术的发展也将进一步推动人工智能与计算机视觉领域的创新,为构建更加智能和互联的世界提供技术基础。