智能时代下的平台治理:抖音对AI技术滥用的严厉回应

随着人工智能生成内容(AIGC)技术的普及,其在电商领域的应用日益广泛,但也随之带来了新的挑战。抖音电商安全与信任中心近日发布的公告,明确表示将严厉打击平台内滥用AI技术的行为,对违规商家和达人采取下架商品、清退账号等惩戒措施。这一举措不仅是对消费者权益的有力保障,更是对平台生态健康发展的积极维护。

具体而言,抖音此次治理的重点在于遏制利用AI生成虚假商品展示、夸大产品功能以及仿冒名人形象进行误导性宣传的行为。例如,通过AI技术合成的虚拟模特展示服装,若与实际商品存在显著差异,或AI生成的产品描述过于夸大,均属于违规范畴。更深层次的问题在于,一些不法分子利用AI深度伪造(deepfake)技术,合成名人形象进行虚假代言或推广,严重损害了名誉权和消费者信任。平台要求创作者在发布AI生成内容时必须进行自主声明,未声明的作品将受到治理,这标志着平台对AI内容透明度的更高要求,旨在构建一个更负责任、更可信赖的数字生态环境。

这一政策的出台,反映出全球范围内对AIGC内容治理的共同关注。当AI技术降低了内容创作的门槛,同时也放大了虚假信息传播的风险。抖音的行动无疑为其他内容平台提供了借鉴,即在享受AI技术带来效率提升的同时,必须同步加强内容审核与风险管理。未来,如何平衡AI创新与内容安全,将是所有内容平台面临的长期课题,也考验着平台的技术识别能力和治理智慧。

音频创作新纪元:ElevenLabs音效模型的里程碑式升级

在AI生成内容的广阔天地中,音频领域的突破同样引人注目。ElevenLabs作为文本转语音领域的佼佼者,其音效模型近日更新至版本2,带来了多项关键改进,为音频内容创作者提供了前所未有的灵活性和高质量输出。新版本模型支持最长30秒的音频片段生成,这一长度的提升对于制作更复杂的环境音、背景音乐或特定音效序列至关重要。此前,较短的片段往往难以承载丰富的情感或场景信息,而现在,创作者可以更自如地构建沉浸式的听觉体验。

更具创新性的是,ElevenLabs新增了无缝循环功能。这一特性对于游戏开发、电影配乐、播客节目以及任何需要长时间背景音效的场景都具有革命性意义。传统的循环音效制作往往需要人工精心剪辑和调整,以避免突兀的衔接痕迹。而AI自动生成的无缝循环,不仅节省了大量时间和精力,更能保证音频质量的一致性和流畅性。此外,新模型支持48kHz采样率,这是专业音频制作中常用的高标准,显著提升了音频的保真度。这意味着由AI生成的音效将拥有更广阔的动态范围、更清晰的细节和更真实的听感,从而达到与专业录制相媲美的水平。

这些技术进步将深刻影响影视、游戏、广告等多个行业。例如,游戏开发者可以利用AI快速生成各种环境音和角色音效;播客制作者可以轻松定制背景音乐和音效,提升节目专业度;电影制作人则能以前所未有的效率,为场景添加细腻而富有感染力的声音元素。ElevenLabs的更新,无疑是AI赋能创意产业的又一里程碑,预示着未来音频内容创作将更加智能化、高效化和个性化。

OpenAI的战略布局:收购Statsig强化产品迭代与数据分析

人工智能领域的竞争日益激烈,巨头们的战略性收购往往预示着行业发展的新方向。OpenAI近日收购产品开发数据分析平台Statsig,是其在商业化和产品落地方面迈出的重要一步。此次收购不仅增强了OpenAI在产品迭代和数据分析方面的能力,更将其创始人Vijaye Raji吸纳为OpenAI的CTO,使得Statsig的核心技术和人才得以无缝融入。

Statsig平台以其强大的数据处理能力著称,每天可处理高达1万亿次事件,为产品开发提供高效的实验和数据分析支持。对于OpenAI而言,这意味着其能够更精准地理解用户行为、评估模型性能、优化产品功能。在AI产品开发中,数据驱动的决策至关重要。通过Statsig,OpenAI可以进行A/B测试、特征门控、用户分群分析等,从而快速迭代产品,确保每一次更新都能带来用户体验的提升和商业价值的最大化。例如,针对ChatGPT等核心产品,OpenAI可以利用Statsig分析不同模型版本、提示词策略或UI设计对用户参与度、满意度和留存率的影响,进而做出科学的产品调整。

Vijaye Raji的加入,无疑将为OpenAI带来丰富的工程管理和产品开发经验,特别是在构建和扩展大规模数据驱动产品方面的专长。这对于OpenAI实现下一代AI产品的规模化发展至关重要。在AI模型日益复杂、应用场景不断拓展的背景下,一个强大的数据分析和产品迭代框架,是确保技术领先和市场竞争力的核心要素。此次收购表明,OpenAI不仅关注模型的智能上限,更重视其在真实世界中的效用、可扩展性和用户反馈,为其在全球AI竞赛中占据优势地位奠定了坚实基础。

购物体验的未来:亚马逊Lens Live与AI助手的深度融合

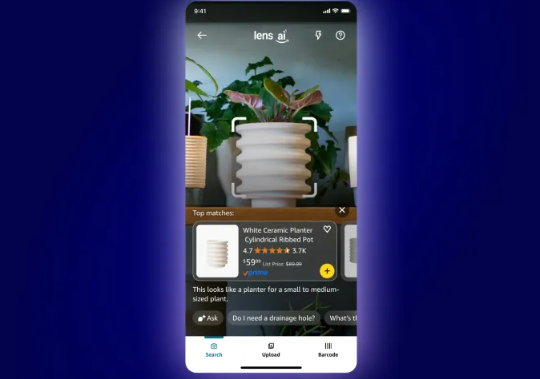

零售巨头亚马逊从未停止探索科技如何改变购物方式的步伐。近日,亚马逊推出了名为Lens Live的全新AI功能,旨在通过手机摄像头为用户带来前所未有的实时扫描购物体验。这项创新功能将现实世界与数字商品信息无缝连接,用户只需将手机摄像头对准任何物品,Lens Live便能实时识别并展示亚马逊上的相关商品,并允许用户直接将其添加到购物车。

Lens Live的亮点在于其与亚马逊AI助手Rufus的深度整合。当用户扫描物品时,Rufus不仅能提供商品的基本信息,还能回答用户关于该商品的各种问题,例如材质、功能、评价等。这种交互式购物体验,极大地提升了用户决策的效率和便捷性。想象一下,你在朋友家看到一件心仪的装饰品,无需询问或拍照上传搜索,只需用手机一扫,即可获取详细信息并直接购买,这无疑是未来购物场景的缩影。

Lens Live的推出,代表着零售业向“所见即所得”的购物模式迈出了关键一步。它利用了先进的计算机视觉和自然语言处理技术,将物理世界的视觉信息转化为可操作的数字购物路径。对于消费者而言,这是一种更直观、更省时的购物方式;对于亚马逊而言,这不仅能提升用户粘性,更能通过实时数据洞察用户需求,优化商品推荐和库存管理。然而,这项技术也面临着挑战,例如对复杂环境下的物品识别准确性、不同光照条件下的稳定性,以及如何处理无库存或非亚马逊平台商品等。但无论如何,Lens Live都预示着AI技术正以前所未有的方式,重塑我们的日常消费体验。

提升大模型可靠性:谷歌AI推出Stax评估工具

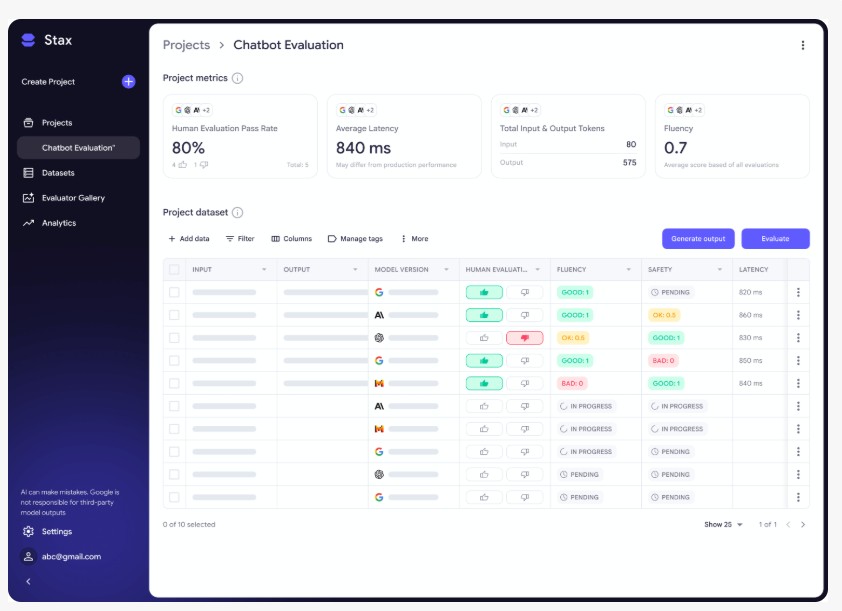

随着大型语言模型(LLMs)在各个领域的广泛应用,如何有效、准确地评估这些模型的性能和可靠性,成为开发者面临的关键挑战。谷歌AI推出的Stax工具,正是为了解决这一痛点,旨在帮助开发者根据自定义标准评估LLMs,从而提升模型测试的效率和准确性。

Stax的核心价值在于其提供了一个结构化的评估框架。它允许开发者快速比较不同模型的表现,通过并排测试多种提示,直观地了解哪些模型在特定任务上更具优势。这对于优化提示工程、选择最适合应用场景的模型至关重要。Stax支持自定义和预构建的评估器,这意味着开发者可以根据自己的具体业务需求,定义模型的成功标准,无论是生成文本的流畅性、事实准确性、安全性还是特定风格的符合度。这种灵活性确保了评估结果与实际应用场景高度相关,避免了“为评估而评估”的现象。

此外,Stax的项目与数据集功能支持大规模测试,确保评估标准在整个开发周期内的一致性。在AI模型开发过程中,持续的评估和反馈是不可或缺的环节。Stax通过自动化评估流程,帮助团队高效管理测试用例和结果,加速模型的迭代周期。这项工具的发布,不仅体现了谷歌在AI评估领域的深厚积累,也为整个LLM生态系统带来了福音。通过提供更科学、更便捷的评估手段,Stax有望帮助开发者构建出更强大、更可靠、更符合用户期待的AI应用,推动LLMs从实验室走向更广泛的商业化成功。

网站构建的未来:WordPress携AI工具Telex简化流程

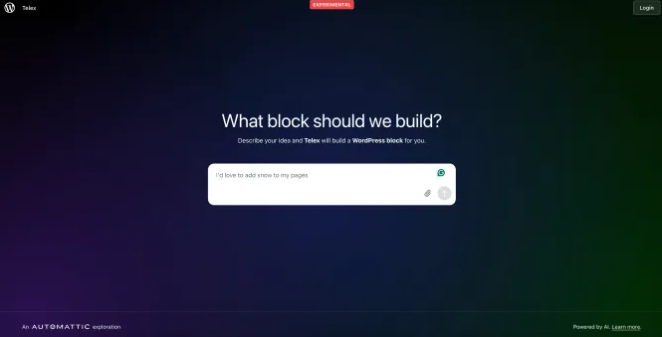

作为全球最受欢迎的内容管理系统(CMS),WordPress一直致力于降低网站建设的门槛。其创始人Matt Mullenweg在WordCamp US2025上重磅推出的AI工具Telex,再次印证了这一愿景。Telex旨在通过AI接口,彻底简化网站构建过程,让用户无需编写任何代码即可创建丰富的网站内容。

Telex的核心理念是“提示即内容”。用户只需通过简单的自然语言描述其网站或特定内容块的需求,Telex便能利用AI的力量生成相应的布局、文本、图片建议乃至完整的内容页面。这种“无代码”或“低代码”的建站方式,对于个人博主、小型企业和非技术背景的创业者而言,无疑是一项重大利好。它将极大地加速网站从概念到发布的周期,让创意更快地变为现实。虽然Telex目前仍处于实验阶段,但其展示出的潜力已经引发了广泛关注,预示着未来网站设计和开发将变得更加智能化和高效化。

Mullenweg在发布会上还提及了与托管服务商WP Engine的法律纠纷,这反映出在AI技术快速发展的背景下,围绕开源软件的知识产权和商业利用正面临新的挑战。这提醒我们,在拥抱AI带来的便利时,也需关注随之而来的法律和伦理问题。尽管如此,Mullenweg对AI技术未来发展的乐观态度,以及WordPress在AI领域的积极探索,都表明AI与CMS的结合将是不可逆转的趋势。Telex的出现,不仅是WordPress自身的一次革新,更是整个网站建设行业向智能化、自动化迈进的重要标志。

边缘智能的突破:Liquid AI推出LFM2-VL轻量级模型

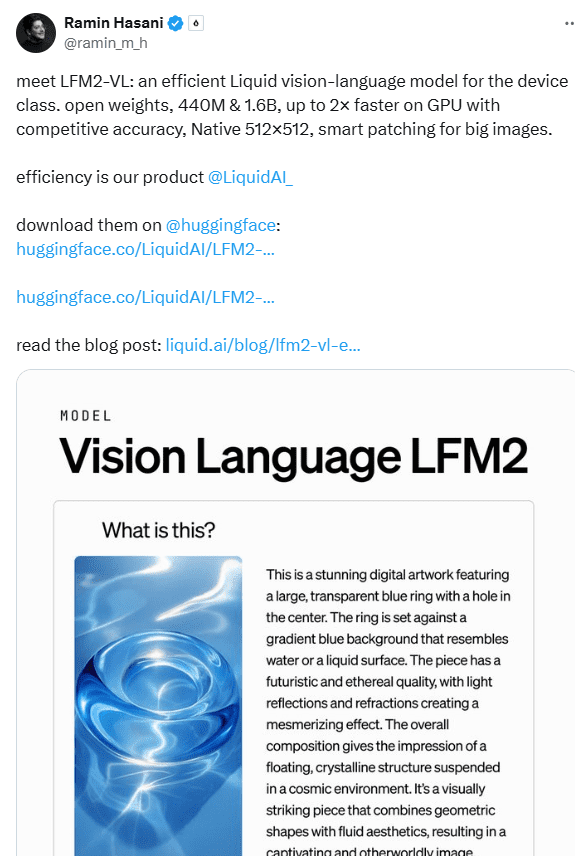

将先进的AI能力部署到资源受限的边缘设备,如智能手机,一直是人工智能领域的重要研究方向。Liquid AI最新发布的LFM2-VL系列模型,正是在这一领域取得了显著突破,为手机等设备带来了“小巧又灵敏”的AI视觉语言能力。该系列包括LFM2-VL-450M和LFM2-VL-1.6B两种型号,分别针对不同资源约束下的设备进行了优化。

LFM2-VL模型的核心优势在于其轻量级设计和高效推理能力。即使是参数更多的LFM2-VL-1.6B,也能够轻松部署在单个GPU上,而450M版本更是专为资源极端受限的环境打造。这意味着智能手机、物联网设备甚至嵌入式系统都能够运行复杂的视觉语言任务,如图像描述生成、视觉问答、实时物体识别与交互等。官方数据显示,这些模型在GPU上的推理速度提升高达两倍,同时在多个多模态任务中表现出色,例如在MSCOCO数据集上,LFM2-VL-1.6B的零样本性能显著优于同类模型。

除了高效性,LFM2-VL还展现出卓越的灵活性和兼容性。它支持高分辨率图像输入,采用非重叠切片方式处理大尺寸图像,确保细节不丢失。同时,模型兼容主流的开发工具和框架,便于开发者将其集成到现有应用中。Liquid AI的这项创新,将加速AI视觉语言能力在消费电子、智能制造、智慧城市等领域的普及。未来,我们的手机将不仅仅是通信工具,更将成为随身携带的智能视觉大脑,能够理解、分析并与我们周围的视觉世界进行更深层次的交互,开启更广阔的智能应用想象空间。

苹果的开源策略:FastVLM与MobileCLIP2赋能边缘AI

苹果公司在Hugging Face平台上重磅开源了两款视觉语言模型——FastVLM和MobileCLIP2,这标志着这家科技巨头在推动AI技术普及和赋能开发者方面迈出了重要一步。这两款模型凭借卓越的性能优化和高效的本地运行能力,为边缘设备AI应用带来了新的可能性,将iPhone等设备转变为强大的AI神器。

FastVLM专为高分辨率图像处理进行了优化,其首词响应时间提升了惊人的85倍,极大地改善了用户在移动设备上进行视觉问答和图像理解的体验。这意味着用户可以更快地获得AI对图像内容的反馈,无论是识别物体、描述场景还是回答关于图像的复杂问题。这种速度的提升对于实时交互式AI应用至关重要。MobileCLIP2则是一款轻量级的CLIP模型,专注于图像与文本的高效特征对齐,特别适用于资源受限的边缘设备。它能够实现实时的多模态交互,例如根据文本描述快速搜索图片,或基于图片内容生成相关文本,为移动端的图像搜索、内容创作和个性化推荐提供了强大的基础。

苹果此次开源策略,展现了其在AI领域开放合作的姿态,有助于吸引全球开发者共同参与到苹果AI生态的建设中来。通过提供这些高性能且针对边缘设备优化的模型,苹果赋能开发者构建更智能、更高效的AI应用,进一步拓展了iPhone乃至整个Apple生态系统的智能边界。这将加速视觉语言模型在消费级产品中的落地,例如更智能的相机应用、更懂用户的图片管理工具,以及更个性化的AR/VR体验。苹果的开源举措,无疑将推动整个行业在边缘AI技术上的创新与发展。

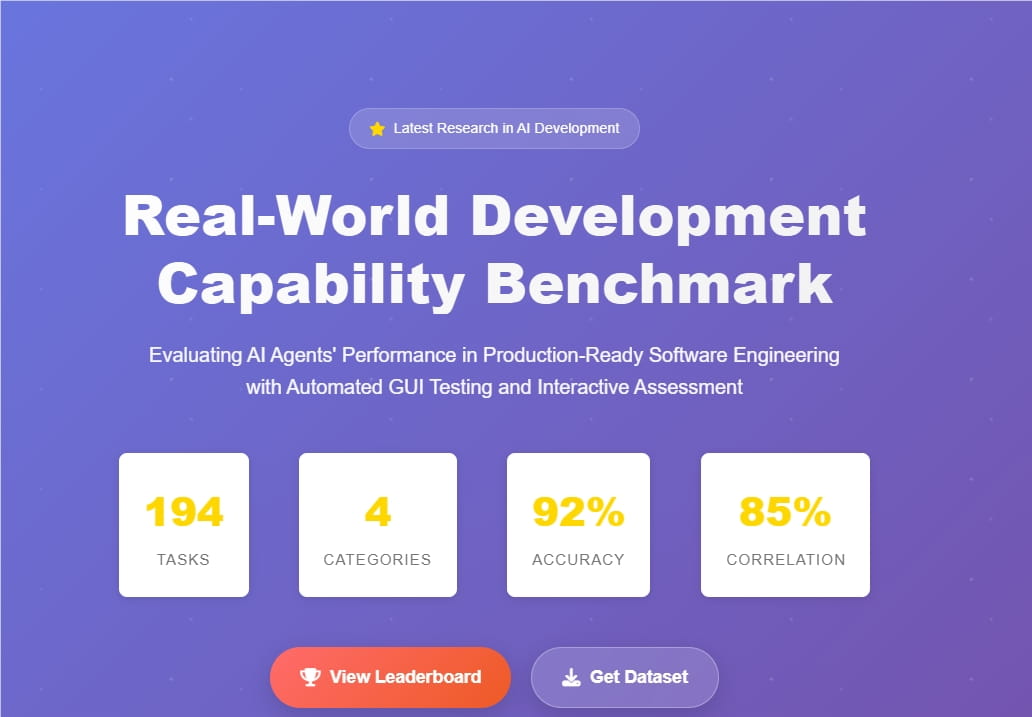

软件开发的未来:MetaGPT推出RealDevWorld自动化测试工具

在软件开发领域,测试是确保产品质量和稳定性的关键环节。然而,传统的软件测试往往耗时耗力,且难以覆盖所有潜在场景。MetaGPT推出的RealDevWorld自动化测试工具,通过引入多智能体协作框架,为端到端自动化测试带来了革命性的改变,其精准度高达92%,极大地提升了测试效率和可靠性。

RealDevWorld的核心创新在于其“自然语言驱动测试”的能力。开发者或测试人员可以通过简单的自然语言描述需求,工具便能自动生成测试用例和执行脚本,从而降低了技术门槛,使得非专业人士也能参与到测试流程中。更值得一提的是其“自愈测试脚本”功能。在UI频繁更新的敏捷开发环境中,传统的自动化测试脚本往往因页面元素变化而失效,需要大量人工维护。RealDevWorld利用AI自动识别并修复这些失效的脚本,显著减少了维护成本,确保测试流程的持续有效。

此外,RealDevWorld支持全栈测试覆盖,无论是Web应用、移动应用还是后端API,都能进行全面的测试,覆盖完整的工作流。这种端到端的能力,确保了产品在各个环节的稳定性和用户体验的一致性。MetaGPT的这项工具,不仅是自动化测试技术的一次飞跃,更是多智能体协作在实际工程应用中的成功范例。它表明,AI不仅能辅助代码编写,更能深入到软件开发的各个生命周期,通过智能化的手段提升整体效率和质量。未来,随着AI技术与软件工程的进一步融合,我们有理由相信,软件开发将变得更加智能化、自动化和高效化。

开放智能的新篇章:瑞士发布自主开源AI大模型Apertus

在全球大模型竞赛日益白热化的背景下,主权AI和开源生态的重要性愈发凸显。瑞士近日推出的首个完全开源大语言模型Apertus,由EPFL、ETH Zurich和CSCS等顶级科研机构联合研发,标志着欧洲在构建开放、透明AI基础设施方面迈出了重要一步。Apertus不仅具备强大的多语言处理能力,更秉持开放透明的开发原则,旨在为用户提供OpenAI等商业模型的替代方案,并推动人工智能的可持续发展。

Apertus的核心优势在于其多语言处理能力,能够覆盖超过1000种语言,这对于一个多语言国家如瑞士而言,具有非凡的意义。它将促进跨文化交流,降低语言障碍,并为欧洲乃至全球的用户提供更具包容性的AI服务。模型的开发过程严格遵循透明和开放的原则,包括模型架构、训练数据来源、训练流程等关键信息均对外公开,这极大地增强了模型的信任度,并鼓励了更广泛的社区参与和贡献。这种开放性,是构建负责任AI生态的基石。

Apertus提供了两个版本,分别适合个人用户和处理复杂场景的应用,满足了不同用户的需求。更值得关注的是,该模型依托于采用可再生能源的超级计算机进行训练,这体现了瑞士在推动AI技术可持续发展方面的决心。在全球数据中心能耗日益增长的今天,将AI训练与绿色能源结合,为行业树立了良好的榜样。瑞士Apertus的发布,不仅提升了该国在全球AI领域的影响力,也为全球开源AI社区注入了新的活力,预示着未来AI技术将更加注重多样性、透明度和可持续性,共同塑造一个更加普惠和负责任的智能世界。