在人工智能领域,过去几年我们见证了参数规模持续膨胀的趋势,大型语言模型(LLMs)凭借强大的计算资源,不断刷新性能上限,成为云端智能服务的主力军。然而,谷歌最近推出的Gemma 3 270M模型,却为AI发展描绘了另一幅截然不同的图景——微型AI的崛起。这款仅有2.7亿参数的“小巨人”,正以其独特的能力,挑战着传统AI模型的部署模式,为设备端智能开辟了广阔天地。

核心理念与技术突破:小模型的大智慧

Gemma 3 270M的核心魅力在于其极致的轻量化设计。相较于谷歌此前发布的Gemma 3系列中拥有10亿至270亿参数的模型,2.7亿参数无疑是一个“袖珍”数字。在生成式AI中,参数是模型学习到的变量,决定了其如何处理输入并生成输出。通常而言,参数越多,模型性能越强。但Gemma 3 270M的出现,颠覆了这一线性认知。它被精心设计,旨在直接运行在资源受限的本地设备上,例如智能手机,甚至是完全在Web浏览器内部运行。这种部署模式的转变,是AI技术普惠化的关键一步,让高性能AI不再是云端服务器的专属。

边缘智能的优势解析:隐私、效率与低延迟

将AI模型运行在本地设备上,带来了多重显而易见的优势。首先,也是最重要的一点,是增强的用户隐私保护。由于数据处理在设备本地完成,用户的敏感信息无需上传到云端,大大降低了数据泄露的风险。其次,显著降低了响应延迟。消除了网络传输的耗时,AI模型能够实时响应用户请求,提供更加流畅、即时的交互体验。最后,Gemma 3 270M在资源效率方面的表现令人瞩目。在Pixel 9 Pro的测试中,这款新Gemma模型能够运行25次对话,而仅消耗设备0.75%的电池电量。这使其成为迄今为止最高效的Gemma模型,为移动设备上的AI应用提供了强大的续航保障。这种高效性不仅降低了功耗,也为设备制造商在未来智能硬件设计中提供了更多可能性。

小模型的大智慧:性能与潜力

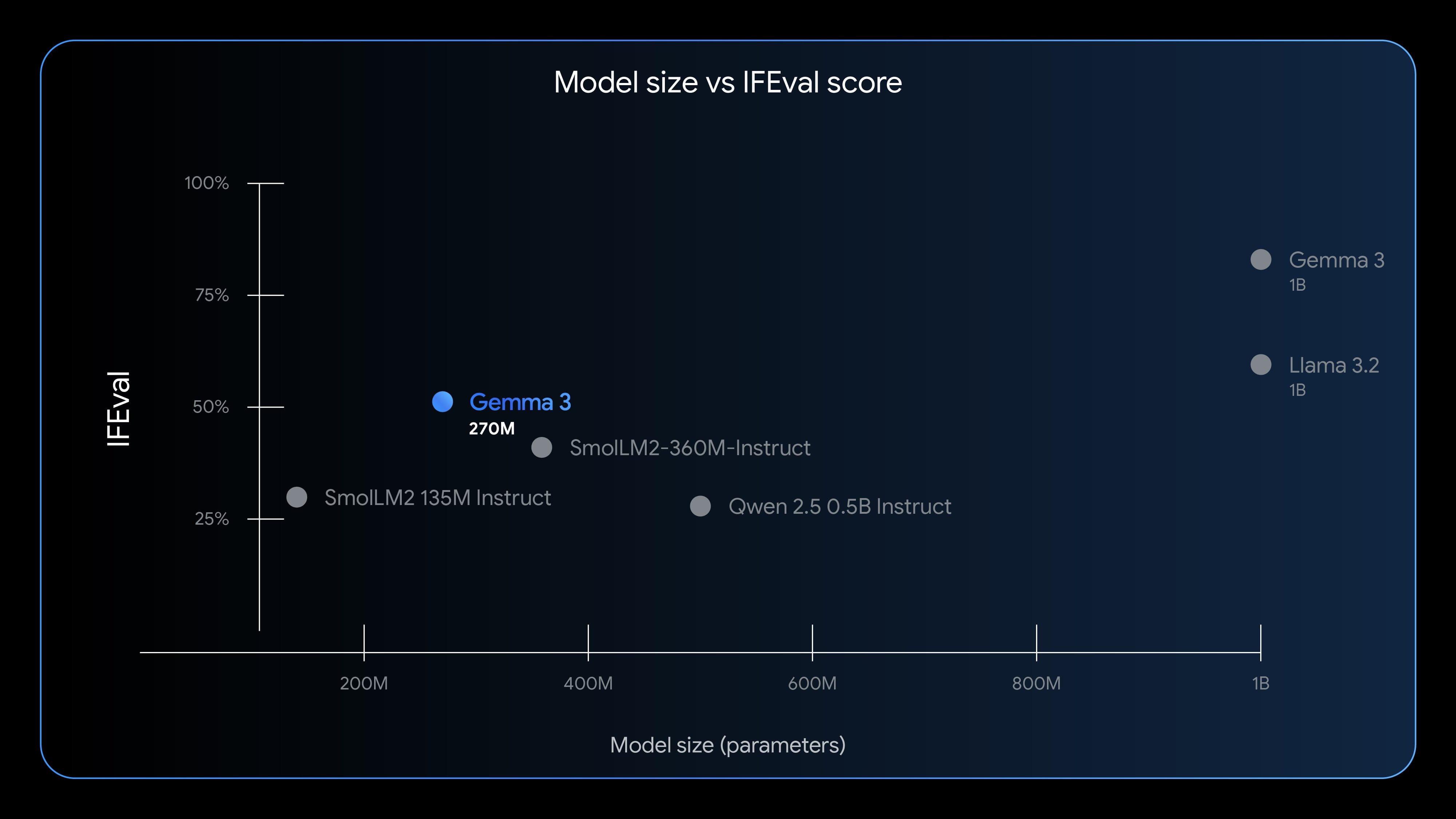

尽管参数量仅为2.7亿,开发者不应期望Gemma 3 270M能达到数十亿参数模型的相同性能水平。然而,谷歌通过IFEval基准测试证明,Gemma 3 270M在指令遵循能力上展现出“超乎其重量级”的表现。该模型在该测试中获得了51.2%的得分,这一成绩高于其他参数量更大的轻量级模型。虽然与Llama 3.2等10亿级参数以上的模型仍有差距,但考虑到其参数仅为后者的几分之一,Gemma 3 270M的表现已非常接近,令人印象深刻。这表明,通过优化模型架构和训练方法,小参数模型也能在特定任务上实现令人满意的性能。谷歌也明确指出,Gemma 3 270M出厂即具备良好的指令遵循能力,但更鼓励开发者根据特定用例进行微调。由于其参数量少,微调过程迅速且成本低廉,这极大地降低了开发者门槛,加速了创新应用的孵化。

该图表清晰展示了Gemma 3 270M在指令遵循方面的出色表现,对于其小巧体量而言,已是令人惊喜的成果。

谷歌设想Gemma 3 270M将被广泛应用于文本分类、数据分析等场景,这些任务往往要求快速响应且无需极致的泛化能力,恰好与Gemma 3 270M的优势完美契合。未来,我们或许能看到更多基于这类轻量级模型,在智能家居、可穿戴设备、工业自动化等领域涌现的创新应用。

面向开发者的机遇与挑战:开放与规范

谷歌将Gemma模型定义为“开放”模型,而非“开源”模型。这其中的区别虽然微妙,但在实际应用中却具有重要意义。开发者可以免费下载新的Gemma模型,并获取模型权重。由于没有单独的商业许可协议,开发者可以自由修改、发布和部署基于Gemma 3 270M的衍生工具。这意味着Gemma 3 270M拥有极高的可访问性和灵活性,鼓励了广泛的社区参与和创新。

然而,“开放”并不等同于完全无限制。所有Gemma模型的使用者都必须遵守其使用条款,其中明确禁止将模型用于生成有害输出或故意违反隐私规则。此外,开发者有责任详细说明对模型的修改,并为所有衍生版本提供一份使用条款副本,这些衍生版本将继承谷歌的自定义许可。这种“受控开放”的策略,旨在在促进技术共享的同时,确保AI伦理和安全。

生态建设与未来展望:普惠AI的基石

为了加速Gemma 3 270M的普及与应用,谷歌已将其部署在多个主流平台。开发者可以通过Hugging Face和Kaggle获取预训练和指令微调版本的Gemma 3 270M,并在谷歌的Vertex AI平台上进行测试。此外,谷歌还特别展示了一个完全基于浏览器、利用Transformer.js构建的“睡前故事生成器”,让普通用户无需任何开发经验也能体验到这款轻量级模型的强大功能。这些举措无疑将极大降低开发者和用户的入门门槛,促进Gemma 3 270M生态系统的繁荣。

Gemma 3 270M的发布,不仅代表了谷歌在小型化AI模型技术上的突破,更预示着人工智能行业的一个重要发展方向:即在保持高性能的同时,实现AI的极致轻量化和本地化部署。这将使得AI技术能够触及更广阔的终端设备和应用场景,真正实现普惠智能。随着边缘计算能力的不断提升,我们可以预见,Gemma 3 270M这类微型AI模型将在未来智能生态中扮演越来越重要的角色,推动AI技术从数据中心走向我们身边的每一个智能设备,开启一个全新的智能互动时代。