过去几年,破折号已成为许多人认为的AI生成文本的明显标志。这种标点符号频繁出现在ChatGPT和其他AI聊天机器人的输出中,有时甚至到了读者仅凭过度使用就能识别AI写作的程度——尽管人类也可能过度使用它。

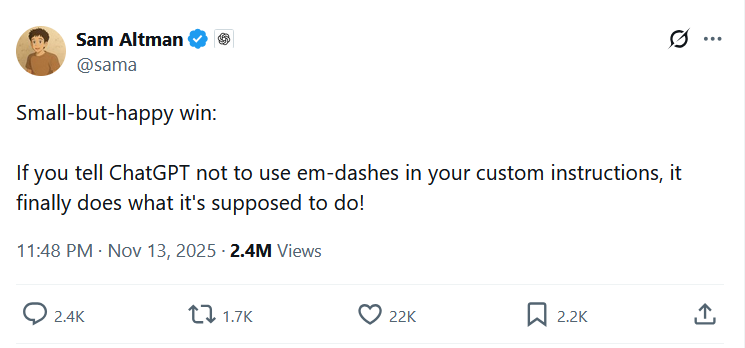

周四晚上,OpenAI CEO萨姆·阿尔特曼在X上发帖称,ChatGPT已开始遵循自定义指令以避免使用破折号。他写道:'小而高兴的胜利:如果你在自定义指令中告诉ChatGPT不要使用破折号,它终于做它应该做的事情了!'

这张截图显示了萨姆·阿尔特曼关于破折号的X帖子。

这篇帖子是在OpenAI发布新的GPT-5.1 AI模型两天后发布的,收到了用户们的不同反应,这些用户多年来一直努力让聊天机器人遵循特定的格式偏好。这个'小胜利'提出了一个很大的问题:如果全球最有价值的AI公司在尝试多年后仍难以控制像标点符号使用这样简单的事情,那么人们所说的人工智能通用智能(AGI)可能比行业某些人声称的要遥远得多。

AI模型为什么喜欢破折号?因为我们也是

与连字符不同,连字符是一个短标点符号,用于连接单词或单词的一部分,键盘上有一个专门的键(-),破折号是一个长破折号,用特殊字符(—)表示,作者用它来设置插入语信息,表示思想突然变化,或引入总结或解释。

在AI语言模型时代之前,一些作家经常哀叹现代写作中过度使用破折号。在2011年Slate的一篇文章中,作家诺林·马隆认为作家用破折号'代替正确地构造句子',并且过度依赖它'阻碍了真正高效的写作'。ChatGPT发布前发布的各种Reddit帖子中,作家们要么在破折号正确使用礼仪上挣扎,要么承认他们经常使用破折号作为一种有罪的快乐。

2021年,r/FanFiction subreddit的一位作家写道:'长期以来,我对破折号上瘾了。它们出现在我写的每个段落中。我喜欢那条笔直的线条,它给了我一个将细节或思想塞入 otherwise 有序段落的借口。即使在经历了大约两年的写作障碍后回来写作,我立即尽可能多地塞入破折号。'

由于AI聊天机器人倾向于过度使用破折号,检测工具和人类读者已经学会将破折号使用作为一种模式来识别,这给工作中自然偏爱这种标点符号的那一小部分作家带来了问题。因此,一些记者抱怨说AI正在'杀死'破折号。

没有人确切知道为什么大型语言模型(LLMs)倾向于过度使用破折号。我们已经看到网上有广泛的猜测试图解释这种现象,从注意到破折号在用作训练数据的19世纪书籍中更受欢迎(根据2018年的一项研究,英语中的破折号使用在1860年左右达到顶峰,然后在20世纪中期下降),或者也许AI模型从博客网站Medium上的自动破折号字符转换中借用了这种习惯。

我们确定的一件事是,LLMs倾向于在其训练数据(在初始训练过程中提供)和随后的强化学习过程中输出频繁出现的模式,该过程通常依赖人类偏好。因此,AI语言模型为您提供了一种'平滑'的平均风格,无论您要求它们提供什么,由它们通过用户反馈被调节为生产的内容所调节。

所以最合理的解释仍然是,从在互联网上大量示例上训练的AI模型请求专业风格的写作,将强烈倾向于训练数据中的主流风格,其中破折号在正式写作、新闻文章和编辑内容中频繁出现。也有可能在通过人类反馈(称为RLHF)进行训练期间,无论出于何种原因,包含破折号的响应获得了更高的评分。也许是因为这些输出在评估者看来显得更复杂或更有吸引力,但这只是推测。

从破折号到AGI?

要理解阿尔特曼的'胜利'真正意味着什么,以及它对通向AGI的道路说明了什么,我们需要了解ChatGPT的自定义指令实际上是如何工作的。它们允许用户设置跨所有对话应用的持久偏好,方法是在聊天开始前输入模型之前,将书面指令附加到提示中。用户可以指定语调、格式和风格要求,无需在每个新聊天中手动重复这些请求。

然而,该功能并不总是可靠地工作,因为LLMs并不可靠地工作(即使OpenAI和Anthropic也自由承认这一点)。LLM接收输入并产生输出,吐出提示(系统提示、自定义指令和您的聊天历史)的统计上合理的延续,它并不真正'理解'您在要求什么。对于AI语言模型输出,总是有一些运气成分使它们做您想做的事情。

在我们对GPT-5.1使用自定义指令的非正式测试中,ChatGPT确实遵循了我们不要生成破折号的请求。但尽管阿尔特曼声称如此,X用户的反应似乎表明,当请求未放在自定义指令中时,该功能的体验仍然各不相同。

所以如果LLMs是统计文本生成框,'指令遵循'甚至意味着什么?这是解构从LLMs到AGI的假设路径的关键。对于LLM来说,遵循指令的概念从根本上不同于我们通常认为的具有通用智能的人类遵循指令的方式,甚至是传统的计算机程序。

在传统计算中,指令遵循是确定性的。你告诉一个程序'不要包含字符X',它就不会包含那个字符。程序完全按照编写的规则执行。对于LLMs,'指令遵循'实际上是关于转移统计概率。当你告诉ChatGPT'不要使用破折号'时,你并没有创建硬性规则。你向提示中添加了文本,使与破折号相关的标记在生成过程中被选中的可能性降低。但'可能性较低'不等于'不可能'。

模型生成的每个标记都是从概率分布中选择的。您的自定义指令会影响该分布,但它与模型的训练数据(破折号在某些上下文中频繁出现)和提示中的其他内容竞争。与具有条件逻辑的代码不同,没有单独的系统根据您的要求验证输出。指令只是影响统计预测过程的更多文本。

当阿尔特曼庆祝最终让GPT避免使用破折号时,他实际上是在庆祝OpenAI已经调整了最新版本的GPT-5.1(可能通过强化学习或微调),在其概率计算中更重视自定义指令。

这里有一个关于控制的讽刺:鉴于问题的概率性质,无法保证问题会一直保持固定。OpenAI在后台不断更新其模型,即使在同一版本号内,根据用户反馈和新训练运行调整输出。每次更新都带来不同的输出特征,可能会撤销之前的行为调整,研究人员称之为'对齐税'。

精确调整神经网络的行为还不是一门精确的科学。由于网络中编码的所有概念都通过称为权重的值相互连接,调整一种行为可能会以意想不到的方式改变其他行为。今天修复破折号过度使用,明天的更新(旨在提高,比如说,编码能力)可能会无意中将它们带回来,不是因为OpenAI希望它们在那里,而是因为这是试图在数百万个竞争影响下引导统计系统的本质。

这引出了我们之前提到的一个隐含问题。如果控制标点符号使用仍然是一个可能随时重新出现的挣扎,那么我们离AGI还有多远?我们无法确定,但看起来很可能它不会仅从大型语言模型中 emerges。这是因为AGI,一种复制人类通用学习能力的技术,可能需要真正的理解和自我反思的 intentional 行动,而不是有时恰好与指令对齐的统计模式匹配。

而且,说到运气,一些用户在使用'自定义指令'功能之外仍然无法控制破折号使用。在聊天中被告知不要使用破折号后,ChatGPT更新了一个保存的记忆,并回复了一位X用户:'明白了——从现在开始我将严格使用短连字符。'

AI控制的本质困境

阿尔特曼的'小胜利'实际上揭示了一个更深层次的问题:我们对AI的控制远比想象的要脆弱。破折号问题看似微不足道,但它暴露了当前AI系统的根本局限性——它们不是在'理解'指令,而是在调整概率分布。

这种区别至关重要。当人类被告知不要使用破折号时,我们理解这一指令背后的语言规则和美学原则。我们可以灵活地应用这一规则,同时保持表达的丰富性。而AI系统则缺乏这种理解,它们只是在调整不同标记被选择的概率。

更令人担忧的是,这种控制是不稳定的。正如研究人员所指出的,每次模型更新都可能'撤销'之前的行为调整。这意味着即使我们解决了破折号问题,它也可能在未来某个时间点突然重新出现,没有任何明显的原因。

这种不稳定性反映了当前AI系统的本质:它们是复杂的概率系统,而非确定性系统。我们试图通过调整参数来控制它们,但这些调整会产生连锁反应,有时会产生意想不到的后果。

AGI之路:从统计模式到真正理解

破折号困境引发了一个根本性问题:如果我们在控制如此基本的语言元素方面都如此挣扎,那么实现真正的AGI还有多远?

当前的AI模型,包括GPT-5.1在内,本质上都是模式匹配系统。它们通过分析大量文本数据学习统计规律,然后生成在统计上合理的文本延续。这种系统可以模仿人类语言,但并不真正理解语言所表达的概念和含义。

真正的AGI需要超越这种统计模式匹配,发展出对世界的真正理解。它需要能够理解抽象概念,进行推理,解决问题,并具备自我意识。这些能力远远超出了当前AI系统的能力范围。

值得注意的是,阿尔特曼本人经常公开谈论AGI、超级智能和'天空中的神奇智能',同时为OpenAI筹集资金。然而,破折号问题提醒我们,尽管我们有这些宏伟的目标,但当前的AI技术仍然存在基本的局限性。

未来展望:超越破折号

尽管存在这些挑战,但我们不应完全悲观。破折号问题的解决确实代表了AI进步的一个小步骤。它表明通过精心调整和持续改进,我们可以使AI系统更好地遵循人类指令。

然而,我们需要认识到这种进步的局限性。解决破折号问题并不代表我们在理解人类语言方面取得了突破,而只是在调整模型的输出概率分布。

未来,我们需要开发新的方法,使AI系统能够真正理解语言和概念,而不仅仅是模仿统计模式。这可能需要结合符号AI和神经网络的方法,或者开发全新的AI范式。

与此同时,我们应该对AI的发展保持现实的期望。破折号问题提醒我们,实现真正的AGI可能比许多人想象的要困难得多。这需要基础科学的突破,而不仅仅是工程上的改进。

结论:标点符号背后的深刻启示

萨姆·阿尔特曼对ChatGPT终于能够遵循破折号指令的庆祝,表面上是一个小胜利,但实际上揭示了AI技术的深刻局限性。

破折号问题看似微不足道,但它反映了当前AI系统的本质:它们是复杂的概率系统,缺乏真正的理解和意识。我们在控制这种基本语言元素方面的挣扎,暗示了实现AGI的巨大挑战。

然而,这一认识也为我们指明了方向。如果我们想要实现真正的AGI,我们需要超越当前的统计模式匹配方法,开发能够真正理解语言和概念的系统。这将需要基础科学的突破,而不仅仅是工程上的改进。

在追求AGI的道路上,破折号问题可能只是一个开始。随着我们继续探索AI的边界,我们可能会发现更多类似的'小问题',每一个都将提醒我们当前技术的局限性,并指引我们朝着真正的智能迈进。