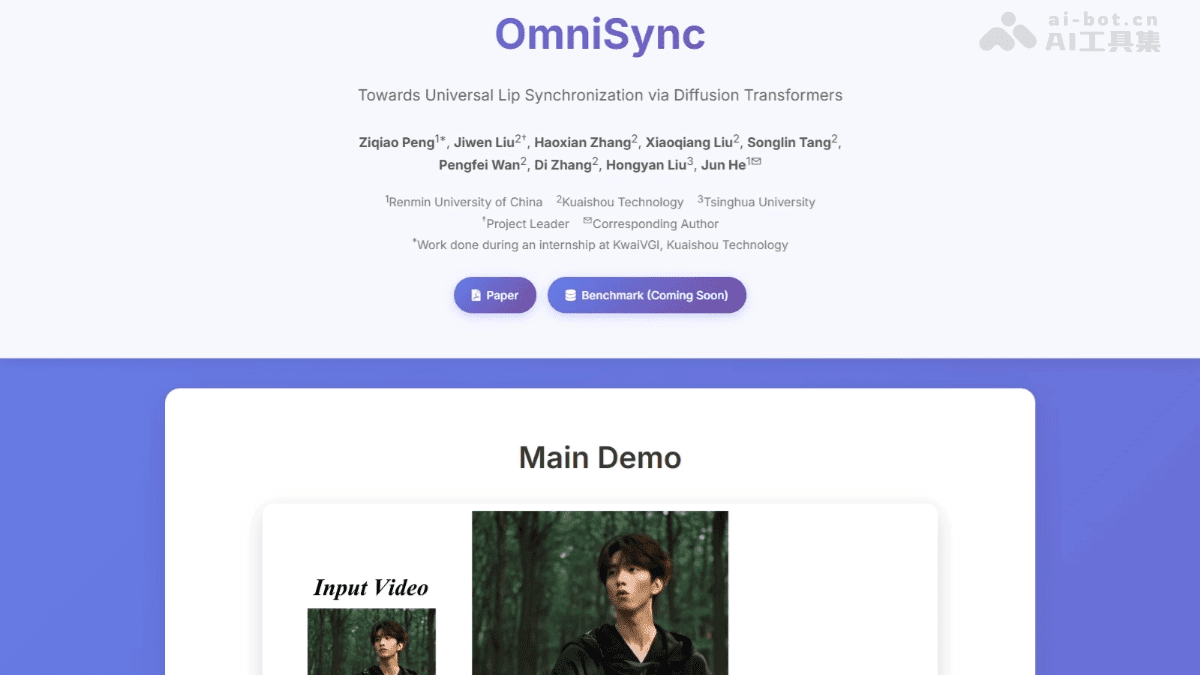

在人工智能领域,口型同步技术一直备受关注。近日,由中国人民大学、快手科技和清华大学联合推出的OmniSync框架,为这一领域带来了新的突破。OmniSync是一种通用的对口型框架,它基于扩散变换器(Diffusion Transformers)实现视频中人物口型与语音的精准同步。与传统的口型同步方法相比,OmniSync具有诸多优势,例如无需参考帧或显式掩码,支持无限时长推理,同时保持自然的面部动态和身份一致性。这种技术的出现,无疑为影视制作、虚拟现实、AI内容生成等领域带来了新的可能性。

OmniSync的核心功能

OmniSync的功能强大且全面,主要体现在以下几个方面:

- 无掩码训练:传统的口型同步方法通常需要参考帧或显式掩码,这在一定程度上限制了其应用范围。OmniSync采用无掩码训练的方式,直接编辑视频帧,无需额外的参考信息。这意味着它可以处理各种复杂的场景,并且支持无限时长的推理,极大地提高了灵活性和效率。

- 身份保持:在进行口型同步时,保持人物的身份一致性至关重要。OmniSync能够确保头部姿态和身份的一致性,同时精确地修改嘴部区域。这意味着在进行口型同步后,视频中的人物看起来仍然是同一个人,不会出现身份漂移的问题。

- 增强音频条件:音频信号的质量对口型同步的效果有很大的影响。OmniSync基于动态时空引导机制,能够有效地解决音频信号弱的问题。这种机制可以增强音频条件,提高口型同步的准确性和自然度。

- 通用兼容性:OmniSync具有广泛的兼容性,不仅适用于真人视频,还适用于风格化角色、非人类实体和AI生成内容。这意味着它可以应用于各种不同的场景,满足不同的需求。

- 无限时长推理:传统的口型同步方法在处理长视频时可能会遇到困难。OmniSync支持无限时长推理,能够保持自然的面部动态和时间一致性,即使在处理非常长的视频时也能保证口型同步的效果。

- 遮挡鲁棒性:在现实场景中,面部遮挡是一种常见的情况。OmniSync在面部遮挡等复杂条件下也能保持高质量的口型同步,这使得它在实际应用中具有更强的鲁棒性。

OmniSync的技术原理

OmniSync之所以能够实现如此强大的功能,离不开其独特的技术原理。以下是OmniSync的几个关键技术:

- 无掩码训练范式:OmniSync基于扩散变换器(Diffusion Transformers)进行直接跨帧编辑,无需显式掩码或参考帧。这种无掩码训练范式简化了训练过程,提高了效率。同时,它还引入了时间步依赖采样策略,根据不同的去噪阶段使用不同的数据集,确保稳定学习。这种策略可以有效地提高模型的泛化能力,使其能够适应各种不同的场景。

- 渐进噪声初始化:为了解决姿态不一致和身份漂移的问题,OmniSync采用了基于流匹配(Flow Matching)的渐进噪声初始化方法。该方法将控制噪声注入到原始帧中,仅执行最后的去噪步骤,从而保持空间一致性,支持精确的嘴部区域修改。这种方法可以有效地减少姿态和身份的变化,提高口型同步的准确性和自然度。

- 动态时空分类器自由引导(DS-CFG):音频信号对口型同步的影响至关重要。为了提供对音频影响的精细控制,OmniSync采用了动态时空分类器自由引导(DS-CFG)机制。该机制基于时空自适应引导,平衡音频条件强度。空间自适应引导使用高斯加权空间引导矩阵,集中引导强度在嘴部区域。时间自适应引导随着去噪过程的推进,逐渐降低引导强度,确保在早期和中期扩散阶段提供强引导,在后期细化细节时减少干扰。这种机制可以有效地提高口型同步的准确性和自然度。

OmniSync的应用场景

OmniSync技术的应用前景非常广阔,以下是一些典型的应用场景:

- 影视配音:在影视制作中,口型与配音的精准匹配至关重要。OmniSync可以实现角色口型与配音的精准匹配,提高影视作品的质量和观赏性。例如,在制作外语电影时,可以使用OmniSync将角色的口型与配音完美同步,让观众获得更好的观看体验。

- 虚拟现实:在虚拟现实(VR)和增强现实(AR)应用中,为虚拟角色提供逼真的口型同步可以显著增强沉浸感。OmniSync可以为虚拟角色提供逼真的口型同步,让用户感觉更加真实,从而提高VR/AR应用的吸引力。

- AI内容生成:随着人工智能技术的不断发展,AI内容生成越来越受到关注。OmniSync可以提升AI生成视频中口型同步的自然度,使AI生成的内容更加逼真和实用。例如,可以使用OmniSync生成具有逼真口型同步的虚拟主播,从而降低内容制作的成本。

- 视频会议:在远程通信中,口型同步效果对沟通的质量有很大的影响。OmniSync可以改善远程通信中的口型同步效果,提高沟通的效率和流畅性。例如,可以使用OmniSync提高视频会议中发言者的口型同步效果,使听众更容易理解其发言内容。

- 游戏开发:在游戏开发中,增强游戏角色的口型表现可以提升交互性。OmniSync可以增强游戏角色的口型表现,使游戏角色更加生动和真实,从而提高游戏的趣味性和吸引力。例如,可以使用OmniSync为游戏角色制作更加逼真的口型动画,使玩家感觉更加身临其境。

OmniSync的实际应用案例

为了更具体地了解OmniSync的应用,我们来看几个实际的案例:

- 快手短视频:快手作为国内领先的短视频平台,已经开始尝试使用OmniSync技术来优化其平台上的视频内容。通过OmniSync,快手可以自动将用户上传的视频中的口型与背景音乐或配音进行同步,从而提升视频的质量和用户体验。

- 人民大学教学:中国人民大学的一些课程已经开始使用OmniSync技术来制作教学视频。通过OmniSync,教师可以将自己的讲课内容与PPT演示文稿中的人物口型进行同步,从而使教学视频更加生动和有趣。

- 清华大学研究:清华大学的研究团队正在使用OmniSync技术来研究如何生成更加逼真的人工智能视频。通过OmniSync,研究人员可以控制AI生成视频中的人物口型,从而使其更加符合人类的习惯和认知。

OmniSync的未来发展趋势

随着人工智能技术的不断发展,OmniSync的未来发展趋势也将更加广阔。以下是一些可能的发展方向:

- 更高的精度:未来的OmniSync将继续提高口型同步的精度,使其更加逼真和自然。这需要不断改进算法和模型,并引入更多的训练数据。

- 更强的鲁棒性:未来的OmniSync将更加注重鲁棒性,使其能够在各种复杂的场景下都能保持高质量的口型同步效果。这需要不断改进算法和模型,并引入更多的噪声数据进行训练。

- 更广泛的应用:未来的OmniSync将应用于更多的领域,例如智能客服、虚拟助手、在线教育等。这将需要不断改进算法和模型,并开发更多的应用接口。

结论

总而言之,OmniSync作为一种通用的对口型框架,具有诸多优势和广阔的应用前景。它的出现,为影视制作、虚拟现实、AI内容生成等领域带来了新的可能性。随着技术的不断发展,OmniSync将在未来发挥更大的作用,为人们的生活带来更多的便利和乐趣。