在科技日新月异的今天,音频技术也迎来了新的突破。阿里巴巴通义实验室语音团队推出的OmniAudio,正是这样一款引人注目的空间音频生成模型。它能够从360°视频中生成具有沉浸感的空间音频(FOA),为虚拟现实、沉浸式娱乐等领域带来更逼真的音频体验。本文将深入探讨OmniAudio的技术原理、功能特性、应用场景,以及它所代表的未来音频技术发展方向。

OmniAudio:开启空间音频新纪元

传统的音频技术往往难以满足人们对于沉浸式体验的需求,尤其是在虚拟现实等领域,声音的方位感和真实感至关重要。OmniAudio的出现,正是为了解决这一难题。它通过先进的算法和深度学习技术,能够从360°视频中提取声音信息,并将其转化为具有空间感的FOA音频,让用户在体验虚拟现实内容时,能够感受到更加逼真的声音环境。

OmniAudio的核心功能

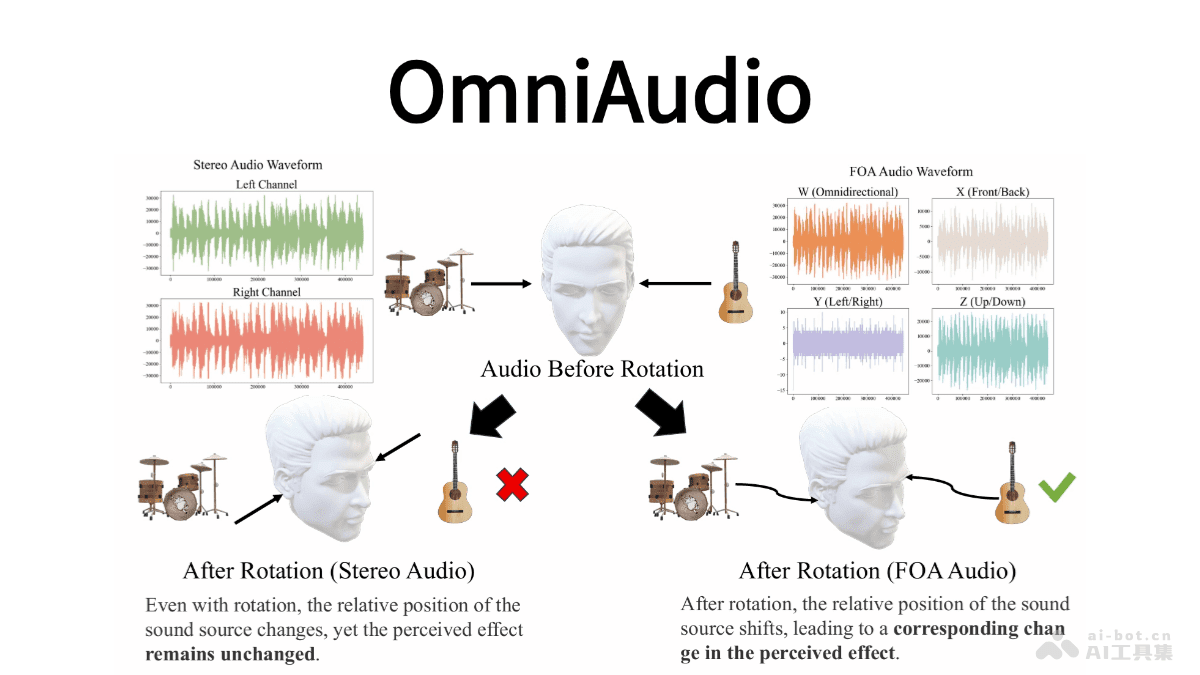

OmniAudio最核心的功能在于其强大的空间音频生成能力。它能够直接从360°视频生成FOA音频,这种音频格式能够捕捉声音的方向性,实现真实的3D音频再现。与传统的音频技术相比,FOA音频能够提供更加逼真的声音定位感,让用户在体验虚拟现实内容时,能够更加身临其境。具体来说,OmniAudio采用四个通道(W、X、Y、Z)来表示声音,其中W通道负责捕捉整体声压,X、Y、Z通道则分别捕捉前后、左右以及垂直方向的声音信息。这种多通道的设计,使得OmniAudio能够更加精确地还原声音的空间信息,即使在头部旋转时,也能确保声音定位的准确性。

除了强大的空间音频生成能力外,OmniAudio还能够显著提升沉浸式体验。它为虚拟现实和沉浸式娱乐带来了全新的可能性,解决了传统视频到音频生成技术主要生成非空间音频,无法满足沉浸式体验对3D声音定位需求的问题。通过OmniAudio,开发者可以轻松地为虚拟现实内容添加逼真的空间音频,从而提升用户的沉浸感和体验。

OmniAudio的技术原理

OmniAudio之所以能够实现如此强大的功能,离不开其独特的技术原理。它主要采用了自监督的coarse-to-fine流匹配预训练和基于双分支视频表示的有监督微调两种技术。

自监督的coarse-to-fine流匹配预训练

- 数据处理:由于真实FOA数据稀缺,研究团队利用大规模非空间音频资源(如 FreeSound、AudioSet、VGGSound 等),将立体声转换为“伪FOA”格式。具体来说,W通道为左右声道之和,X通道为左右声道之差,Y、Z通道置零。这一步巧妙地利用了现有的非空间音频资源,为模型的训练提供了充足的数据。

- 模型训练:将转换后的“伪FOA”音频送入四通道VAE编码器获得潜在表示,然后以一定概率进行随机时间窗掩码,并将掩码后的潜在序列与完整序列一同作为条件输入至流匹配模型。模型通过最小化掩码前后潜在状态的速度场差异,实现对音频时序和结构的自监督学习。这一阶段使模型掌握了通用音频特征和宏观时域规律,为后续空间音频的精细化提供了基础。通过自监督学习,模型能够从大量的无标注数据中学习到音频的内在规律,从而提高其在空间音频生成方面的性能。

基于双分支视频表示的有监督微调

- 数据利用:仅使用真实的FOA音频数据,继续沿用掩码流匹配的训练框架,但此时模型的全部注意力集中在四通道的空间特性上。这一步利用了真实的FOA音频数据,对模型进行微调,使其更加专注于空间信息的处理。

- 模型强化:通过对真实FOA潜在序列进行更高概率的掩码,强化了对声源方向(W/X/Y/Z四通道之间的互补关系)的表征能力,在解码端提升了对高保真空间音频细节的重建效果。通过强化模型对声源方向的表征能力,可以提高其在空间音频生成方面的准确性和真实感。

- 双分支结合:完成自监督预训练后,将模型与双分支视频编码器结合。针对输入的360°全景视频,使用冻结的MetaCLIP-Huge图像编码器提取全局特征;同时,从同一视频中裁取FOV局部视角,同样通过该编码器获取局部细节表征。全局特征经最大池化后作为Transformer的全局条件,局部特征经时间上采样后与音频潜在序列逐元素相加,作为逐步生成过程中的局部条件。通过双分支视频编码器,模型能够同时获取视频的全局信息和局部细节,从而更好地理解视频内容,并生成与之匹配的空间音频。

- 微调与输出:在保持预训练初始化参数大致走向的前提下,高效微调条件流场,从噪声中精准地“雕刻”出符合视觉指示的FOA潜在轨迹。微调完成后,在推理阶段只需采样学得的速度场,再经VAE解码器恢复波形,就能输出与360°视频高度对齐、具备精确方向感的四通道空间音频。通过微调和优化,模型能够生成与视频内容高度匹配、具有精确方向感的空间音频,从而为用户带来更加逼真的沉浸式体验。

OmniAudio的应用场景

OmniAudio的应用场景非常广泛,涵盖了虚拟现实、沉浸式娱乐、智能语音助手、机器人和自动驾驶等多个领域。

- 虚拟现实(VR)和沉浸式体验:OmniAudio 能为 VR 内容生成与视觉场景高度匹配的空间音频,增强用户的沉浸感。在虚拟现实游戏中,用户可以通过OmniAudio听到逼真的脚步声、风声、枪声等,从而更加身临其境地体验游戏内容。在虚拟现实旅游中,用户可以通过OmniAudio听到逼真的鸟鸣声、海浪声、人群声等,从而更加真实地感受到旅游目的地的氛围。

- 360°视频配乐:为360°全景视频自动生成沉浸式音效,使观众在观看视频时能获得更真实的听觉体验。传统的360°视频往往缺乏空间音频,使得用户的沉浸感大打折扣。通过OmniAudio,可以为360°视频自动生成沉浸式音效,让观众在观看视频时,能够感受到更加逼真的声音环境,从而提升观看体验。

- 智能语音助手:集成到智能家居设备中,如智能音箱、智能家电等,实现语音控制和交互。用户可以通过语音指令控制家电的开关、调节温度、查询信息等。通过OmniAudio,智能语音助手可以更加准确地识别用户的语音指令,并提供更加自然、流畅的语音反馈,从而提升用户的使用体验。

- 机器人和自动驾驶领域:OmniAudio 可以应用于机器人和自动驾驶领域,为这些系统提供更准确的声音定位和环境感知。在机器人领域,OmniAudio可以帮助机器人更好地识别和定位声音,从而实现更加智能的人机交互。在自动驾驶领域,OmniAudio可以帮助自动驾驶系统更好地感知周围环境,例如识别警笛声、喇叭声等,从而提高驾驶安全性。

OmniAudio:未来音频技术的新方向

OmniAudio的出现,不仅是一款强大的空间音频生成模型,更代表了未来音频技术的发展方向。随着虚拟现实、沉浸式娱乐等领域的不断发展,人们对于音频体验的需求也越来越高。传统的音频技术已经难以满足这些需求,而OmniAudio则通过先进的算法和深度学习技术,为我们带来了全新的音频体验。

可以预见,随着OmniAudio等空间音频技术的不断发展,未来的音频体验将更加逼真、沉浸。人们将能够在虚拟现实游戏中感受到更加真实的声音环境,在360°视频中获得更加身临其境的听觉体验,在智能家居中享受到更加自然、流畅的语音交互。OmniAudio,正在开启空间音频的新纪元,引领我们走向更加美好的未来。

总而言之,OmniAudio作为阿里巴巴通义实验室语音团队的创新成果,凭借其卓越的空间音频生成能力、广泛的应用场景以及前瞻性的技术理念,正在深刻地改变着我们对于音频体验的认知。它不仅为虚拟现实、沉浸式娱乐等领域带来了全新的可能性,也为智能语音助手、机器人和自动驾驶等领域提供了更加强大的技术支持。相信在不久的将来,OmniAudio将会在更多的领域得到应用,为我们带来更加美好的生活体验。