在人工智能领域,Agent模式无疑是当下最炙手可热的话题之一。如果说过去我们更多地关注AI的“说”,那么现在,AI的“做”正逐渐成为现实。既然AI已经具备了理解和思考的能力,为什么不能直接让它完成任务呢?

2025年下半年,OpenAI发布了其Agent模式,这一举动再次引发了业界的广泛关注。值得注意的是,OpenAI的Agent模式与之前爆火的Manus模式有着惊人的相似之处。那么,OpenAI的Agent模式究竟有哪些特点?它又将如何改变我们的工作和生活?

OpenAI Agent模式的核心功能

OpenAI的Agent模式,简单来说,就是让ChatGPT具备自主完成任务的能力。用户只需提出需求,例如购买婚礼所需的鞋子、设计宠物周边产品并下单打印、查找信息并生成PPT等,ChatGPT就能自动打开虚拟机,一步步完成操作。在演示中,完成一个复杂任务大约需要10分钟,但完成度非常高。ChatGPT可以在虚拟环境中调用文本浏览器、可视化浏览器和终端,还能基于终端进一步调用云服务API、图片生成器,甚至运行代码。

更重要的是,这次OpenAI不再将Agent模式限定于Pro用户,Plus和Team用户也能很快上手,每月可用40次。这无疑大大降低了Agent模式的使用门槛,让更多人能够体验到AI带来的便利。

Sam Altman表示,Agent模式是一个全新的范式。就像我们学会上网,最终也学会了甄别诈骗信息一样,现在整个社会需要学习如何与Agent安全地交互和共存。这句话既是对Agent模式的肯定,也是对未来发展的一种展望。

Agent模式的应用场景

OpenAI的Agent模式在用户提出需求后,会自动开启一个虚拟机,开始自动执行任务。在执行过程中,Agent会反复请求用户确认,并允许随时手动接管。同时,用户也能在任务中途植入新需求,进行实时交互。

Agent模式可以调用三种工具:文本浏览器、可视化浏览器和终端。模型可以自主选择切换各种工具。 这种工具组合的设计非常精巧:文本浏览器负责大量浏览文字,搜寻信息;可视化浏览器则负责定位到信息后直接模拟一些键鼠交互,或者用来读取图像信息;终端则可以运行代码,生成包括PPT、Excel在内的文件,并调用一些云端API。

在OpenAI提供的演示中,研究员提出要规划参加朋友婚礼的事宜,包括挑选符合着装要求的礼服、预订酒店,以及提供礼物建议。Agent启动虚拟电脑并加载环境后,首先使用文本浏览器打开用户提供的网页,搜索婚礼信息、着装要求、天气等。在需要进一步确认婚礼日期时,模型会提出澄清请求,但用户选择让它自己继续推理。在找到天气、场地信息后,AI开始推荐合适的礼服,并切换到可视化浏览器检查礼服效果。完成任务后,继续搜索酒店和礼物。

最终给出的婚礼出行建议报告非常详细,涵盖了服装、酒店、礼物,甚至附上了非常多的链接,在酒店是否有空位的索引上,还附上了在线预订网站的截图。完成这样一份报告,AI只花了十分钟。虽然相比于传统的一问一答模式,时间有所增加,但考虑到实际的工作量,AI的效率依然非常高。

另一个演示则直接展示了Agent模式的动手能力。研究员要求给团队的吉祥物(一只可爱的狗狗,昵称Bernie)做出一批笔记本贴纸,并下单500张。Agent直接利用终端功能,调用图像生成工具(Image Gen API)来生成一张动漫风格的狗狗插画,作为贴纸的设计图案。接着,Agent打开浏览器访问Sticker Mule网站,把设计好的图上传到网站,填写了贴纸数量、尺寸等,并把商品加入购物车。最后,它主动向用户确认是否要用这张插画?是否继续下单?是否需要用户自己输入信用卡付款,还是让它继续完成?任务停留在让用户接管输入信用卡,花费7分钟。

此外,Agent还能自己连接Google Drive API,读取文件后生成一份PPT;查询赛季日程,生成一个详细的旅行电子表格+带标注地图的旅行攻略。这个任务比较复杂,Agent大约花了25分钟完成。

OpenAI Agent模式的技术解析

OpenAI此次推出的新Agent模式,实际上并不是一项全新的创新,而是由OpenAI上半年推出的两样工具组合而成:Operator和Deep Research。

Operator是原本只开放给Pro用户的浏览器Agent工具,能够分析图形操作界面,并做出一定的操作。而Deep Research则是一个深入研究的分析工具,可以阅读大量的网页,直接生成一份调研报告。OpenAI表示,在两样工具分别推出的过程中,发现很多用户用Operator写的提示词其实更像Deep Research的任务,比如“计划一次旅行并预订”。而Deep Research用户高度呼吁增加“登录网站、访问受保护资源”的能力,其实是Operator早就能做的。于是团队决定将两个产品融合起来。

此次Operator和Deep Research的融合看起来非常成功。两个从不同角度推动的Agent项目,最后融合起来,产生了一些奇妙的化学反应,也避开了只使用浏览器的图形界面去阅读文字材料的低效,让最后能形成深度报告的时长变得并不高。

OpenAI也提到了在为模型提供多种工具之后,怎样训练模型。仍然是使用强化学习。一开始模型会“笨拙”地尝试用所有工具解决一个相对简单的问题。也就是说,它刚开始不会判断哪个工具更合适。通过奖励它那些解决问题更高效、更合理的行为,模型能逐渐学会如何用这些工具。在什么情况下用哪个工具最合适。 比如如果是做创意作品,它会先搜索公开资源;然后用终端写代码、编译作品;最后用可视化浏览器验证结果。

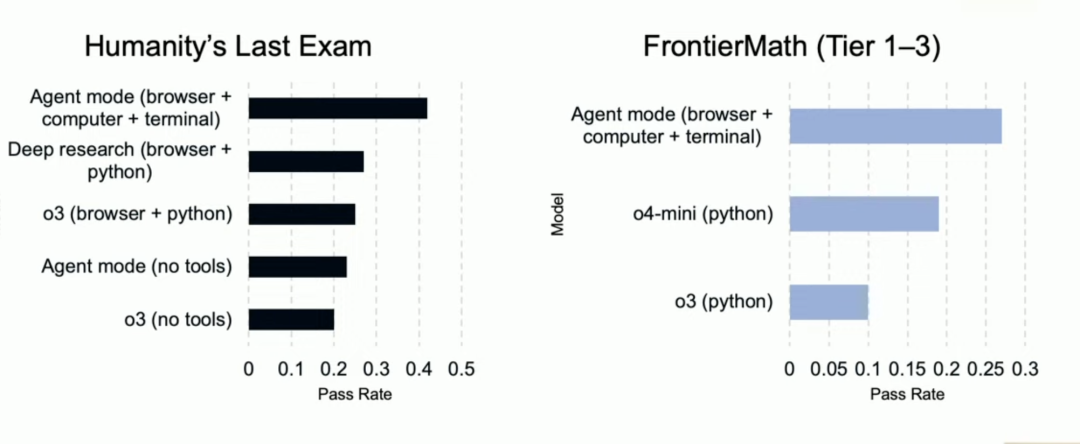

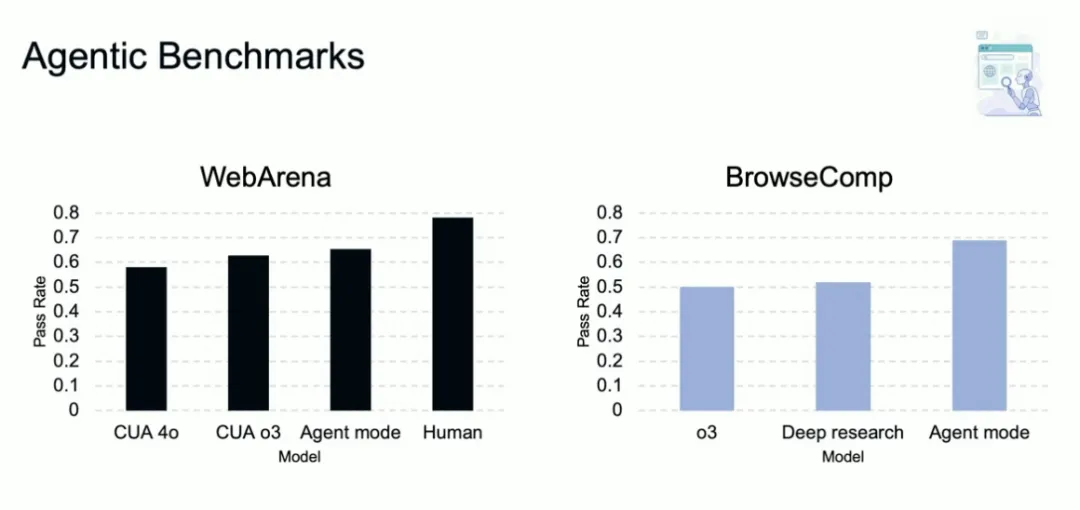

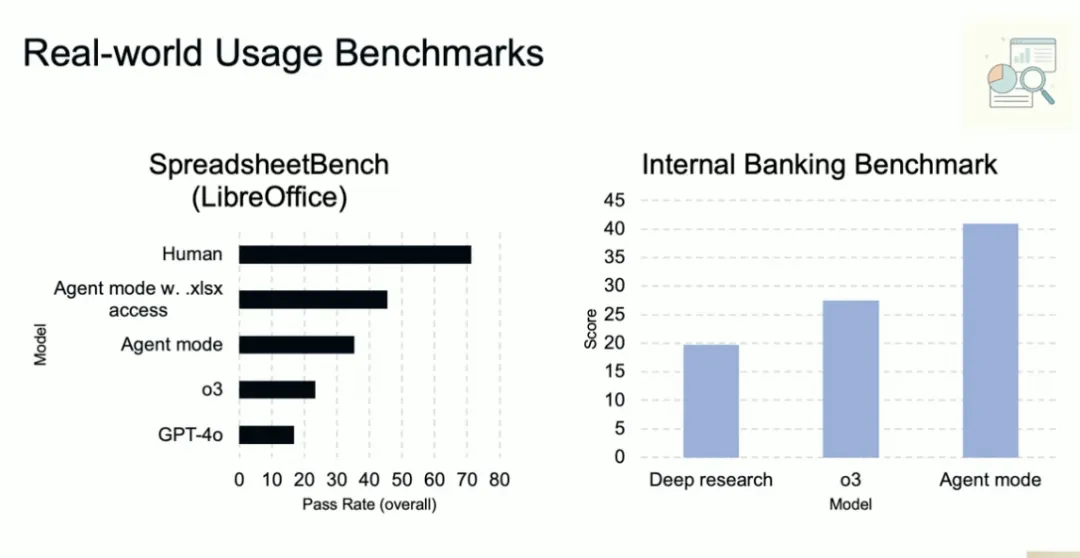

在Humanities Last Exam(人类的最后一场大考)中,能够使用浏览器、电脑和终端的Agent模式模型,已经能够达到42%的高分,相比于完全不使用工具的o3,有一倍的提升。而在世界范围内也是领先的——Grok宣布带工具的 Grok 4 Heavy 在测试中取得 45% 的成绩。

网页操作和电子表格操作的基准测试中,Agent模式仍然不如人类,但是网页操作已经追近了人类水平。这意味着,即便只是整合这些本身尚不如人类的工具,大模型也能获得显著的能力提升。Agent时代,大模型能力的提升显然还有更高的天花板。

Agent时代面临的挑战与机遇

Agent是2025年AI领域的绝对风口。但风口之下,用户的真实体感往往并不完美:任务运行时间过长;稍复杂的任务就频频出错。此次OpenAI将Operator与Deep Research融合,或许正是为了缓解这种“粘滞感”,让Agent真正跑起来。

当OpenAI自己下场,一个更直接的问题摆在了所有类似Manus的第三方开发者面前:这究竟是会催生一个繁荣的Agent应用生态,还是会直接碾压所有创业公司?答案尚不明朗。

而对于用户而言,一个更切身的挑战随之而来:隐私和安全。当AI在我们看不见的虚拟机里,点开一个网页、输入我们的个人信息时,谁来保证安全?如果它被钓鱼网站骗走了我们的信用卡号,责任谁负?OpenAI对此的回应是,他们会采取极其严格的审查和安全措施,但它也希望整个社会都能花时间去适应和建立规范。

Agent时代,确实是继Chat时代之后,一个截然不同的新阶段。在Chat时代,我们学会了适应AI的“嘴”——我们慢慢习惯了它的幻觉,并学会在它的花言巧语中甄别真伪。这是一个关于“信息可信度”的挑战。而在Agent时代,挑战则完全转向了AI的“手”。我们需要回答一系列全新的问题:我们究竟愿意多信任AI?我们又愿意把多大的权限交出去,让它代替我们完成多少现实世界的事情?而我们与AI的关系,也将因此被重新定义。

从更宏观的视角看,Agent的爆发也将再次将一个老问题以更尖锐的方式推到我们面前:当AI能真正“干活”时,我们的工作会怎样?当AI能独立完成一份包含数据检索、图像查证的复杂报告,并直接完成在线预订时,白领们的工作究竟是被赋能加速,还是被彻底威胁?

无论我们欢迎、恐惧还是茫然,一个由Agent驱动的、更自动化的新时代,正在加速到来。