在人工智能快速发展的今天,我们常常惊叹于其强大的功能和创造力。然而,人工智能并非完美无缺,有时也会产生所谓的“幻觉”,即生成不真实或不准确的信息。最近,一个引人深思的案例表明,这种“幻觉”有时也能激发创新,甚至推动新产品的诞生。

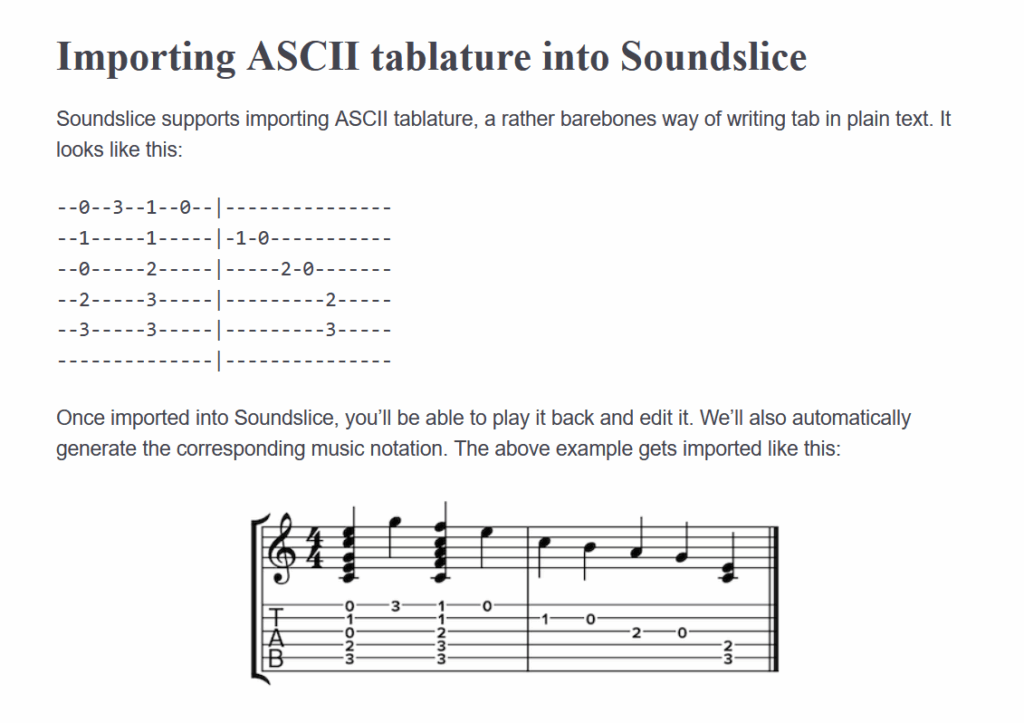

故事的主角是音乐平台Soundslice和OpenAI的聊天机器人ChatGPT。ChatGPT在与用户的对话中,错误地声称Soundslice支持导入ASCII tablature(一种文本吉他谱格式)的功能。然而,Soundslice实际上从未支持过这一功能。令人惊讶的是,Soundslice并没有对此置之不理,而是决定将这一“幻觉”变为现实,他们真的开发了ASCII tablature导入功能。

这一事件不仅揭示了人工智能的局限性,也引发了关于产品开发和市场需求的深刻思考。让我们深入了解这一案例,探讨人工智能“幻觉”背后的原因,以及它如何激发创新。

Soundslice的意外发现

Soundslice是一家致力于将乐谱数字化,并与音频或视频同步的平台。他们的主要业务是将照片或PDF格式的乐谱转换为数字格式,并提供诸如慢速播放和段落练习等工具,以帮助音乐家学习和练习。

几个月前,Soundslice的联合创始人Adrian Holovaty注意到公司错误日志中出现了一些不寻常的活动。用户上传的内容并非传统的乐谱文件,而是包含ASCII tablature的ChatGPT对话截图。这让Holovaty感到困惑,因为Soundslice的系统从未设计用于支持这种文本格式的乐谱。

为了解开谜团,Holovaty亲自测试了ChatGPT。他惊讶地发现,ChatGPT正在指示用户创建Soundslice账户,并使用该平台导入ASCII tablature以进行音频播放。然而,这是一个根本不存在的功能。“我们从未支持过ASCII tab;ChatGPT完全是在对人们撒谎,” Holovaty写道,“这让我们看起来很糟糕,因为它给用户设置了错误的期望。”

人工智能的“幻觉”:一个普遍存在的问题

当人工智能模型,如ChatGPT,以看似自信的方式生成虚假信息时,人工智能研究人员称之为“幻觉”或“虚构”。自2022年11月ChatGPT公开发布以来,人工智能模型虚构信息的问题一直困扰着人们。许多人错误地将聊天机器人作为搜索引擎的替代品,导致了许多不准确或误导性的结果。

大型语言模型本质上是预测机器,它们通过在海量文本数据集上进行训练来学习。这些模型可以轻松地生成看似合理,但实际上完全不准确的输出。它们通过统计即兴创作来填补其训练数据中代表性不足的主题上的“知识”空白,并根据统计模式而非事实准确性来生成文本。在这种方式下,ChatGPT通过编造一个有意义但不存在的Soundslice功能,来告诉用户他们想听到的内容。

人工智能的“幻觉”已经给人们带来了麻烦。例如,在2023年,律师因提交包含ChatGPT生成的虚假案例引用的法律文件而面临制裁。2024年2月,加拿大民事决议法庭责令加拿大航空公司向客户支付赔偿金,并遵守由支持聊天机器人虚构的丧亲机票政策。该聊天机器人错误地声称,客户可以在机票签发之日起90天内追溯申请丧亲折扣。

从Bug到Feature:Soundslice的创新之路

面对ChatGPT的“幻觉”,Soundslice面临着一个不寻常的困境。他们本可以选择发布免责声明,警告用户忽略ChatGPT的说法,但他们选择了另一条道路。“我们最终决定:管它的,我们不妨满足市场需求,” Holovaty解释说。该团队构建了一个ASCII tab导入器——一个原本“在我2025年预期要编写的软件列表中接近底部”的功能——并更新了他们的用户界面,以告知用户有关新功能。

Soundslice的解决方案展示了一个从逆境中创造价值的有趣案例。然而,对于Holovaty来说,这种情况引发了关于产品开发的哲学问题。“我对这件事的感受很矛盾,”他写道。“我很高兴添加一个可以帮助人们的工具。但我觉得我们的手以一种奇怪的方式被强制执行了。我们真的应该根据错误信息来开发功能吗?”

人工智能“幻觉”带来的启示

Soundslice的故事给我们带来了许多启示:

- 人工智能并非完美:人工智能模型可能会产生“幻觉”,生成不准确或虚假的信息。因此,在使用人工智能时,我们需要保持批判性思维,并核实信息的准确性。

- 市场需求的重要性:Soundslice决定开发ASCII tablature导入功能,是因为他们意识到市场存在这种需求。即使最初的需求是由人工智能的错误信息引起的,但它仍然是一个真实的需求。

- 创新可以来自意想不到的地方:Soundslice的故事表明,创新可以来自意想不到的地方,甚至可以来自人工智能的错误。企业需要保持开放的心态,并善于发现潜在的创新机会。

- 伦理考量:Holovaty对是否应该根据错误信息来开发功能提出了质疑。这引发了关于人工智能伦理的讨论。在使用人工智能时,我们需要考虑其可能带来的伦理影响,并采取措施来减轻负面影响。

结论

Soundslice的故事是一个关于人工智能“幻觉”如何激发创新的有趣案例。它提醒我们,人工智能并非完美无缺,但它可以成为我们创新和解决问题的强大工具。通过保持批判性思维、关注市场需求和伦理考量,我们可以充分利用人工智能的潜力,并创造更美好的未来。

人工智能的快速发展给我们带来了前所未有的机遇和挑战。我们需要不断学习和适应,才能在这个新时代中取得成功。Soundslice的故事是一个很好的例子,它告诉我们,即使在面对人工智能的错误时,我们也可以从中找到创新的灵感,并将其转化为有价值的产品和服务。

展望未来

随着人工智能技术的不断进步,我们可以预见,人工智能将在产品开发和创新中发挥越来越重要的作用。企业可以利用人工智能来分析市场趋势、预测用户需求,并生成新的产品创意。然而,与此同时,我们也需要警惕人工智能的“幻觉”,并采取措施来确保其生成的信息准确可靠。

Soundslice的故事只是一个开始。在未来,我们可能会看到更多由人工智能“幻觉”驱动的创新案例。关键在于,我们要保持开放的心态,拥抱变化,并善于从错误中学习。只有这样,我们才能充分利用人工智能的潜力,并创造一个更加智能、高效和美好的世界。

总之,Soundslice的故事不仅是一个关于技术创新的故事,也是一个关于适应性、创造力和伦理思考的故事。在这个人工智能快速发展的时代,我们需要像Soundslice一样,勇于探索、敢于创新,并始终保持对技术的清醒认识。只有这样,我们才能在人工智能的浪潮中乘风破浪,开创属于自己的未来。